嘿,记得给“机器学习与推荐算法”添加星标

随着NLP和CV领域的发展,涌现出了以BERT,GPT为代表的大规模语言模型和以ImageNet为代表的各种经典视觉模型,如resnet和visual transformer,在各自领域都产生了很大的成功,而且实现了通用语言/视觉表征能力,例如BERT学好的语言表征可以被应用到各种各样的下游任务。受到相关技术的启发,推荐系统最近两年也出现了一些学习用户通用表征的算法和深度模型,也就是,通过对用户行为进行某种程度预训练,然后adapt到一些下游任务中,这些下游任务包括,跨域推荐和用户画像预测,本文简要介绍几种代表性工作, 优先并重点介绍了有代码和数据集的论文,以便大家更好的follow。本帖子参考了一些相关技术帖。

Parameter-Efficient Transfer from Sequential Behaviors for User Modeling and Recommendation. SIGIR2020

作者来自腾讯和谷歌

代码+数据集:https://github.com/fajieyuan/SIGIR2020_peterrec

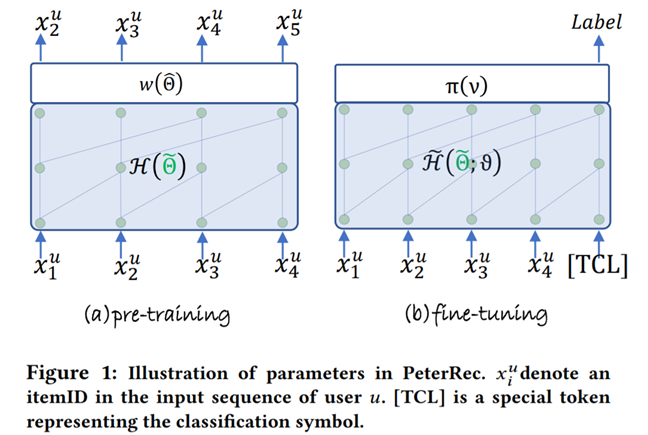

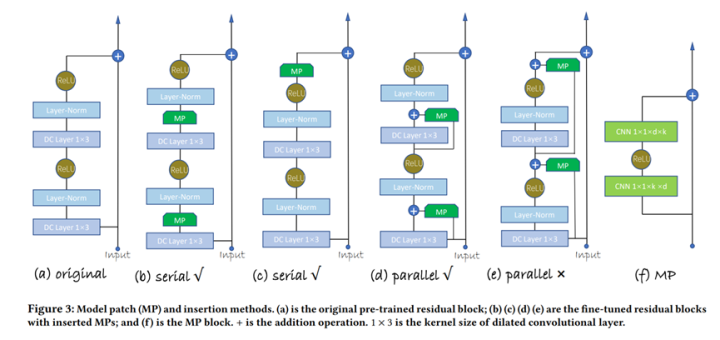

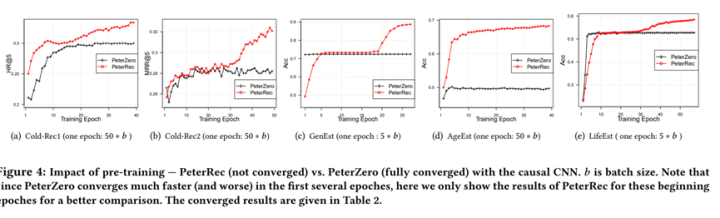

本文提出一种名为PeterRec的通用表征迁移学习算法,论文指出,受到以上NLP和CV领域自监督+预训练的启发,作者也尝试了对用户点击行为进行自监督建模,以寻求学到通用的用户偏好表征,论文提出了5个与用户相关的下游任务去评测学到用户表征能力,其中包括跨域迁移学习,也就是在冷用户推荐的场景,通过借助其他domain的用户行为获取偏好,另外,本文一个发现是这种自监督学习的用户表征不仅仅可以做推荐任务,同时可以去预测用户的基础画像和更高层次的用户属性信息,作者展示了预训练用户表征在迁移到用户年龄,画像预测和人生状态预测(如,单身、已婚)的有效性,论文的ablation study展示了通过pretraining可以获得较明显的性能提升。该论文的一个贡献是建立了推荐系统和NLP、CV领域的桥梁,也是通用用户表征比较早期的做法,对后续工作很有启发,同时,作者也发布了一套开源代码和数据集(短视频场景),可以用于预训练、迁移学习、表征学习、画像预测等重要的推荐系统任务。

One Person, One Model, One World: Learning Continual User Representation without Forgetting. SIGIR2021.

作者来自腾讯和谷歌

代码+数据集:https://github.com/fajieyuan/SIGIR2021_Conure

本文作者沿着PeterRec思想,仍然是探究用户通用表征能力和迁移效果,论文一个重要的贡献是

本文概述了推荐系统中通用用户表征预训练的最新进展,包括PeterRec、Conure等模型,强调了预训练在跨域推荐和用户画像预测中的应用,并探讨了终生学习和对比学习等方法在提升用户表征迁移效果上的作用。

本文概述了推荐系统中通用用户表征预训练的最新进展,包括PeterRec、Conure等模型,强调了预训练在跨域推荐和用户画像预测中的应用,并探讨了终生学习和对比学习等方法在提升用户表征迁移效果上的作用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?