前言

本任务主要讲解了我们获得一个要分析的数据,学会如何加载数据,查看数据,然后学习Pandas的一些基础操作,最后开始尝试探索性的数据分析。

1、 第一章:数据载入及初步观察

1.1 载入数据

数据集下载 https://www.kaggle.com/c/titanic/overview

1.1.1 任务一:导入numpy和pandas

import numpy as np

import pandas as pd

注:如果加载失败,学会如何在python环境下安装numpy和pandas这两个库。

1.1.2 任务二:载入数据

#使用相对路径

df = pd.read_csv('train.csv')

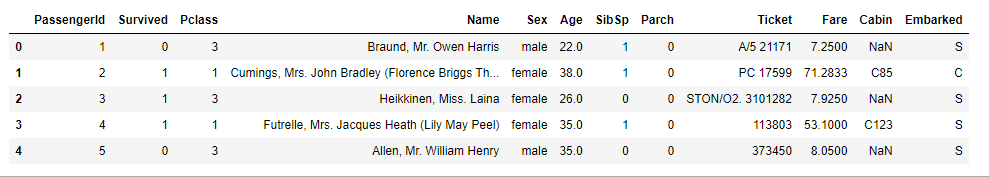

df.head()

#使用绝对路径

df = pd.read_csv("C:\\Users\\lenovo\\train.csv")

df.head()

【思考】知道数据加载的方法后,试试pd.read_csv()和pd.read_table()的不同,如果想让他们效果一样,需要怎么做?了解一下’.TSV’和’.CSV’的不同,如何加载这两个数据集?

df = pd.read_table("train.csv")

df.head()

#与pd.read_csv()效果一致

df = pd.read_table("train.csv",sep=",")

df.head()

TSV文件与CSV文件的区别:

1.TSV 是Tab-separated values的缩写,即制表符分隔值。 相对来说CSV,Comma-separated values(逗号分隔值)更常见一些。

2.TSV与CSV的区别: 1)从名称上即可知道,TSV是用制表符(Tab,’\t’)作为字段值的分隔符;CSV是用半角逗号(’,’)作为字段值的分隔符;

2)IANA规定的标准TSV格式,字段值之中是不允许出现制表符的。

Python对TSV文件的支持: Python的csv模块准确的讲应该叫做dsv模块,因为它实际上是支持范式的分隔符分隔值文件(DSV,delimiter-separated values)的。 delimiter参数值默认为半角逗号,即默认将被处理文件视为CSV。 当delimiter=’\t’时,被处理文件就是TSV。

#读取.tsv文件

train=pd.read_csv('test.tsv', sep='\t')

1.1.3 任务三:每1000行为一个数据模块,逐块读取

chunker=pd.read_csv("train.csv",chunksize=1000)

for piece in chunker:

print(piece)

【思考】什么是逐块读取?为什么要逐块读取呢?

逐块读取就是将文本分成若干块;对于几百MB的CSV文件,可以直接使用pd.read_csv()进行读取。然而如果csv文件太大,达到几个GB,这种方法就不可取。这时应使用chunk,进行分块读取;通过设置chunksize的参数,控制每次迭代的大小;如上面的数据只有891行,参数设置1000后只迭代了一次;改成500试一下,循环打印了两次。

1.1.4 任务四:将表头改成中文,索引改为乘客ID

PassengerId => 乘客ID

Survived => 是否幸存

Pclass => 乘客等级(1/2/3等舱位)

Name => 乘客姓名

Sex => 性别

Age => 年龄

SibSp => 堂兄弟/妹个数

Parch => 父母与小孩个数

Ticket => 船票信息

Fare => 票价

Cabin => 客舱

Embarked => 登船港口

df = pd.read_csv('train.csv') # 在使用pandas的read_csv方法时,它默认会自动加上一列行号。index_col=0 去掉默认行号

df.columns = ['乘客ID', '是否幸存', '乘客等级(1/2/3等舱位)', '乘客姓名', '性别', '年龄', '堂兄弟/妹个数','父母与小孩个数','船票信息','票价','客舱','登船港口']

df = df.set_index('乘客ID') # 重新设 乘客ID 为索引,去掉默认会自动加上一列行号

df.head()

#结果同上

names=['乘客ID','是否幸存','仓位等级','姓名','性别','年龄','兄弟姐妹个数','父母子女个数','船票信息','票价','客舱','登船港口']

df = pd.read_csv('train.csv', names=names, index_col='乘客ID', header = 0)

df.head()#默认读取前5行

1.2 初步观察

导入数据后,你可能要对数据的整体结构和样例进行概览,比如:数据大小、有多少列,各列都是什么格式的,是否包含null等。

1.2.1 任务一:查看数据的基本信息

df.info()

df.describe()

#查看数据的基本信息的函数总结

df.info(): # 打印摘要

df.describe(): # 描述性统计信息

df.values: # 数据 <ndarray>

df.to_numpy() # 数据 <ndarray> (推荐)

df.shape: # 形状 (行数, 列数)

df.columns: # 列标签 <Index>

df.columns.values: # 列标签 <ndarray>

df.index: # 行标签 <Index>

df.index.values: # 行标签 <ndarray>

df.head(n): # 前n行

df.tail(n): # 尾n行

pd.options.display.max_columns=n: # 最多显示n列

pd.options.display.max_rows=n: # 最多显示n行

df.memory_usage(): # 占用内存(字节B)

1.2.2 任务二:观察表格前10行的数据和后15行的数据

#观察表格前10行的数据

df.head(10)

#观察表格后15行的数据

df.tail(15)

1.2.3 任务三:判断数据是否为空,为空的地方返回True,其余地方返回False

df.isnull().head()

【思考】对于一个数据,还可以从哪些方面来观察?

查看每列的平均数,方差,标准差等等。

1.3 保存数据

1.3.1 任务一:将你加载并做出改变的数据,在工作目录下保存为一个新文件train_chinese.csv

#注意:不同的操作系统保存下来可能会有乱码。大家可以加入encoding='GBK' 或者 encoding = utf-8

df.to_csv('train_chinese1.csv',encoding='GBK')

1.4 知道你的数据叫什么

我们学习pandas的基础操作,那么上一节通过pandas加载之后的数据,其数据类型是什么呢?

1.4.1 任务一:pandas中有两个数据类型DateFrame和Series,通过查找简单了解他们。然后自己写一个关于这两个数据类型的小例子

import numpy as np

import pandas as pd

data1 = {'apple':20,'banana':10,"orange":25,'lemon':30}

df1=pd.Series(data1)

df1

data2 = {'fruit':['apple','banana','orange','lemon'],

'price':[20,10,25,30]}

df2 = pd.DataFrame(data2)

df2

1.4.2 任务二:根据上节课的方法载入"train.csv"文件

df = pd.read_csv("train.csv")

df.head(3)

1.4.3 任务三:查看DataFrame数据的每列的名称

df.columns

1.4.4任务四:查看"Cabin"这列的所有值

df['Cabin'].head()

#结果同上

df.Cabin.head()

1.4.5 任务五:加载文件"test_1.csv",然后对比"train.csv",看看有哪些多出的列,然后将多出的列删除

#加载文件"test_1.csv"

df3 = pd.read_csv("test_1.csv")

df3.head(3)

#删除多余的列

del df3['a']

df3.head(3)

【思考】还有其他的删除多余列的方式吗?

df3.drop('a', axis=1, inplace=True)#参数axis为1表示在1轴(行)上搜索名字为a的对象,然后删除对象a对应的列。inplace=True会修改原本数据

df3.head()

1.4.6 任务六: 将[‘PassengerId’,‘Name’,‘Age’,‘Ticket’]这几个列元素隐藏,只观察其他几个列元素

df3.drop(['PassengerId','Name','Age','Ticket'], axis=1).head(3)

【思考】对比任务五和任务六,是不是使用了不一样的方法(函数),如果使用一样的函数如何完成上面的不同的要求呢?

使用drop()方法时,如果设置参数inplace=True,会替换原本的数据,如果设置为False则只是隐藏不显示。

1.5 筛选的逻辑

表格数据中,最重要的一个功能就是要具有可筛选的能力,选出我所需要的信息,丢弃无用的信息。

下面我们还是用实战来学习pandas这个功能。

1.5.1 任务一: 我们以"Age"为筛选条件,显示年龄在10岁以下的乘客信息

df = pd.read_csv("train.csv")

df[df['Age']<10].head()

1.5.2 任务二: 以"Age"为条件,将年龄在10岁以上和50岁以下的乘客信息显示出来,并将这个数据命名为midage

midage = df[(df['Age']>10)&(df['Age']<50)]

midage

1.5.3 任务三:将midage的数据中第100行的"Pclass"和"Sex"的数据显示出来

midage.loc[[100], ['Pclass', 'Sex']]

这里虽然取得了数据,但是有一个隐患—使用dataframe读取对象后,索引可能是乱的,我们需要重置索引才能确保取得需要的数据:

midage = midage.reset_index(drop=True)

#对dataframe做处理后索引可能是乱的。 drop=True就是把原来的索引index列去掉,重置index

1.5.4 任务四:使用loc方法将midage的数据中第100,105,108行的"Pclass","Name"和"Sex"的数据显示出来

midage.loc[[100,105,108], ['Pclass', 'Name','Sex']]

1.5.5 任务五:使用iloc方法将midage的数据中第100,105,108行的"Pclass","Name"和"Sex"的数据显示出来

midage.iloc[[100,105,108],[2,3,4]]

【思考】对比iloc和loc的异同。

1.loc:通过行标签索引行数据;

例:loc[n]表示索引的是第n行(index 是整数)

loc[‘d’]表示索引的是第’d’行(index 是字符)

有行索引可以没有字段取值,但有字段取值前必须得有行索引,而且行索引只能为标签索引形式来取,不能按切片形式来取。单取切片形式可以,只是索引为左闭右闭。

2.iloc:

通过行索引获取行数据,不能是字符,取索引必须按切片形式来取,不能按标签,这是与loc的不同。索引为左闭右开。iloc也可以取指定行列,只不过得按切片形式索引,不能直接拿标签索引来做。

建议:

当用行索引的时候, 尽量用 iloc 来进行索引; 而用标签索引的时候用 loc 。

1.6 了解你的数据吗?

开始之前,导入numpy、pandas包和数据

import numpy as np

import pandas as pd

#载入之前保存的train_chinese.csv数据,关于泰坦尼克号的任务,我们就使用这个数据

text = pd.read_csv('train_chinese.csv',encoding='gbk')

text.head()

1.6.1 任务一:利用Pandas对示例数据进行排序,要求升序

frame = pd.DataFrame(np.arange(8).reshape((2, 4)),

index=['2', '1'],

columns=['d', 'a', 'b', 'c'])

frame

【总结】下面将不同的排序方式做一个总结

1.让行索引升序排序

frame.sort_index()

2.让列索引升序排序

frame.sort_index(axis=1)

3.让列索引降序排序

frame.sort_index(axis=1,ascending = False)

4.让任选两列数据同时降序排序

frame.sort_values(by = ['a','c'],ascending = False)

1.6.2 任务二:对泰坦尼克号数据(trian.csv)按票价和年龄两列进行综合排序(降序排列),从这个数据中你可以分析出什么?

df.sort_values(by = ['票价','年龄'],ascending=False).head(20)

【思考】排序后,如果我们仅仅关注年龄和票价两列。根据常识我们发现票价越高的应该客舱越好,所以我们会明显看出,票价前20的乘客中存活的有14人,这是相当高的一个比例,那么我们后面是不是可以进一步分析一下票价和存活之间的关系,年龄和存活之间的关系呢?当你开始发现数据之间的关系了,数据分析就开始了。

1.6.3 任务三:利用Pandas进行算术计算,计算两个DataFrame数据相加结果

#建立一个例子

frame1_a = pd.DataFrame(np.arange(9.).reshape(3, 3),

columns=['a', 'b', 'c'],

index=['one', 'two', 'three'])

frame1_b = pd.DataFrame(np.arange(12.).reshape(4, 3),

columns=['a', 'e', 'c'],

index=['first', 'one', 'two', 'second'])

frame1_a

frame1_b

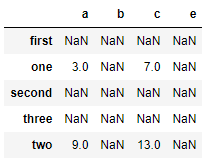

frame1_a + frame1_b

两个DataFrame相加后,会返回一个新的DataFrame,对应的行和列的值会相加,没有对应的会变成空值NaN。

当然,DataFrame还有很多算术运算,如减法,除法等,有兴趣的同学可以看《利用Python进行数据分析》第五章 算术运算与数据对齐 部分,多在网络上查找相关学习资料。

1.6.4 任务四:通过泰坦尼克号数据如何计算出在船上最大的家族有多少人?

max(df['堂兄弟/妹个数'] + df['父母与小孩个数'])

1.6.5 任务五:学会使用Pandas describe()函数查看数据基本统计信息

frame2 = pd.DataFrame([[1.4, np.nan],

[7.1, -4.5],

[np.nan, np.nan],

[0.75, -1.3]

], index=['a', 'b', 'c', 'd'], columns=['one', 'two'])

frame2

调用 describe 函数,观察frame2的数据基本信息

frame2.describe()

1.6.6 任务六:分别看看泰坦尼克号数据集中 票价、父母子女 这列数据的基本统计数据,你能发现什么?

df['票价'].describe()

从票价数据我们可以看出, 一共有891个票价数据, 平均值约为:32.20, 标准差约为49.69,说明票价波动特别大, 25%的人的票价是低于7.91的,50%的人的票价低于14.45,75%的人的票价低于31.00, 票价最大值约为512.33,最小值为0。

df['父母与小孩个数'].describe()

从上面数据我们可以看出, 一共有891个数据, 每个家庭父母与孩子的平均个数几乎为0,最多可达到6个,标准差约为0.81,最小值为0。

总结

本节中我们通过Pandas的一些内置函数对数据进行了初步统计查看,这个过程最重要的不是大家得掌握这些函数,而是看懂从这些函数出来的数据,构建自己的数据分析思维,这也是第一章最重要的点。

参考资料

https://blog.csdn.net/weixin_44818729/article/details/107357334

https://blog.csdn.net/qq_37975685/article/details/107953941

https://www.cnblogs.com/herj-0925/p/14883542.html

https://blog.csdn.net/Leon_Kbl/article/details/97492966

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?