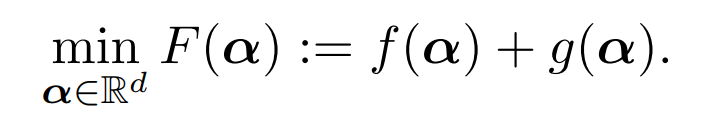

机器学习中的优化问题是一个长久而古老的问题,下面介绍一种经典方法:

APG方法(或者称为FISTA方法)的步骤为:

迭代复杂度为:

F ( α k ) − F ( α ) ≤ O ( 1 k 2 ) F(\alpha^{k})-F(\alpha)\leq O(\frac{1}{k^2}) F(αk)−F(α)≤O(k21).

step3中等式第二项称为momentum of sequence { α k } k = 1 ∞ \{\alpha_{k}\}_{k=1}^{\infty} {αk}k=1∞.

尽管APG方法具有很强的迭代复杂度,但对于实际应用来说,它仍然不够有效。在下面,我们描述了几种著名的策略,使APG方法实际有效。

1.Backtracking Strategy

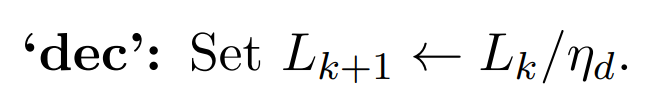

2.Decreasing Strategy for

L

k

L_{k}

Lk.

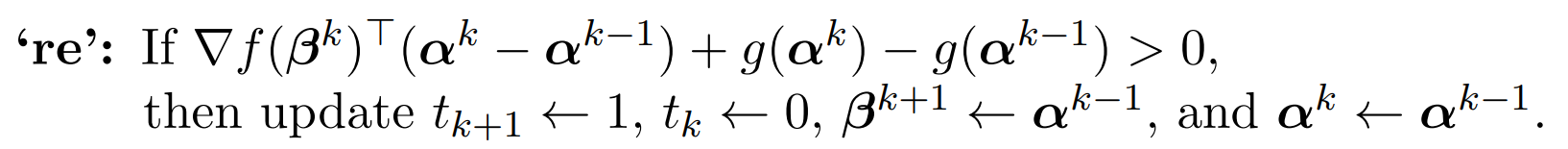

3. Restarting Strategy

415

415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?