1.概述

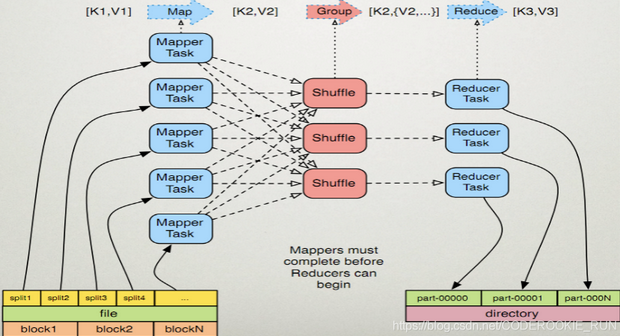

MapReduce概述:

MapReduce的思想核心是分而治之,适用于大量复杂的任务处理场景(大规模数据处理场景)。

最主要的特点就是把一个大的问题,划分成很多小的子问题,并且每个小的子问题的求取思路与我们大问题的求取思路一样。

最主要有两个阶段:

一个map阶段,负责拆分;一个是reduce阶段,负责聚合

一个文件切块(Split)对应一个mapTask。mapreduce没有block的概念,默认一个切块(Split)对应block块的大小(128M)

小文件越多,mapTask就越多,io输出越多,影响性能

MapReduce处理的数据类型是<key,value>键值对

2. MapReduce运行流程:(重点记)

八个步骤:

1、 读取文件,解析成<key,value>对,输出<k1,v1>

2、接收<k1,v1>,自定义我们的map逻辑,输出<k2,v2>

3、分区

4、排序

5、规约

6、分组

7、接收<k2,v2>,自定义reduce逻辑,转换成新的<k3,v3>进行输出

8、将<k3,v3>进行输出

3.用java代码实现八个步骤

编写实现类:用来描述job并提交job

package cn.twy.wordcount;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.TextInputFormat;

import org.apache.hadoop.mapreduce.lib.output.TextOutputFormat;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner;

public class MainCount extends Configured implements Tool {

@Override

public int run(String[] strings) throws Exception {

//获取任务

Job job = Job.getInstance(super.getConf(), "wordcount");

//指定输入类

job.setInputFormatClass(TextInputFormat.class);

TextInputFormat.addInputPath(job,new Path("E:\\wordcount\\input"));

//指定Mapper

job.setMapperClass(WordCountMapper.class);

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(IntWritable.class);

//设置Reduce

job.setReducerClass(WordCountReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

//设置输出类,以及输出路径

job.setOutputFormatClass(TextOutputFormat.class);

TextOutputFormat.setOutputPath(job,new Path("E:\\wordcount\\output"));

boolean b = job.waitForCompletion(true);

return b?0:1;

}

public static void main(String[] args) throws Exception {

//获取配置文件

Configuration configuration = new Configuration();

//获取任务

int run = ToolRunner.run(configuration, new MainCount(), args);

System.exit(run);

}

}

定义一个mapper类

package cn.twy.wordcount;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

public class WordCountMapper extends Mapper<LongWritable,Text,Text,IntWritable> {

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

//切分行,得到单词数组

String s = value.toString();

String[] split = s.split(",");

//每个单词记作1,得到<k2,v2>,发出

for (int i = 0; i < split.length; i++) {

context.write(new Text(split[i]),new IntWritable(1));

}

}

}

定义一个reducer类:

package cn.twy.wordcount;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

public class WordCountReducer extends Reducer<Text,IntWritable,Text,IntWritable> {

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum =0;

//values累加

for (IntWritable value : values) {

int i = value.get();

sum+=i;

}

//发出<k3,v3>

context.write(key,new IntWritable(sum));

}

}

运行结果:

输出文件的目录不能创建,程序自己会创建。目录已存在的话,程序会报错,无法正常执行

将代码打包成jar包,放到集群上执行

需要在MainCount.java代码添加,指定main方法所在的java类

//如果打包到集群上运行,需要添加一句,指定main方法所在的java类

job.setJarByClass(MainCount.class);

在linux上执行以下命令:

# hadoop jar jar包 指定入口类

hadoop jar hadoop_hdfs_operate-1.0-SNAPSHOT.jar cn.itcast.wordcount MainCount

在本地文件上运行:

修改输入和输出路径

TextInputFormat.setInputPaths(job, new Path("file:///G:\\wordcount\\input"));

TextOutputFormat.setOutputPath(job, new Path("file:///G:\\wordcount\\output"));

278

278

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?