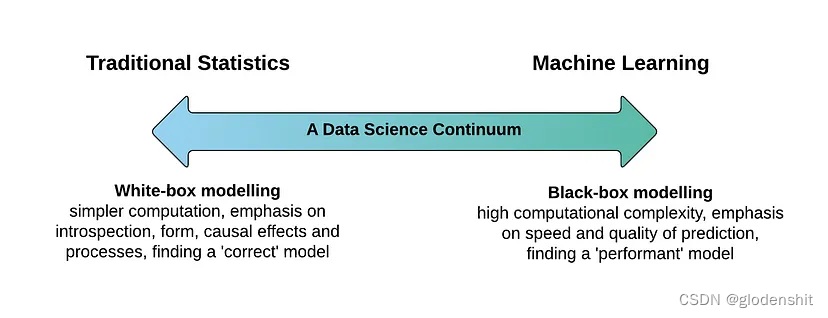

** 黑盒模型与白盒模型**

大多数机器学习系统都需要向利益相关者解释为什么会做出某些预测。在选择合适的机器学习模型时,我们通常会考虑准确性与可解释性之间的权衡:

精确度和“黑箱”:黑箱模型,如神经网络、梯度增强模型或复杂的集合,通常提供很高的精度。这些模型的内部工作更难理解,它们不能提供每个特征对模型预测的重要性的估计,也不容易理解不同特征之间的相互作用。

weak和“白盒”:另一方面,线性回归和决策树等更简单的模型提供了更少的预测能力,并且不总是能够建模数据集的固有复杂性(即特征交互)。然而,它们更容易解释和解释。

准确性与可解释性的权衡基于一个重要假设,即“可解释性是模型的固有属性”。

然而,我坚信,使用正确的“可解释性技术”,任何机器学习模型都可以变得更具可解释性,尽管某些模型的复杂性和成本比其他模型更高。

文章探讨了在机器学习中,黑盒模型如神经网络和白盒模型如线性回归之间的权衡。黑盒模型通常具有高精度但低可解释性,而白盒模型则相反。作者认为,通过使用适当的可解释性技术,任何模型都能提高其可解释性,尽管这可能增加复杂性和成本。

文章探讨了在机器学习中,黑盒模型如神经网络和白盒模型如线性回归之间的权衡。黑盒模型通常具有高精度但低可解释性,而白盒模型则相反。作者认为,通过使用适当的可解释性技术,任何模型都能提高其可解释性,尽管这可能增加复杂性和成本。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?