glom的作用是将同一个分区中的数据转化为相同类型的数组,分区不变。

以下案例是计算每个分区中的最大值的和。

package com.atguigu.bigdata.spark.core.rdd.operator.transform

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark05_RDD_Operator_Transform_Test {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - glom

val rdd : RDD[Int] = sc.makeRDD(List(1,2,3,4), 2)

// 【1,2】,【3,4】

// 【2】,【4】

// 【6】

val glomRDD: RDD[Array[Int]] = rdd.glom()

val maxRDD: RDD[Int] = glomRDD.map(

array => {

array.max

}

)

println(maxRDD.collect().sum)

sc.stop()

}

}

ps:使用aggregateByKey可以更简便的解决。

package com.atguigu.bigdata.spark.core.rdd.operator.transform

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark17_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(

("a", 1), ("a", 2), ("a", 3), ("a", 4)

),2)

// (a,【1,2】), (a, 【3,4】)

// (a, 2), (a, 4)

// (a, 6)

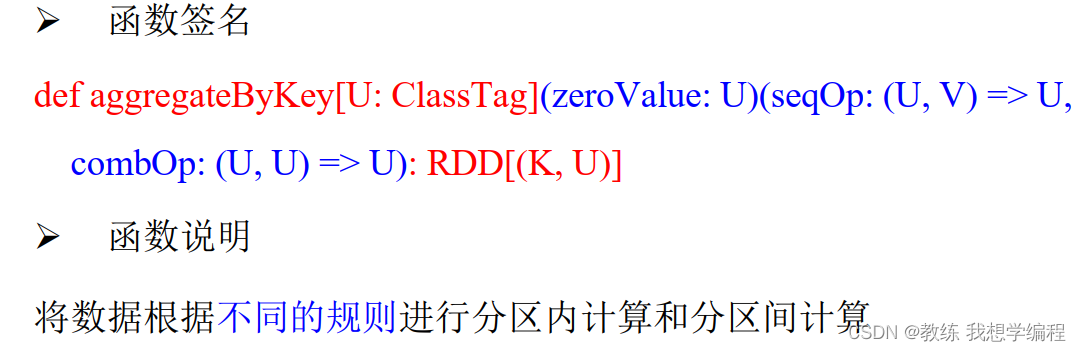

// aggregateByKey存在函数柯里化,有两个参数列表

// 第一个参数列表,需要传递一个参数,表示为初始值

// 主要用于当碰见第一个key的时候,和value进行分区内计算

// 第二个参数列表需要传递2个参数

// 第一个参数表示分区内计算规则

// 第二个参数表示分区间计算规则

// math.min(x, y)

// math.max(x, y)

rdd.aggregateByKey(0)(

(x, y) => math.max(x, y),

(x, y) => x + y

).collect.foreach(println)

sc.stop()

}

}

以上摘自尚硅谷教程

305

305

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?