Protecting Facial Privacy: Generating Adversarial Identity Masks via Style-robust Makeup Transfer

翻译:保护面部隐私:通过风格稳健的化妆转移生成对抗身份面具

Keywords:

GAN,风格迁移,黑盒攻击

Summary

文章提出了通过cycle GAN来进行化妆风格的迁移,并通过参考图像,生成对抗样本,在视觉质量上获得了提升,但是正文中展现的效果是精心挑选的,实际上,还有很多对抗样本的视觉质量不太好,这部分内容在附录中可以窥见一二,附录中两部分可视化是关于效果对比和消融的可视化的,这部分也证明了其模块的有效性。

Problem Statement

人脸识别系统对个人隐私产生了极大威胁,FR系统可以通过大规模照片分析[ 16、31]来识别社交媒体简介和跟踪用户关系。这种对用户的过度监控迫切需要一种有效的方法来帮助个人保护他们的人脸图像免受未经授权的FR系统的攻击。

现有的基于生成式的对抗人脸样本有一些局限性:(1)模型的可达性,现有方法大多基于白盒攻击或者是基于查询的黑盒攻击,但是跟踪模型是不可知的,这里提出了对泛化性的要求。(2)视觉质量,现有基于patch的方法大多产生的是奇怪的、明显的改变,基于扰动的方法产生的噪声视觉效果也比较差。(3)迁移性弱,现有技术对商用API的攻击效果比较差。

文章提出了不通过梯度进行攻击,而是在保持攻击能力前提下,组织扰动,虽然扰动是视觉可见的,并且遍布的干净样本的大部分区域上,但是它们看起来是自然舒适的。以此提出了通过化妆来进行攻击。

Methodology used

ATM - GAN首先利用一组生成对抗网络构建可以从参考图像继承化妆风格的对抗样本。为了调和化妆转移中的对抗噪声和循环一致性损失之间的矛盾,利用编码器-解码器架构的解纠缠功能和图像超分辨率中的残差稠密块,引入了新设计的正则化模块。因此,可以在循环重建阶段兼容地缓解对抗毒性,使得生成器专注于在具有对抗特征的源域和目标风格域之间建立鲁棒的映射。

此外,我们引入了一种联合训练策略,将GAN训练中传统的G - D博弈和新设计的正则化模块集成在一起,并引入了可迁移性增强过程,以鼓励生成器捕获、模仿和重构能够在不同模型之间有效迁移的共同对抗特征。据我们所知,我们提出了第一个联合训练框架来解决当使用图像到图像的转换GAN来制作对抗样本时,生成器的循环一致性和域映射的崩溃现象。当考虑GAN时,我们的联合训练框架可以扩展到其他安全敏感领域,例如深度伪造[ 35 ]。综上所述,贡献如下:

- AMT - GAN,视觉质量更高的攻击

- 我们设计了一个基于特征解耦的正则化模块来提高对抗图像的视觉质量,然后开发了一个联合训练管道来训练生成器、判别器和正则化模块,使得生成器可以同时完成两个任务(即化妆-转移和对抗攻击),并在不同的数据流形之间建立鲁棒的映射。

- 在商用模型上Face++ , Aliyun, and Microsoft进行了测试,超有SOTA方法4% ∼ 60%。

问题定义

考虑有目标攻击,可以表示为:

D ( ⋅ ) D(·) D(⋅) 表示距离函数,如交叉熵或余弦相似度, M k M_k Mk 代表基于DNN的人脸识别的特征提取器, x A x^A xA 和z 分别表示对抗人脸样本和目标人脸样本。

对于化妆转移,令 X , Y ∈ R H × W × 3 X,Y \in R^{H × W × 3} X,Y∈RH×W×3 分别表示源图像和参考图像的化妆风格域。这里,我们用 x ∈ X x \in X x∈X 和 y ∈ Y y \in Y y∈Y分别表示干净的人脸图像和 x A ∈ X x^A \in X xA∈X 和 y A ∈ Y y^A \in Y yA∈Y 分别表示对抗的人脸图像。对抗化妆迁移期望训练一个函数 G : x , y → y ~ x A G:{ x,y }→ \tilde{y}^A_x G:x,y→y~xA,其中对抗图像 y ~ x A \tilde{y}^A_x y~xA 与 y y y 具有相同的化妆风格,与 x x x 具有相同的视觉身份。

结构细节

生成器 G G G 和判别器 D X D_X DX, D Y D_Y DY。

- G G G:用于生成对抗样本,即将 x x x向 Y Y Y域迁移,并具有攻击效果。

- D X D_X DX, D Y D_Y DY:用于区分 G G G生成的伪图像与真实图像的分布。

正则化模块

为了增强化妆迁移的效果,文章使用了循环一致性损失,

∣

∣

⋅

∣

∣

1

||\cdot||_1

∣∣⋅∣∣1 represents the L1 norm

这里存在一个疑惑,循环一致性损失是cycleGAN中提出的内容,其中生成器有两个,分别处理

X

→

Y

X \rightarrow Y

X→Y 和

X

←

Y

X \leftarrow Y

X←Y。而这里,文章通过一个生成器来处理。

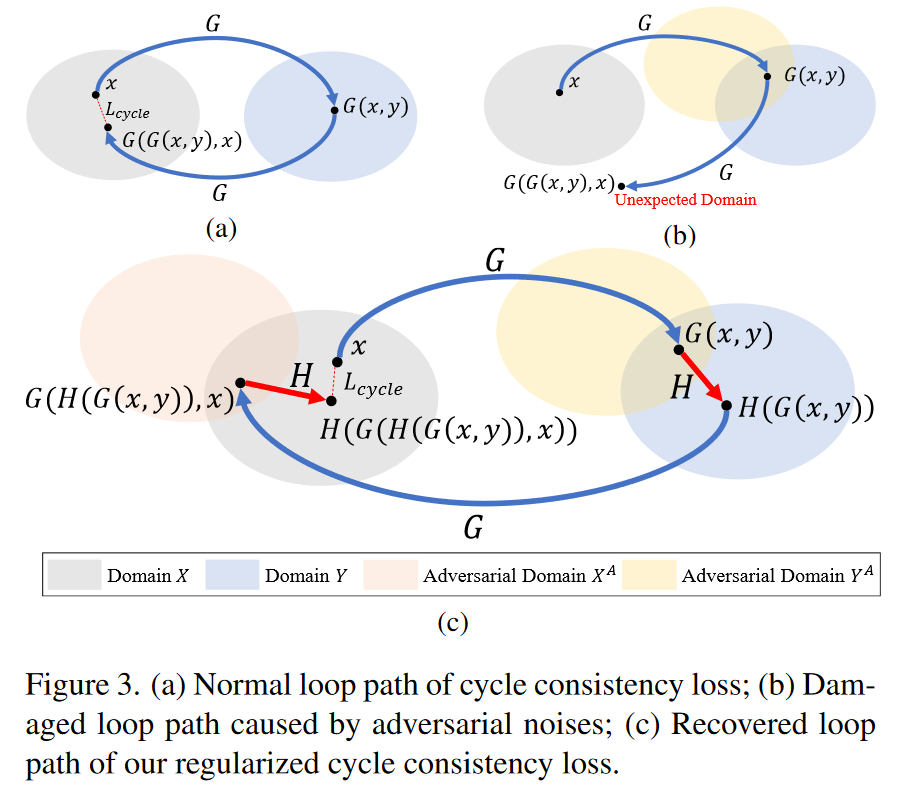

但是,生成器产生的化妆迁移样本是对抗性的,它可能与循环一致性损失存在冲突,即生成的样本可能无法被生成器正确的提取特征,并转化回干净域,如图中b。

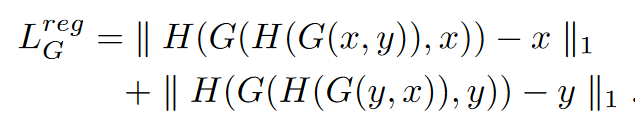

所以文章给出了一个解决办法,通过一个正则化模块,清洗对抗样本中的对抗性,保留内容、风格、维度。这里,文章选择了residual-in-residual dense block (RRDB)来作为高效的正则化模块。通过将对对抗样本做清晰,建立干净样本的循环一致性损失。所以循环一致性损失可以表示为:

为了训练正则化模块对对抗样本的清洗效果,还原干净样本的视觉质量,通过判别器来作为正则化模块的指导。这里零和博弈建立在生成器和判别器上,不与正则化模块产生关联,即判断器不再通过正则化模块优化。

可移植性增强模块 M M M

M M M 由多个预训练的人脸识别模型组成,用于模仿潜在目标的决策边界。

其中, M k M_k Mk表示第 k k k个局部预训练白盒模型的特征提取器,我们使用余弦相似度作为距离函数。 T ( ⋅ ) T ( \cdot ) T(⋅)表示变换函数, p p p是预先定义的 G ( x , y ) G( x , y) G(x,y)上是否进行变换的概率。具体地,我们选择图像缩放和高斯噪声作为变换函数。

两者都可以降低对抗样本的攻击强度,而对抗样本的修改在不同的黑盒模型之间具有微弱的可转移性。

H

H

H 的对抗攻击损失可以定义为:

需要说明的是,由于H不具有可转移性,因此不包含输入多样性。

辅助块

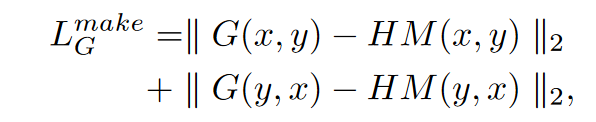

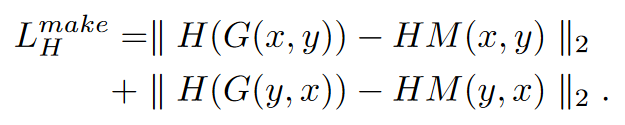

直方图匹配[ 23 ],记为HM ( x , y),通常用于模拟参考y的颜色分布,同时保留x的内容信息。在这里,我们使用这个目标函数来保证嘴唇、眼影和人脸区域的化妆相似性以及H的重建能力。

此外,当参考图像为源图像本身时,期望生成器G和正则化模块H能够保留原始内容和风格信息,称为自重建。该目标对于生成器G保持资源图像的结构信息,避免人脸属性失真具有重要意义。自重构路径定义为:

其中LPIPS [ 42 ]函数衡量两幅图像之间的感知相似性。

全部的损失

L D = L D g a n Λ T L_D = L^{gan}_D \Lambda ^T LD=LDganΛT

L G = ( L G g a n , L G r e g , L G a d v , L G m a k e , L G , H i d t ) Λ T L_G = (L^{gan}_G , L^{reg}_G , L^{adv}_G , L^{make}_G , L^{idt}_{G,H} )\Lambda^T LG=(LGgan,LGreg,LGadv,LGmake,LG,Hidt)ΛT

L H = ( L H g a n , L H a d v , L H m a k e , L G , H i d t ) Λ T L_H = (L^{gan}_H , L^{adv}_H , L^{make}_H , L^{idt}_{G,H} )\Lambda^T LH=(LHgan,LHadv,LHmake,LG,Hidt)ΛT

Λ = ( λ g a n , λ r e g , λ a d v , λ m a k e , λ i d t ) \Lambda = (\lambda_{gan}, \lambda_{reg}, \lambda_{adv}, \lambda_{make}, \lambda_{idt}) Λ=(λgan,λreg,λadv,λmake,λidt)

Experiment

实验设置

生成器和两个判断器根据[19].

超参数:

λ

g

a

n

,

λ

r

e

g

,

λ

a

d

v

,

λ

m

a

k

e

,

λ

i

d

t

\lambda_{gan}, \lambda_{reg}, \lambda_{adv}, \lambda_{make}, \lambda_{idt}

λgan,λreg,λadv,λmake,λidt 设置为 10, 10, 5, 2, 5 .

优化器: Adam optimizer [21] 学习率: 0.0002, 指数衰减率 (β1, β2) = (0.5, 0.999) .

需要继续跟进的内容

[16]Kashmir Hill. The secretive company that might end privacy as we know it. The New York Times, 18:2020, 2020. 2

[19]Wentao Jiang, Si Liu, Chen Gao, Jie Cao, Ran He, Jiashi Feng, and Shuicheng Yan. PSGAN: pose and expression robust spatial-aware GAN for customizable makeup transfer. In Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR’20), pages 5193–5201, 2020. 3, 6, 7, 8

[31]Yan Shoshitaishvili, Christopher Kruegel, and Giovanni Vigna. Portrait of a privacy invasion. Proc. Priv. Enhancing Technol., 2015(1):41–60, 2015. 2

[35]Mika Westerlund. The emergence of deepfake technology: A review. Technology Innovation Management Review, 9(11), 2019. 2

[42]Richard Zhang, Phillip Isola, Alexei A. Efros, Eli Shechtman, and Oliver Wang. The unreasonable effectiveness of deep features as a perceptual metric. In Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR’18), pages 586–595, 2018. 6

184

184

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?