本次遇到这个问题,才认识到多年以来困扰我的共享问题,原来是SMB版本有讲究。

原来Windows 10 早就摒弃了SMB1.0,之前开windows网络共享有问题,一些教程老是让人去安装windows组件SMB1.0的,原来都是错误的认知或者没有说明白个所以然的。Win10其实是自带默认开启了SMB3版本的协议,正是因为版本太高,导致以往的其他一些旧系统旧设备无法正常登录到共享的文件夹,所以才有各种误导教程让大家去开SMB1.0。

在升级了群晖DSM7版本后,群晖也默认将安全性不高的SMB1.0关闭了,只留SMB2以上,所以我又遇到了同样的问题:在群晖开了共享后,我的华为平板、电视机怎么也连不上群晖的共享。

我在查了各种资料后,网上也有将群晖的SMB降级最低版本为SMB1.0的,但我实在忍受不了那个刺眼的提示说“强烈建议您不要使用SMB1.0模式……”,为保证NAS系统的安全性,决定不按别人的教程行事。

我分了两步走:

一:确保影音系统能访问NAS:开启DLNA多媒体功能:

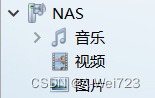

装完后电脑多了一个媒体设备,电视不需要密码进去,进去后清清爽爽的只有三个东西:音乐/视频/图片,其余不想共享给电视的,都看不见,还能帮你归类:

二:保留SMB高版本,在访问不了SMB3的的华为平板上安装支持SMB的文件管理器(CX文件管理器)

这样,平板也能正常访问了。

至此,共享功能大概是搞得清清楚楚了。

7453

7453

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?