一、概念与基础

1、名字由来

阿瑟.萨缪尔Arthur Samuel,1952年研制了一个具有自学习能力的西洋跳棋程序,1956年应约翰.麦卡锡John McCarthy(人工智能之父)之邀,在标志着人工智能学科诞生的达特茅斯会议上介绍这项工作。他发明了“机器学习”这个词,将其定义为“不显示编程地赋予计算机能力的研究领域”。

2、假设空间hypothesis space

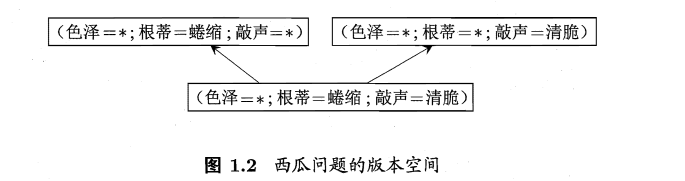

3、版本空间version space

4、归纳偏好inductive bias

机器学习算法在学习过程中对某种类型假设的偏好。如果没有偏好,产生的模型每次在进行预测时随机抽选训练集上的等效假设,那么对这个新输入,学得模型时而告诉我们它是好的、时而告诉我们它是不好的,这样的学习结果显然没有意义。

归纳偏好对应了学习算法本身所做出的关于"什么样的模型更好"的假设。在具体的现实问题中,这个假设是否成立,即算法的归纳偏好是否与问题本身匹配,大多数时候直接决定了算法能否取得好的性能。

5、“奥卡姆剃刀”Occam’s razor

常用的、自然科学研究中最基本的原则,即“若有多个假设与观察一致,则选最简单的那个”(在回归学习中一般认为更平滑意味着更简单)

6、“没有免费的午餐”定理No Free Lunch Theorm,NFL

无论学习算法1多聪明、学习算法2多笨拙,他们的总误差与学习算法无关,期望性能相同。

→ 若考虑所有潜在问题,则所有学习算法都一样好,要谈论算法的相对优劣,必须针对具体的学习问题,学习算法自身的归纳偏好与问题是否相配,往往会起到决定性作用。

7、机器学习5种学习方法

1、监督学习supervised learning:是利用已知类别的样本(即有标记的样本 labeled sample,已知其相应的类别),调整分类器的参数,训练得到一个最优模型,使其达到所要求性能,再利用这个训练后的模型,将所有的输入映射为相应的输出,对输出进行简单的判断,从而实现分类的目的,这样,即可以对未知数据进行分类。

2、无监督学习unsupervised learning:把相似度高的东西放在一起,对于新来的样本,计算相似度后,按照相似程度进行归类就好。

3、半监督学习semi-supervised learning:处在监督学习和无监督学习之间的是半监督学习。Semi-Supervised Learning中使用的数据,有一部分是标记过的,而大部分是没有标记的。因此和监督学习相比,半监督学习的成本较低,但是又能达到较高的准确度。

4、强化学习reinforcement learning:所谓强化学习就是智能系统从环境到行为映射的学习,以使奖励信号(强化信号)函数值最大,强化学习不同于连接主义学习中的监督学习,主要表现在教师信号上,强化学习中由环境提供的强化信号是对产生动作的好坏作一种评价(通常为标量信号),而不是告诉强化学习系统RLS(reinforcement learning system)如何去产生正确的动作。(相当于先无监督后有监督)

5、迁移学习transfer learning:考虑到大部分数据或任务是存在相关性的,所以通过迁移学习我们可以将已经学到的参数(parameter)分享给新模型从而加快并优化模型的学习,不用像之前那样从零开始,把已训练好的模型参数迁移到新的模型来帮助新模型训练数据集。

未完待续,喜欢的朋友可以关注后续文章~

参考书目:

周志华.《机器学习》

邱锡鹏.《神经网络与深度学习》

485

485

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?