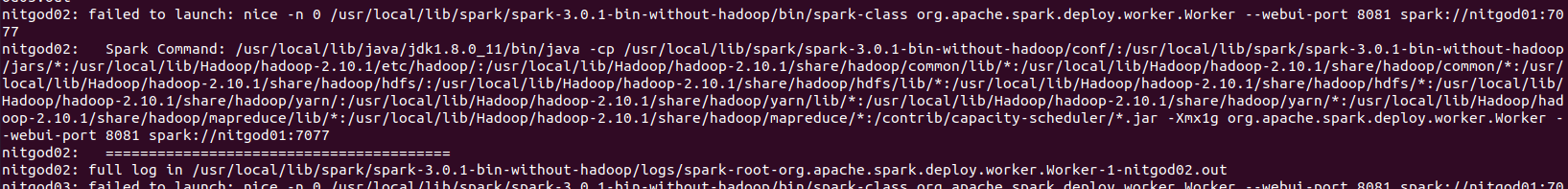

如图,日志信息也看不出什么内容。网上找了半天都是说各种加Java配置信息的,还有加Hadoop相关jar包的,但试了都没用。

直到后来试了试

spark-shell结果打印了以下信息

百度了以下才发现原来是Scala和jdk版本兼容问题, 我原来是jdk1.8.0_11,Scala2.12.11,,后来把jdk换成1.8.0_181后完美解决

附上jdk1.8.0_181,Linux的

链接:https://pan.baidu.com/s/12wDfVy_0OaZ8YwFGT70b-Q

提取码:95z7

复制这段内容后打开百度网盘手机App,操作更方便哦

1363

1363

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?