一、线性回归模型

线性模型:试图学习一个通过属性的线性组合进行预测的函数。

f

(

x

)

=

w

1

x

1

+

w

2

x

2

+

.

.

.

+

w

d

x

d

+

b

f(x)=w_1x_1+w_2x_2+...+w_dx_d+b

f(x)=w1x1+w2x2+...+wdxd+b,w为权重,b称为偏置项,可以理解为:

w

0

×

1

w_0×1

w0×1

线性回归定义:线性回归通过一个或者多个自变量与因变量之间之间进行建模的回归分析。其中特点为一个或多个称为回归系数的模型参数的线性组合。

一元线性回归:涉及到的变量只有一个

多元线性回归:涉及到的变量两个或两个以上

通用公式:

h

(

w

)

=

w

0

+

w

1

x

1

+

w

2

x

2

+

…

=

w

T

x

ℎ(w)= w_0+w_1x_1+w_2x_2+…= w^Tx

h(w)=w0+w1x1+w2x2+…=wTx

其中w,x为矩阵:

w

=

(

w

0

,

w

1

,

w

2

)

T

,

x

=

(

1

,

x

1

,

x

2

)

T

w = (w_0,w_1,w_2)^T, x = (1,x_1,x_2)^T

w=(w0,w1,w2)T,x=(1,x1,x2)T

二、损失函数与最小二乘法

y

i

y_i

yi为第i个训练样本的真实值

h

w

(

x

i

)

ℎ_w(x_i)

hw(xi)为第i个训练样本特征值组合预测函数

总损失定义:

J

(

θ

)

=

(

h

w

(

x

1

)

−

y

1

)

2

+

(

h

w

(

x

2

)

−

y

2

)

2

+

…

+

(

h

w

(

x

m

)

−

y

m

)

2

J(θ)= (ℎ_w(x_1) −y_1)^2+(ℎ_w(x_2) −y_2)^2+…+(ℎ_w(x_m) −y_m)^2

J(θ)=(hw(x1)−y1)2+(hw(x2)−y2)2+…+(hw(xm)−ym)2

=

∑

i

m

(

h

w

(

x

i

)

−

y

i

)

2

= \sum_i^m(ℎ_w(x_i)−y_i)^2

=∑im(hw(xi)−yi)2

又称最小二乘法

目的是找到最小损失对应的W值

求解W值的方法有

方法一:最小二乘法之正规方程

求解:

w

=

(

X

T

X

)

−

1

X

T

y

w=(X^TX)^{−1}X^Ty

w=(XTX)−1XTy

X为特征值矩阵,y为目标值矩阵

方法二:最小二乘法之梯度下降

以单变量中的w0,w1为例子:

w

1

=

w

1

−

α

∂

c

o

s

t

(

w

0

+

w

1

x

1

)

∂

w

1

w_1=w_1-\alpha \frac{\partial cost(w_0+w_1x_1)}{\partial w_1 }

w1=w1−α∂w1∂cost(w0+w1x1)

w

0

=

w

0

−

α

∂

c

o

s

t

(

w

0

+

w

1

x

1

)

∂

w

0

w_0=w_0-\alpha \frac{\partial cost(w_0+w_1x_1)}{\partial w_0 }

w0=w0−α∂w0∂cost(w0+w1x1)

α为学习速率,需要手动指定

−

∂

c

o

s

t

(

w

0

+

w

1

x

1

)

∂

w

1

-\frac{\partial cost(w_0+w_1x_1)}{\partial w_1 }

−∂w1∂cost(w0+w1x1)表示方向,沿着这个函数下降的方向找,最后就能找到山谷的最低点,然后更新W值面对训练数据规模十分庞大的任务时使用。

scikit-learn:优点:封装好,建⽴模型简单,预测简单

缺点:算法的过程,有些参数都在算法API内部优化

tensorflow:封装⾼低, ⾃⼰实现线性回归,学习率等等

回归性能评估:均方误差(Mean Squared Error)MSE= ∑ i = 1 m ( y i ^ − y i ) 2 m \frac{\sum_{i=1}^m(\hat{y_i}-y_i)^2}{m} m∑i=1m(yi^−yi)2, y i ^ \hat{y_i} yi^为预测值, y i y_i yi为真实值。

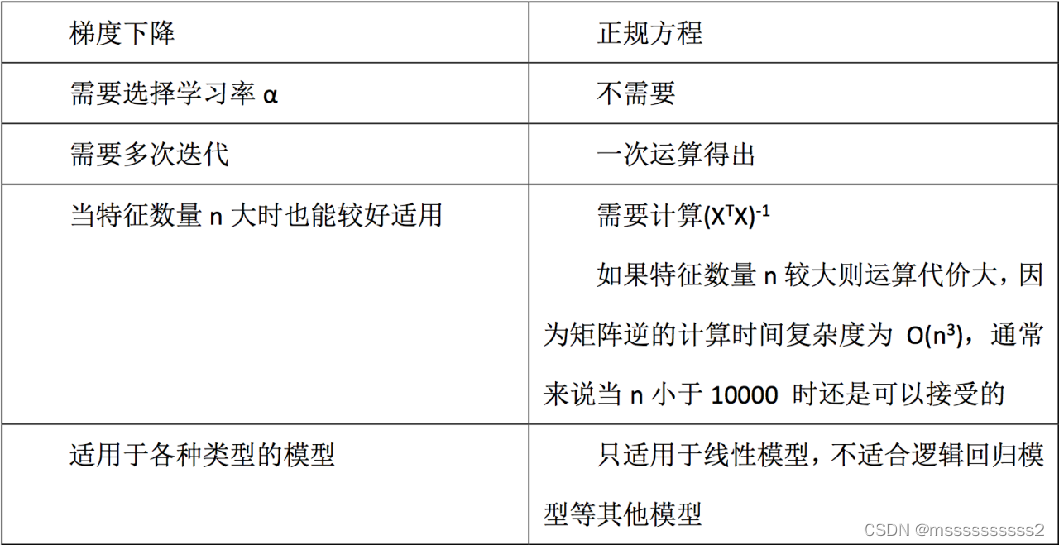

数据量超过10万通过梯度下降,否则用正规方程

三、过拟合、欠拟合

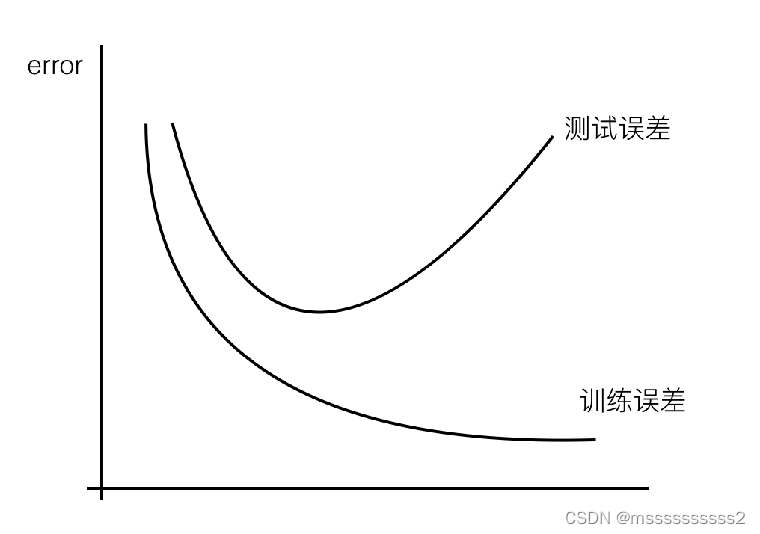

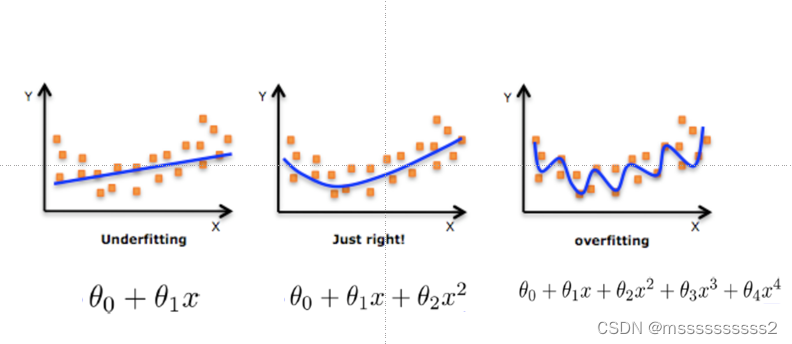

过拟合:一个假设在训练数据上能够获得比其他假设更好的拟合, 但是在训练数据外的数据集上却不能很好地拟合数据,此时认为这个假设出现了过拟合的现象。(模型过于复杂)

欠拟合:一个假设在训练数据上不能获得更好的拟合, 但是在训练数据外的数据集上也不能很好地拟合数据,此时认为这个假设出现了欠拟合的现象。(模型过于简单)

简而言之,根据结果现象判断欠拟合、过拟合。训练集、测试集结果都不行为欠拟合,训练集结果好测试集结果不好为过拟合。

线性回归可以拟线性的数据也可以拟合非线性的数据,模型复杂的原因是数据目标与特征之间的关系不仅仅是线性关系。

欠拟合原因是学习到数据的特征过少,解决办法是增加数据的特征数量。

过拟合原因:原始特征过多,存在一些嘈杂特征,模型过于复杂是因为模型尝试去兼顾各个测试数据点。解决办法:

进行特征选择,消除关联性大的特征(很难做);

交叉验证(让所有数据都有过训练);

正则化(了解):岭回归;

四、岭回归

线性回归:LInearRegression 容易出现过拟合,为了把训练集数据表现更好

L2正则化:Ridge:岭回归 带有正则化的线性回归 解决过拟合

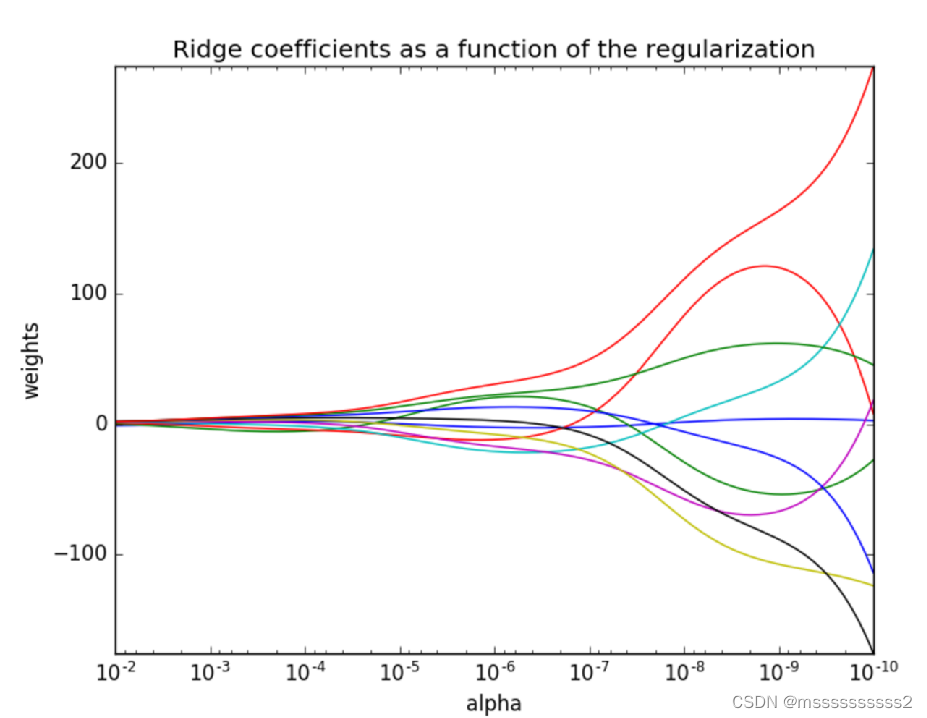

使用L2正则化,作用:可以使得W的每个元素都很小,都接近于0

优点:越小的参数说明模型越简单,越简单的模型则越不

容易产生过拟合现象。

apha越大,W中的参数越趋于0,一般取值为0至1或1至10。

岭回归:回归得到的回归系数更符合实际,更可靠。另外,能让

估计参数的波动范围变小,变的更稳定。在存在病态数据(异常点)偏多的研

究中有较大的实用价值。

import pandas as pd

import numpy as np

#from sklearn.datasets import load_boston

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression,SGDRegressor,Ridge

from sklearn.preprocessing import StandardScaler

from sklearn.metrics import mean_squared_error

import joblib

import pandas as pd

from sklearn.ensemble import RandomForestClassifier

###读取数据

#boston=load_boston()

data_url = "http://lib.stat.cmu.edu/datasets/boston"

raw_df = pd.read_csv(data_url, sep="\s+", skiprows=22, header=None)

data = np.hstack([raw_df.values[::2, :], raw_df.values[1::2, :2]])

target = raw_df.values[1::2, 2]

###划分训练集测试集

x_train,x_test,y_train,y_test=train_test_split(data,target,test_size=0.25)

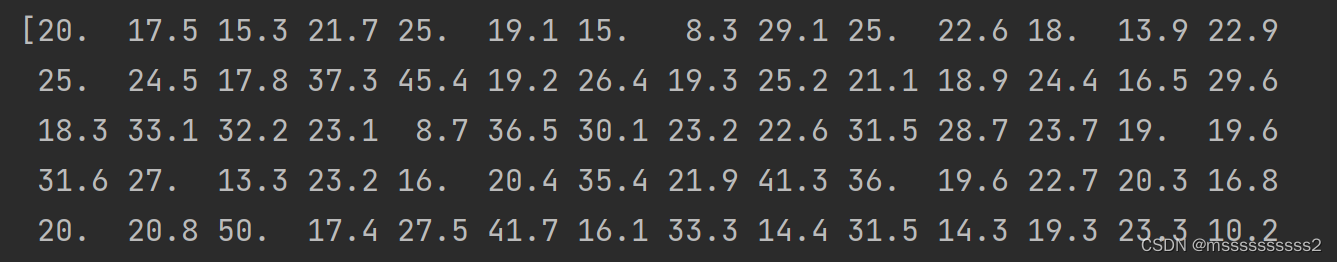

print(y_train, y_test)

###数据标准化

x_std=StandardScaler()

x_train=x_std.fit_transform(x_train)

x_test=x_std.transform(x_test)

y_std=StandardScaler()

y_train=y_std.fit_transform(y_train.reshape(-1,1))

y_test=y_std.transform(y_test.reshape(-1,1))

###构建并拟合模型

lr=LinearRegression()

lr.fit(x_train,y_train)

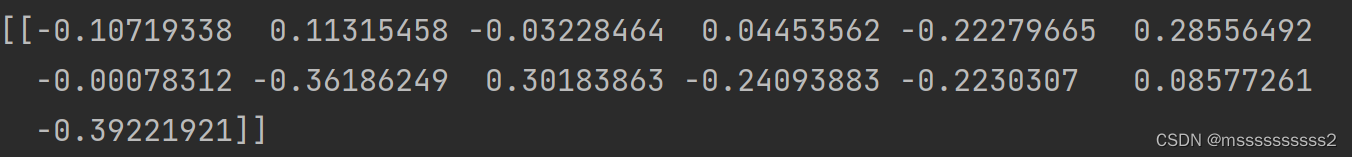

print(lr.coef_)###模型参数

y_predict_lr=y_std.inverse_transform(lr.predict(x_test))

mse_lr=mean_squared_error(y_std.inverse_transform(y_test),y_predict_lr)

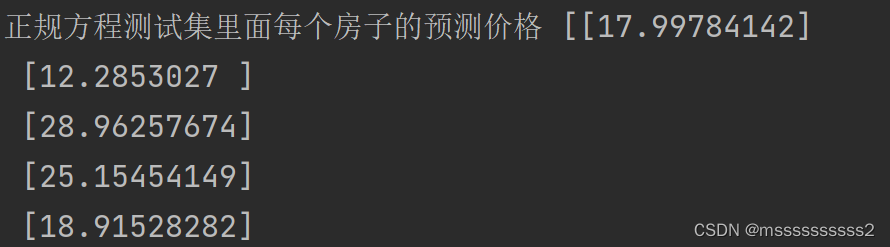

print('正规方程测试集里面每个房子的预测价格',y_predict_lr)

print('正规方程的均方误差:',mse_lr)

sgd=SGDRegressor()

sgd.fit(x_train,y_train.ravel())

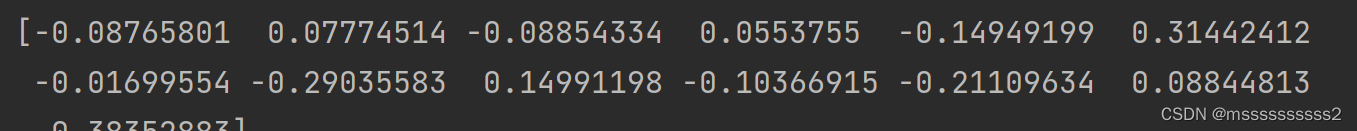

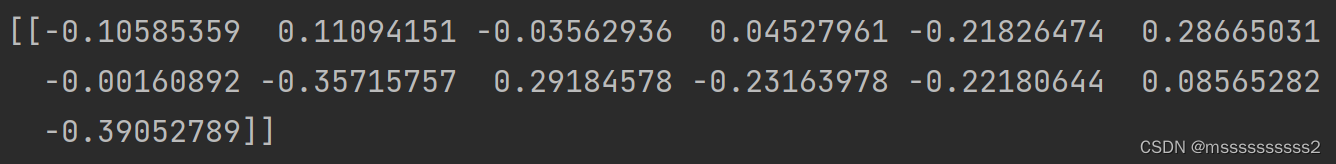

print(sgd.coef_)###模型参数

y_predict_sgd=sgd.predict(x_test)

mse_sgd=mean_squared_error(y_predict_sgd,y_std.inverse_transform(y_test))

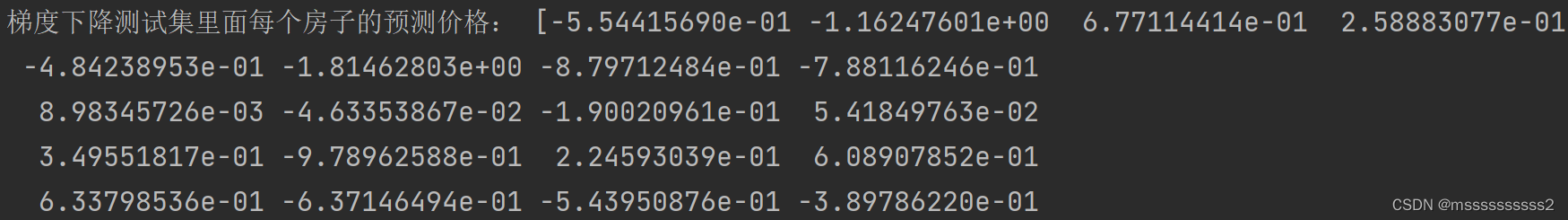

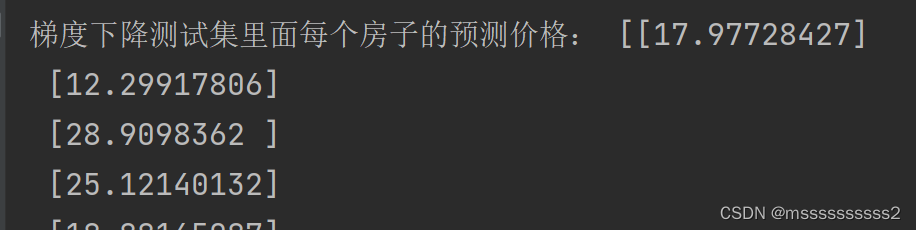

print("梯度下降测试集里面每个房子的预测价格:", y_predict_sgd)

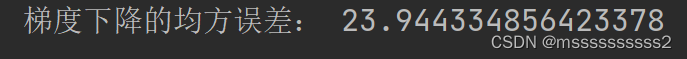

print("梯度下降的均方误差:", mse_sgd)

rd=Ridge(alpha=1.0)

rd.fit(x_train,y_train)

print(rd.coef_)

y_predict_rd=y_std.inverse_transform(rd.predict(x_test))

mse_rd=mean_squared_error(y_std.inverse_transform(y_test),y_predict_rd)

print("岭回归测试集里面每个房子的预测价格:", y_predict_rd)

print("岭回归的均方误差:", mse_rd)

###保存模型、导入模型

joblib.dump(lr,'lr.pkl')

model = joblib.load("./lr.pkl")

y_predict = std_y.inverse_transform(model.predict(x_test))

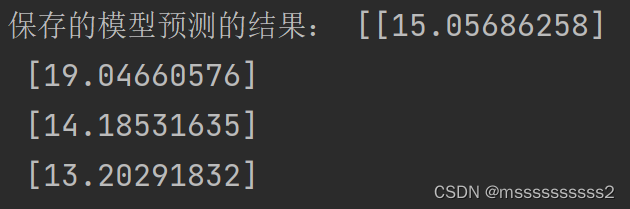

print("保存的模型预测的结果:", y_predict)

###读取数据

#boston=load_boston()

data_url = "http://lib.stat.cmu.edu/datasets/boston"

raw_df = pd.read_csv(data_url, sep="\s+", skiprows=22, header=None)

data = np.hstack([raw_df.values[::2, :], raw_df.values[1::2, :2]])

target = raw_df.values[1::2, 2]

###划分训练集测试集

x_train,x_test,y_train,y_test=train_test_split(data,target,test_size=0.25)

print(y_train, y_test)

###数据标准化

x_std=StandardScaler()

x_train=x_std.fit_transform(x_train)

x_test=x_std.transform(x_test)

y_std=StandardScaler()

y_train=y_std.fit_transform(y_train.reshape(-1,1))

y_test=y_std.transform(y_test.reshape(-1,1))

###构建并拟合模型

lr=LinearRegression()

lr.fit(x_train,y_train)

print(lr.coef_)###模型参数

y_predict_lr=y_std.inverse_transform(lr.predict(x_test))

mse_lr=mean_squared_error(y_std.inverse_transform(y_test),y_predict_lr)

print('正规方程测试集里面每个房子的预测价格',y_predict_lr)

print('正规方程的均方误差:',mse_lr)

sgd=SGDRegressor()

sgd.fit(x_train,y_train.ravel())

print(sgd.coef_)###模型参数

y_predict_sgd=sgd.predict(x_test)

mse_sgd=mean_squared_error(y_predict_sgd,y_std.inverse_transform(y_test))

print("梯度下降测试集里面每个房子的预测价格:", y_predict_sgd)

print("梯度下降的均方误差:", mse_sgd)

rd=Ridge(alpha=1.0)

rd.fit(x_train,y_train)

print(rd.coef_)

y_predict_rd=y_std.inverse_transform(rd.predict(x_test))

mse_rd=mean_squared_error(y_std.inverse_transform(y_test),y_predict_rd)

print("梯度下降测试集里面每个房子的预测价格:", y_predict_rd)

print("梯度下降的均方误差:", mse_rd)

###保存模型、导入模型

joblib.dump(lr,'lr.pkl')

model = joblib.load("./lr.pkl")

y_predict = std_y.inverse_transform(model.predict(x_test))

print("保存的模型预测的结果:", y_predict)

5838

5838

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?