-

结构区别:

- RNN (递归神经网络): 循环结构,前一状态的输出作为后一状态的输入,适合时间序列数据。

- LSTM (长短时记忆网络): RNN的变种,加入门控机制解决长期依赖问题。

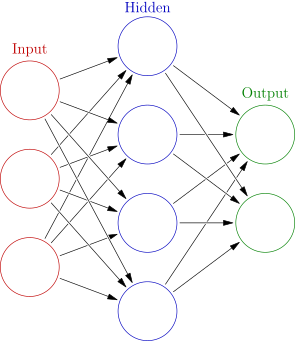

- 普通神经网络: 无循环,各层之间只有前向连接,不适合处理时间序列数据。

-

输入/输出/隐藏层区别:

- RNN: 单个或序列输入, 通过循环结构在隐藏层传递信息, 输出也可能是单个或序列。

- LSTM: 同RNN, 但隐藏层有门控结构维护信息流。

- 普通神经网络: 单个输入, 通过前向连接传递信息, 单或多输出。

- 结构图

-

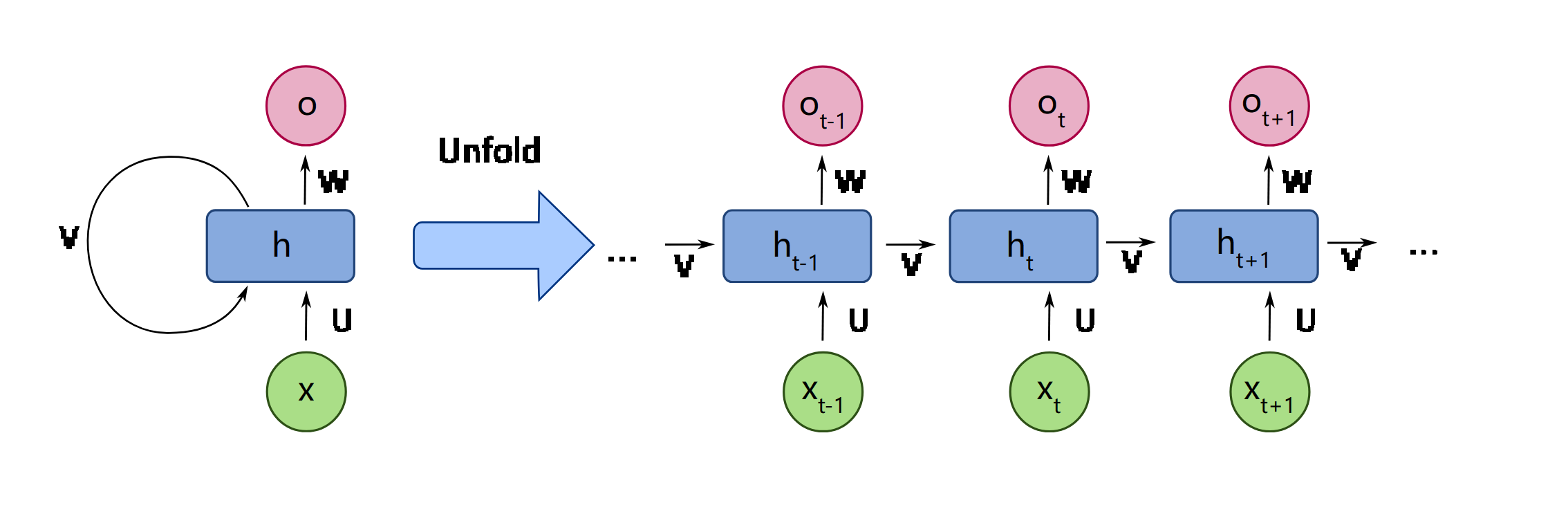

RNN

RNN中,后一状态的输出由输入x和前一状态隐藏层中的信息ht-1共同决定,但由于在传播很多层之后,前几层的隐藏层中信息h*就会被抹去,所以RNN不适合长时序。

-

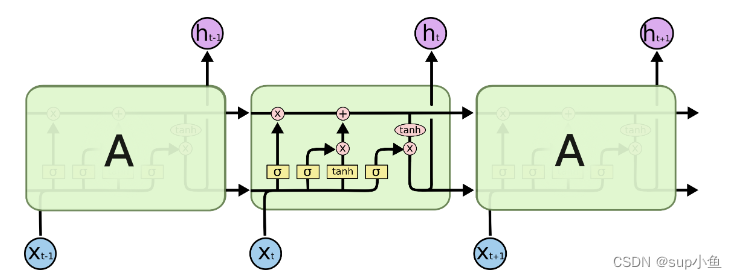

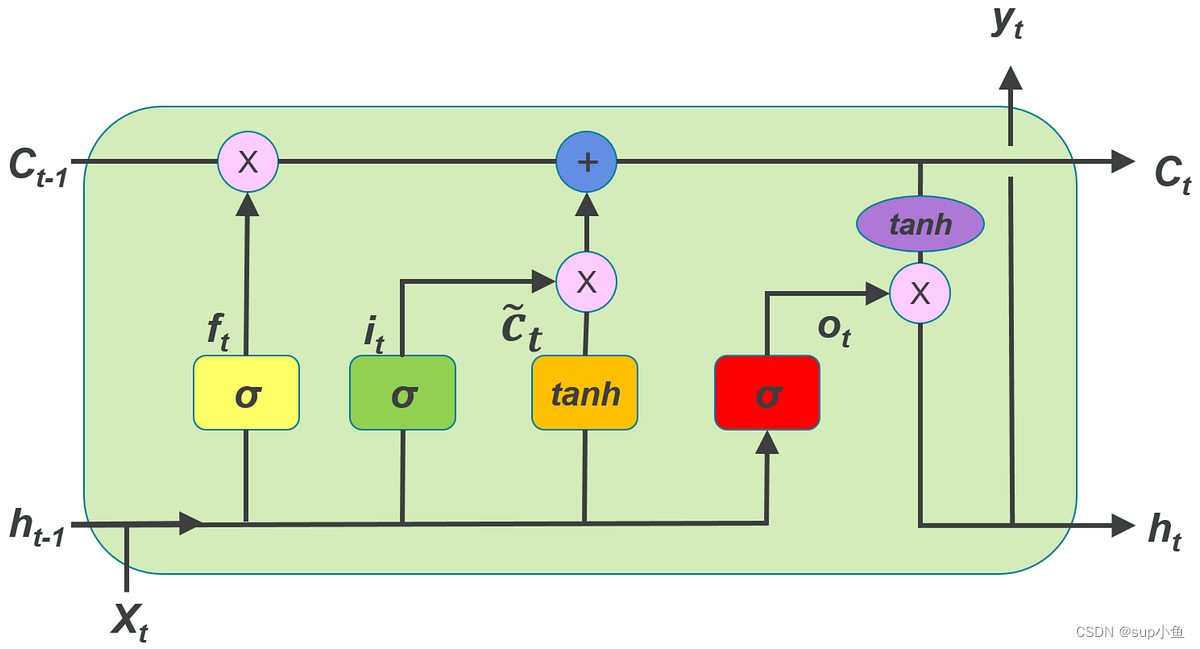

LSTM

LSTM与RNN的区别就是,后一状态的输出不仅由输入x和前一状态隐藏层中的信息ht-1决定,还由细胞状态Ct-1决定,即x、ht-1、Ct-1三者共同决定输出。最重要的是,LSTM通过设计门机制,实现有选择地保留或丢弃信息,将重要信息一直保存在模型中而不会消失,而RNN则缺乏这种主动保留丢弃能力。

-

普通神经网络

普通神经网络输出只有输入决定

本文对比了RNN(递归神经网络)的循环结构、LSTM(长短时记忆网络)的门控机制以及普通神经网络的前向连接在处理时间序列数据中的优缺点,强调了LSTM如何通过门控机制解决长期依赖问题。

本文对比了RNN(递归神经网络)的循环结构、LSTM(长短时记忆网络)的门控机制以及普通神经网络的前向连接在处理时间序列数据中的优缺点,强调了LSTM如何通过门控机制解决长期依赖问题。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?