相关文章:

1. 非线性支持向量机

对解线性分类问题,线性分类支持向量机是一种非常有效的方法。但是,有时分类问题是非线性的,这时可以使用非线性支持向量机(non-linear support vector machine)。

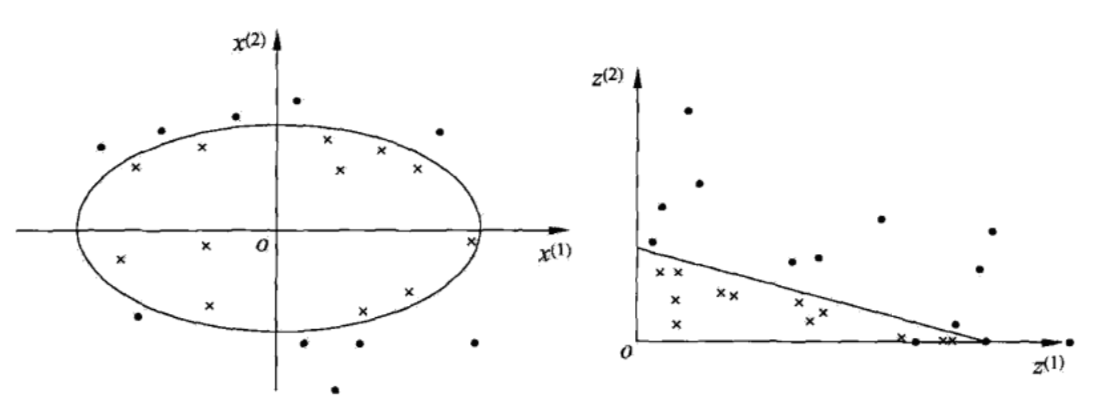

非线性分类问题是指通过利用非线性模型才能很好地进行分类的问题。如下图所示,这是一个分类问题,无法用直线(线性模型)将正负实例正确分开,但可以用一条椭圆(非线性模型)将它们正确分开。[1]

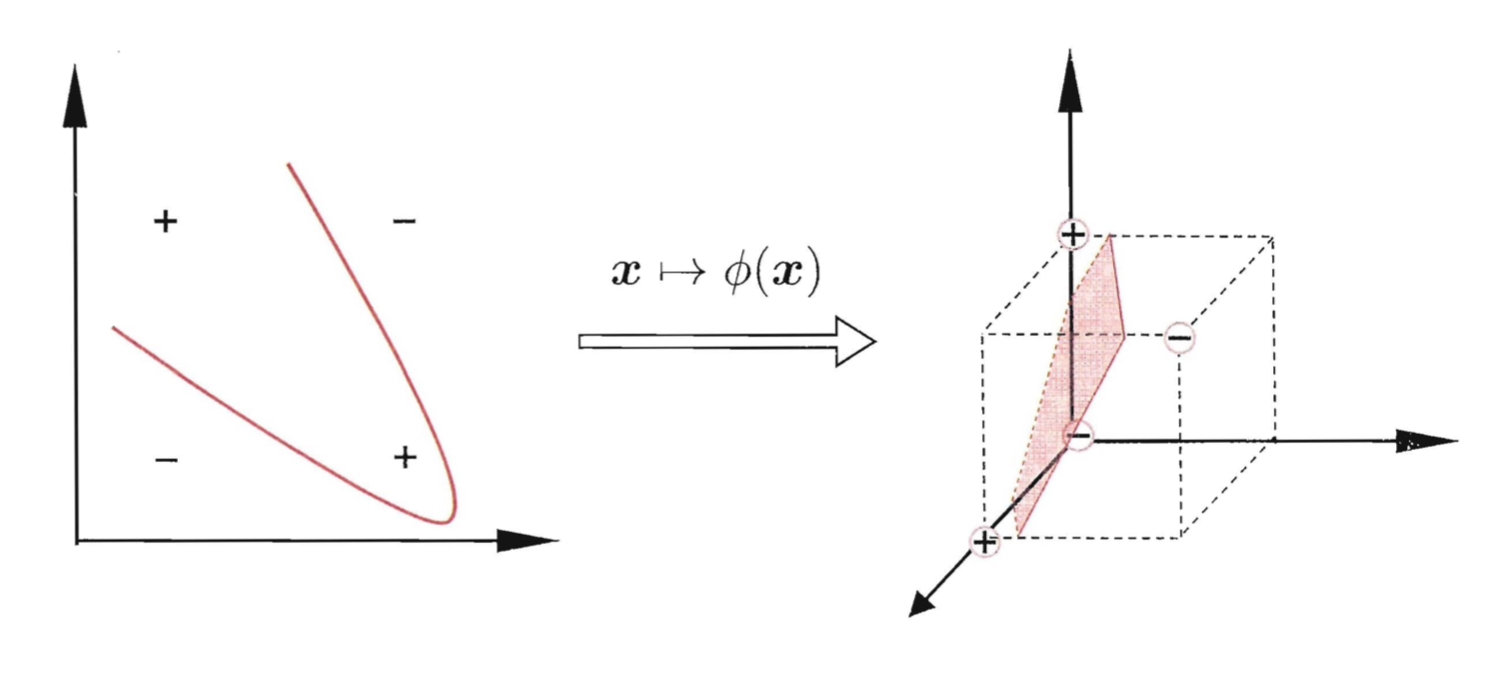

再看一个“异或”问题,同样也不是线性可分的:

对这样的问题,可将样本从原始空间映射到一个更高维的特征空间,使得样本在这个特征空间内线性可分。如图 2 所示,若将原始的二维空间映射到一个合适的三维空间,就可以找到一个合适的划分超平面。当原始空间是有限维(即属性数是有限的),那么一定存在一个高维特征空间使样本可分。

令 ϕ ( x ) \phi(x) ϕ(x) 表示将 x x x 映射后的特征向量,于是,在特征空间中划分超平面模型可表示为:

(1) f ( x ) = w T ϕ ( x ) + b f(x)=w^T\phi(x)+b \tag{1} f(x)=wTϕ(x)+b(1)

线性可分支持向量机的原始问题变为:

(2) min w , b 1 2 ∥ w ∥ 2 s.t. y i ( w T ϕ ( x i ) + b ) − 1 ⩾ 0 , i = 1 , 2 , ⋯   , N \begin{array}{ll}{\min \limits_{w, b}} & {\frac{1}{2}\|w\|^{2}} \tag{2}\\ {\text { s.t. }} & {y_{i}\left(w^T \phi(x_i)+b\right)-1 \geqslant 0, \quad i=1,2, \cdots, N}\end{array} w,bmin s.t. 21∥w∥2yi(wTϕ(xi)+b)−1⩾0,i=1,2,⋯,N(2)

其对偶问题为:

(3) max α ∑ i = 1 N α i − 1 2 ∑ i = 1 N ∑ j = 1 N α i α j y i y j ϕ ( x i ) T ϕ ( x j ) s.t. ∑ i = 1 N α i y i = 0 α i ⩾ 0 , i = 1 , 2 , ⋯   , N \begin{array}{ll}{\max \limits_{\alpha}} & { \sum_{i=1}^N\alpha_i-\frac{1}{2}\sum_{i=1}^N\sum_{j=1}^N\alpha_i\alpha_jy_iy_j\phi(x_i)^T\phi(x_j)} \tag{3}\\ {\text { s.t. }} & {\sum_{i=1}^N\alpha_iy_i=0}\\ & {\alpha_i\geqslant 0, \quad i=1,2,\cdots,N}\end{array} αmax s.t. ∑i=1Nαi−21∑i=1N∑j=1Nαiαjyiyjϕ(xi)Tϕ(xj)∑i=1Nαiyi=0α

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1963

1963

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?