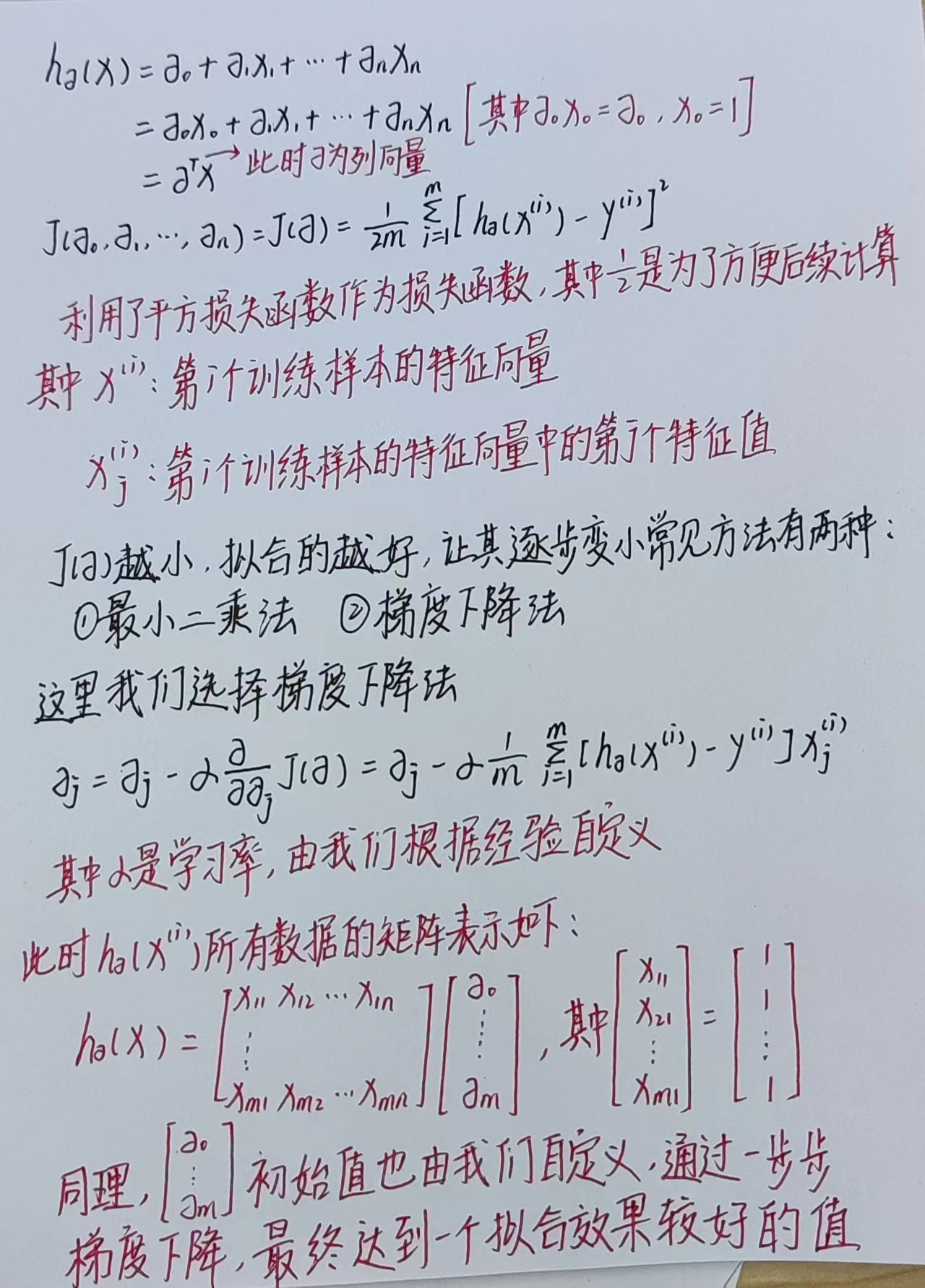

梯度下降法是线性回归模型中求

θ参数的一种方法,具体定义可在B站看吴恩达老师视频,此处聚焦于Python的实现,对于其中部分数据不太清楚的只需打印出来看看即可

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

# 梯度下降,X是包含所有特征值的矩阵,Y是包含所有结果的列向量,theta传入的是行向量

def gradientDescent(X, Y, theta, alpha, iters):

# 创建和θ一样规模的0矩阵【向量】

temp = np.matrix(np.zeros(theta.shape))

# θ是行向量,所以parameters代表θ个数

parameters = int(theta.shape[1])

# 初始代价值为0

cost = np.zeros(iters)

for i in range(iters):

# 预测误差值

# X是所有特征值组成的矩阵,θ转置是列向量,相乘后得到Y预测值

error = X * theta.T - Y

# 更新θ值,有几个θ就迭代几次

for j in range(parameters):

# X[:, j]表示第j列元素,即当前属性列所有取值

term = np.multiply(error, X[:, j])

# temp[0, j]是θj

temp[0, j] = temp[0, j] - alpha / len(X) * np.sum(term)

# 迭代后产生新的θ

theta = temp

# cost[i]代表第i次迭代后的代价值会是多少

cost[i] = computeCost(X, Y, theta)

return theta, cost

# 代价函数

def computeCost(X, Y, theta):

# X *θ转置,实质上就是预测函数h(θ)的向量表示,整个inner是平方损失函数的值【每行数据都会对应一个值】

inner = np.power((X * theta.T) - Y, 2)

# 将所有值累加求平均值就是代价函数【除 2 是为了后面方便运算】

return np.sum(inner) / (2 * len(X))

# 导入初始数据

attr = ["Size", "Bedrooms", "Price"]

nums = np.array([2104, 3, 399900, 1600, 3, 329900, 2400, 3,

36900, 1416, 2, 23200, 3000, 4, 539900], dtype=np.int32)

nums.resize([5, 3])

# 可以将data打印看看

data = pd.DataFrame(nums, columns=attr)

# 由于Size列值与范围[-1,1]相距较大,为了得到一个更好的拟合效果,我们可以对此列进行特征缩放

# 但是又由于python可以对整个矩阵进行操作,因此不妨对所有列都进行缩放

# 公式:(原数据-平均值)/标准差【或最大最小值之差】

data = (data - data.mean()) / data.std()

# hθ(x)用向量进行表示时需要将X第一列参数置1

# 在第0列的位置插入一整列1

data.insert(0, 'Ones', 1)

cols = data.shape[1]

# X是除去Price之外的列值组成的矩阵

X = data.iloc[:, :cols-1]

# Y是Price这一列组成的向量

Y = data.iloc[:, cols-1:cols]

# 将DataFrame数据转化为矩阵形式

X = np.matrix(X.values)

Y = np.matrix(Y.values)

# 初始化θ,是行向量

theta = np.matrix(np.array([0, 0, 0]))

parameters = int(theta.shape[1])

# 初始化α参数

alpha = 0.01

# 迭代次数

iters = 1000

# 将初始值传入进行梯度下降迭代,其中g为迭代后的θ

g, cost = gradientDescent(X, Y, theta, alpha, iters)

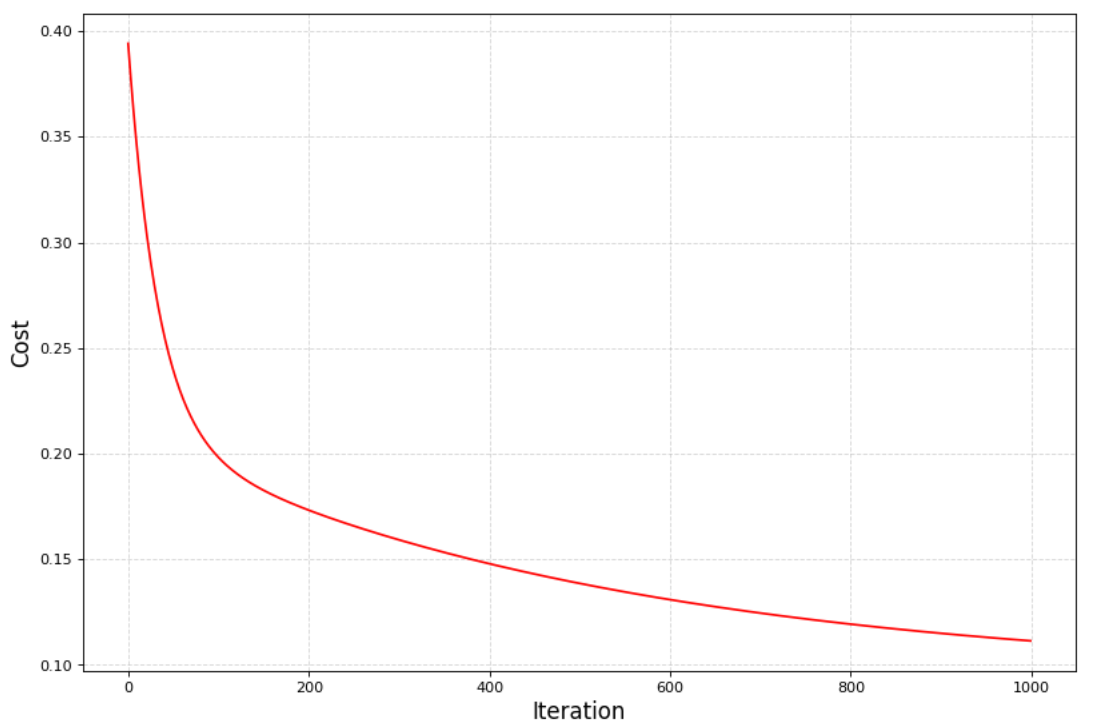

# 每次迭代后产生新θ时的代价值都记录在cost中

# 我们不妨将cost值画出来,以便更直观看到梯度下降过程

plt.figure(figsize=(12, 8), dpi=80)

plt.xlabel("Iteration", fontsize=15)

plt.ylabel("Cost", fontsize=15)

plt.grid(True, linestyle='--', alpha=0.5)

plt.plot(np.arange(iters), cost, 'r')

plt.show()

8770

8770

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?