目录

1.svm简述

2.最大间隔超平面

2.线性回归问题的图像描述

3.线性回归问题的数学描述

一.支持向量机(Support Vector Mechine)

支持向量机(support vector machines, SVM)是一种二分类模型,它的基本模型是定义在特征空间上的间隔最大的线性分类器,间隔最大使它有别于感知机;SVM还包括核技巧,这使它成为实质上的非线性分类器。SVM的的学习策略就是间隔最大化,可形式化为一个求解凸二次规划的问题,也等价于正则化的合页损失函数的最小化问题。SVM的的学习算法就是求解凸二次规划的最优化算法。

定义文字略显难懂,但我们需要了解,svm是针对小样本的算法

二.线性回归的图像描述

1.线性可分

首先我们需要了解什么是线性可分:

在二维空间上,两类点被一条直线完全分开叫做线性可分。

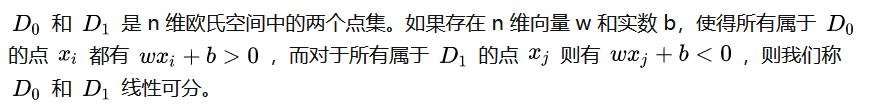

而其严格的数学定义是:

定义永远是枯燥的,因此我们用一张图就可以清晰地描述:

红点和蓝点被绿线整齐分在两侧,我们称这样的训练集为线性可分训练集(Linear Seperable),同时,若一条直线不能讲两种样本分开,则称这样的训练集为线性不可分(Non-linear Seperable)

红点和蓝点被绿线整齐分在两侧,我们称这样的训练集为线性可分训练集(Linear Seperable),同时,若一条直线不能讲两种样本分开,则称这样的训练集为线性不可分(Non-linear Seperable)

2.最大间隔超平面

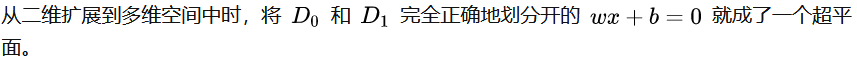

在svm的学习过程中,我们会多次运用超平面的知识,我个人在学习这里时也是第一次了解这个概念,因此我们在这里补充说明。

两类样本分别分割在该超平面的两侧;两侧距离超平面最近的样本点到超平面的距离被最大化了。

3.支持向量

支持向量用语言描述较为抽象,因此我们再次上图

在中间的直线进行平移时,最先相交的样本点成为支持向量(Support Vectors)

补充:我们在寻找最优解(此处为分类最佳的直线)时,如何判断其效果是否最优?在svm中,认为margin(两平移后直线间的距离)最大,即为效果最好。同时,原直线与平移后两直线的距离(d)均相同。

三.线性回归问题的数学描述

1.定义:

①训练数据及标签: (x1,y1) , (x2,y2) , (x3,y3)…(x i,y i)

这里每一个x代表一个向量,每一个y代表一个标签(取值为+1或-1)

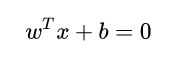

②线性模型: ( ω,b),这里的 ω代表一个向量,维度与上述x一致,b代表一个常数。

超平面(hyperplane):

③一个训练集线性可分是指:

{(x i, y i)} (i=1~N)

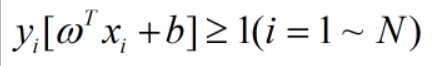

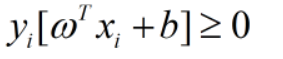

∃( ω,b), 使∀i∈1~N,有

i:若y i=+1,则 ωT x i+b>=0

ii:若y i=-1,则 ωT x i+b<=0

yi [ ωT x i+b]>=0 (这里暂记为公式一)

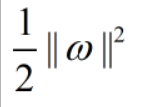

2.优化问题(凸优化——二次规划问题)

①最小化(Minimize),为了求导方便前面可加1/2

②限制条件(Subject to)

在这里我们首先需要认识两个事实:

事实一:ωT x i+b=0和aωT x i+ab=0是同一个平面(a属于正实数)

即若(ω,b)满足公式一,则(aω,ab)也满足。

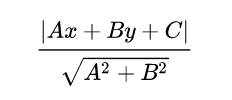

事实二:二维平面点(x,y)到直线Ax+By+C=0的距离公式是

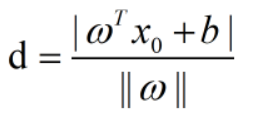

扩展到n维空间后,点x=(x1,x2,x3,x4,…,xn)到直线ωT +b=0的距离公式

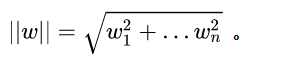

其中

**

接下来我们解释最小化与限制条件

**

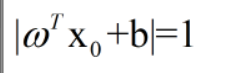

注意:此时我们可以利用a缩放(ω,b)得到(aω,ab),最终在支持向量x0上,有:

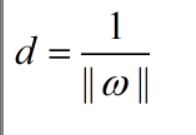

此时支持向量与平面的距离d,有

从这里我们就解释了,最小化||ω||,相当于最大化d,也就满足svm算法的要求。

对于非支持向量,其点到直线的距离大于支持向量到直线的距离d,因此限制条件成立,至于yi,其只能取正负一,用意在于平衡正负(直线两边正负)。

3.二次规划问题(Quadratic Programming)

①目标函数(Objective Functiuon)是二次项

②限制条件是一次项

此时:要么无解,要么只有一个极值(参考二次函数)

(本文部分公式图片来源于某乎@是泽哥啊 ,如需转载请联系作者)

2034

2034

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?