目录

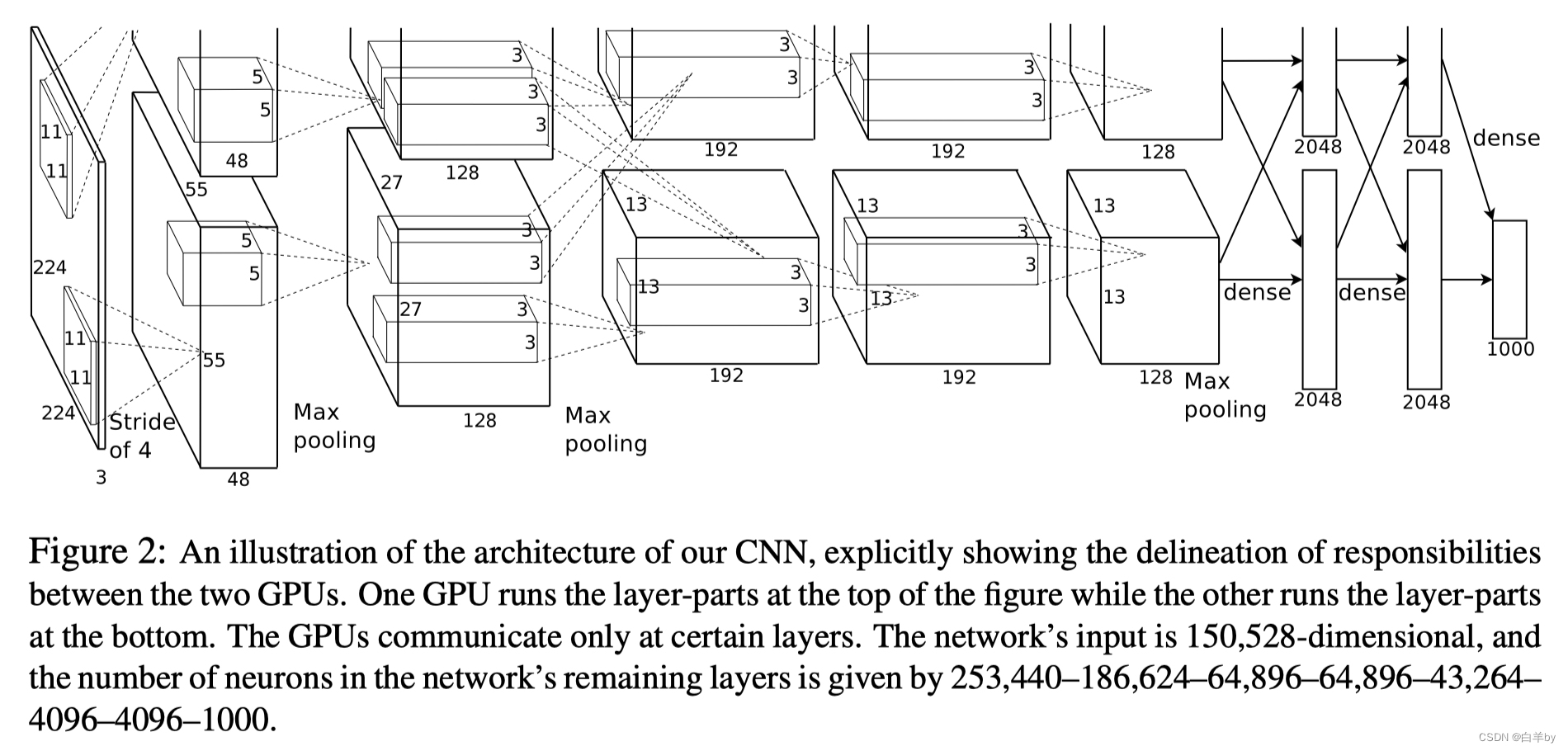

AlexNet网络

网络亮点:

1.首次利用GPU进行网络加速训练。

2.使用ReLU激活函数,而不是传统的Sigmoid激活函以及Tanh激活函数。

3.使用LRN局部相应归一化,

4.在全连接层的前两层中使用了Dropout随机丢弃神经元操作,以减少过拟合。

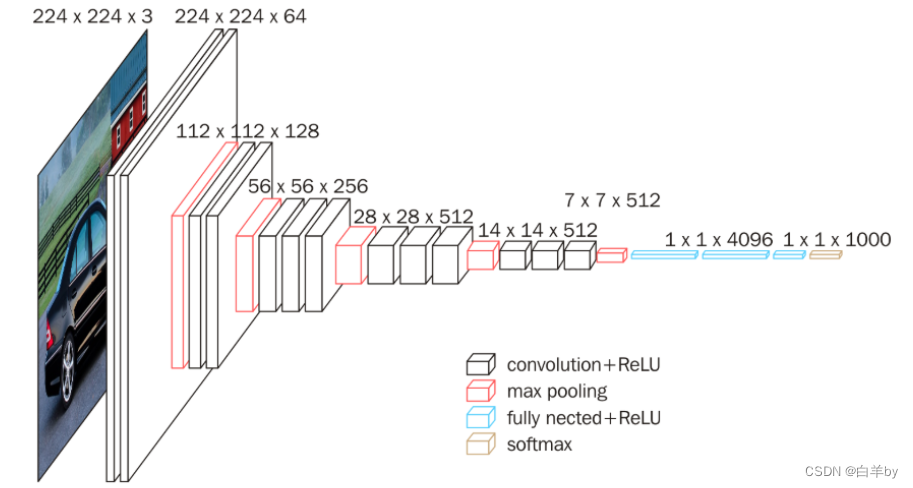

VGG网络

网络亮点:

通过堆叠多个3×3的卷积核来代替大尺度卷积核(减少所需参数)。

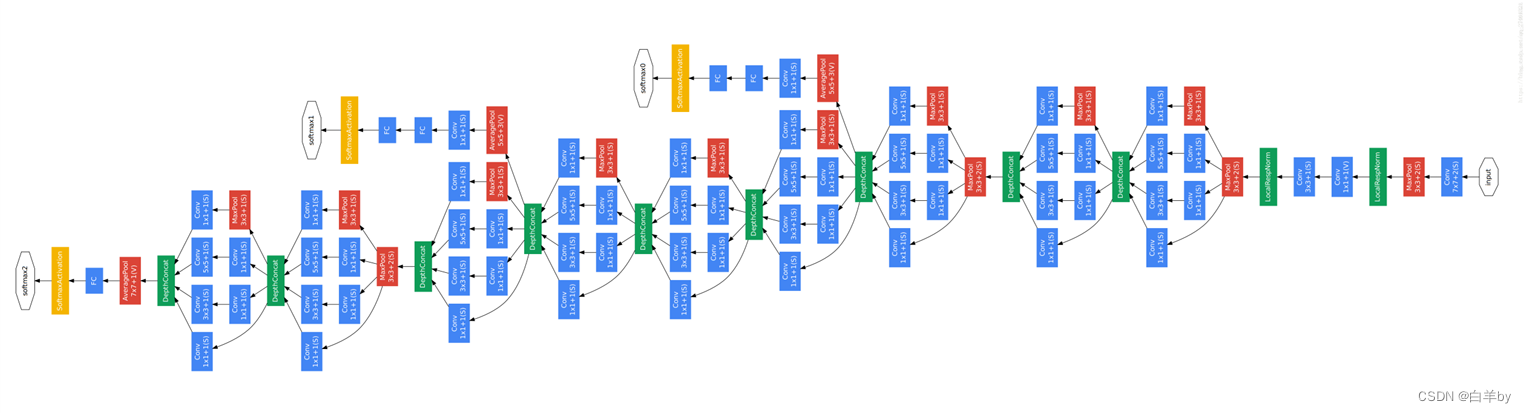

GoogLeNet网络

网络亮点:

1.引入Inception结构(融合不同的特征信息)

2.使用1×1的卷积核进行降维以及映射处理

3.添加两个辅助分类器帮助训练

丢弃全连接层,使用平均池化层(大大减少模型参数)

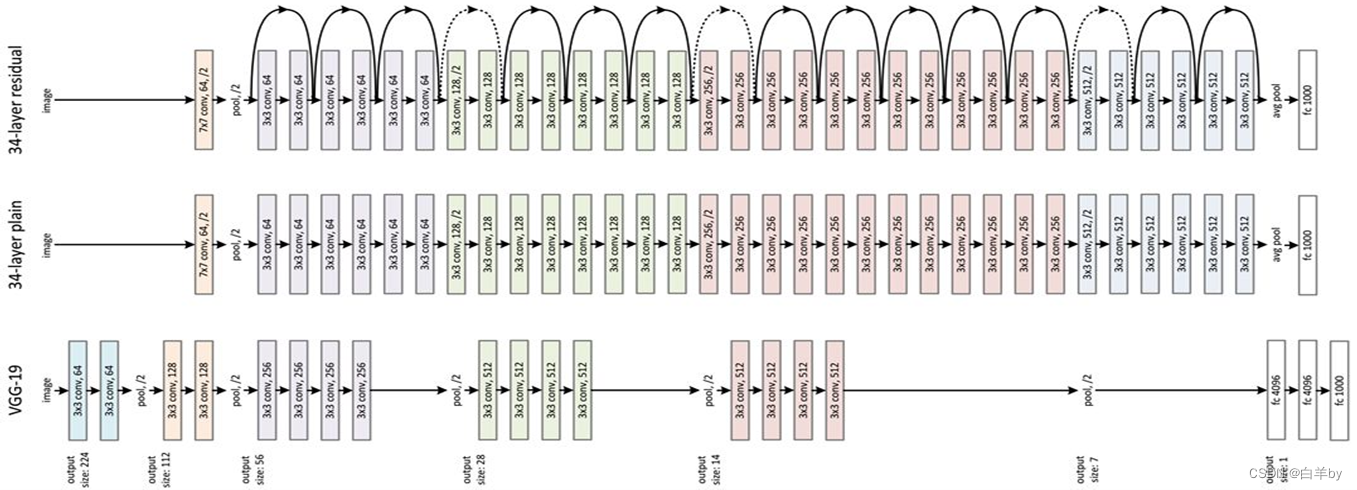

ReaNet网络

网络亮点:

1.超深的网络结构(突破1000层)

2.提出residual残差模块

3.使用Batch Normalization 加速训练(丢弃dropout)

MobileNet 网络

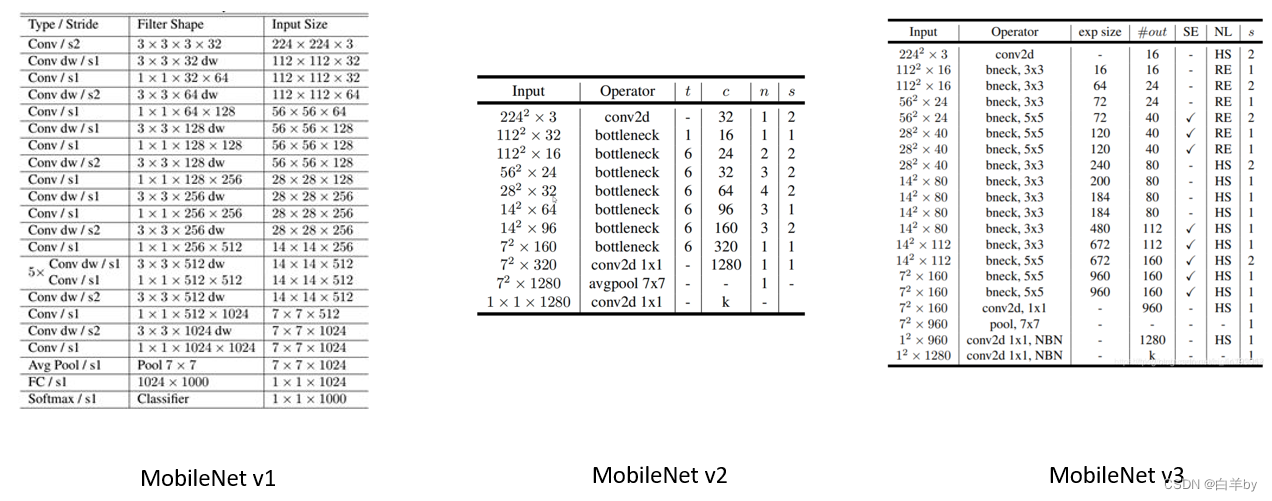

MobileNet v1网络

网络亮点:

1.Depthwise Convolution(大大减少网络运算量的参数数量)

2.增加控制卷积核的超参数,控制图像输入大小的

MobileNet v2网络

网络亮点:

1..Inverted Residuals(倒残差结构:先使用1×1的卷积升维,再使用1×1卷积降维)

2.Linear Bottlenecks

MobileNet v3网络

网络亮点:

1.更新了Block(加入了SE注意力机制模块,更新了激活函数)

2.重新设计耗时层结构(减少第一个卷积层的卷积个数、精简Last Stage)

3.重新设计激活函数(h-swish激活函数)

ShuffleNet网络

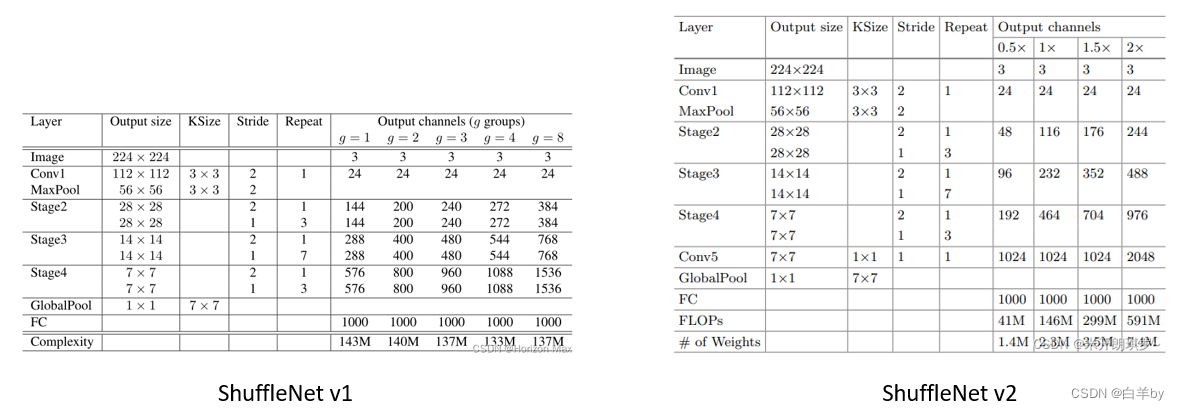

ShuffleNet v1网络

网络亮点:

1..使用GConv代替1×1的卷积,使用DWConv代替3×3的卷积

2.提出 Channel shuffle概念

ShuffleNet v2网络

网络亮点:

1.两条支路使用Concat进行连接,保持输入虹软输出通道的一致。

2.只对右边的支路进行ReLU操作。

3.将Concat、Channel Shuffle、Channel Split合并。

5.对于下采样操作,消除Channel Split操作。

EfficientNet 网络

EfficientNet v1网络

网络亮点:

1.使用用NAS(Neural Architecture Search)技术来搜索网络的图像输入分辨率r,网络的深度depth以及channel的宽度width三个参数的合理化配置。

2.同时增加网络的width、网络的深度以及输入网络的分辨率来提升网络的性能。

EfficientNet v2网络

网络亮点:

1.引入Fused-MBconv模块

2.引入渐进学习策略(训练更快)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?