数据预处理考试大纲

第一章-预处理概述(重点考选择题)

数据清理

1. 目的★

- 达到改进数据的质量,提高数据挖掘过程的准确率和效率

- 保证数据挖掘的正确性和有效性

- 通过对数据格式和内容的调整,使得数据更符合挖掘的需要

2. 流程★

初始数据获取——数据清理——数据集成——数据变换——数据规约

3. 数据清理-缺失值处理方法★

- 忽略元组

- 人工填写

- 使用全局常量替换空缺值

- 属性的中心度量来填充

- 使用同类样本属性的中心度量

- 使用于给定元组同一类的所有样本平均值

- 使用最可能的值——回归、贝叶斯、决策树

4. 噪声数据平滑方法★

1-分箱法(要会算)★

通过考察数据的近邻来光滑有序数据值。

2-回归

它采用一个函数拟合数据来光滑数据。

- 线性回归:找出拟合两个属性的“最佳”直线,帮助平滑数据及除去噪声。

- 多元线性回归:设计多个属性,拟合到一个多维的面。

3-聚类

可以通过聚类算法来检测离群点,消除噪声。

聚类算法:K均值方法、层次聚类方法、基于密度聚类方法……

数据集成

集成方法

- 将各数据源的数据视图集成为全局模式。

- 中间件集成:通过统一的全局数据模型来访问异构的数据源。

- 数据复制:将各个数据源的数据复制到同一处,即数据仓库。

数据归约

数据变换

1. 目的

将数据转换或统一成易于进行数据挖掘的数据存储形式,使得挖掘过程可能更有效。

2. 方法

- 光滑:去掉数据中的噪音;

- 属性构造:由给定的属性构造新的属性并添加到属性集中,帮助数据分析和挖掘;

- 聚集:对数据进行汇总或聚集;

- 规范化:将属性数据按比例缩放,使之落入一个小的特定区间;

- 离散化:数值属性区间标签或概念标签替换

- 由标称数据产生概念分层:属性,如street,可以泛化到较高的概念层,如city或country。

3. 数据规范化(要会算)★

最小-最大规范化★

零-均值规范化★

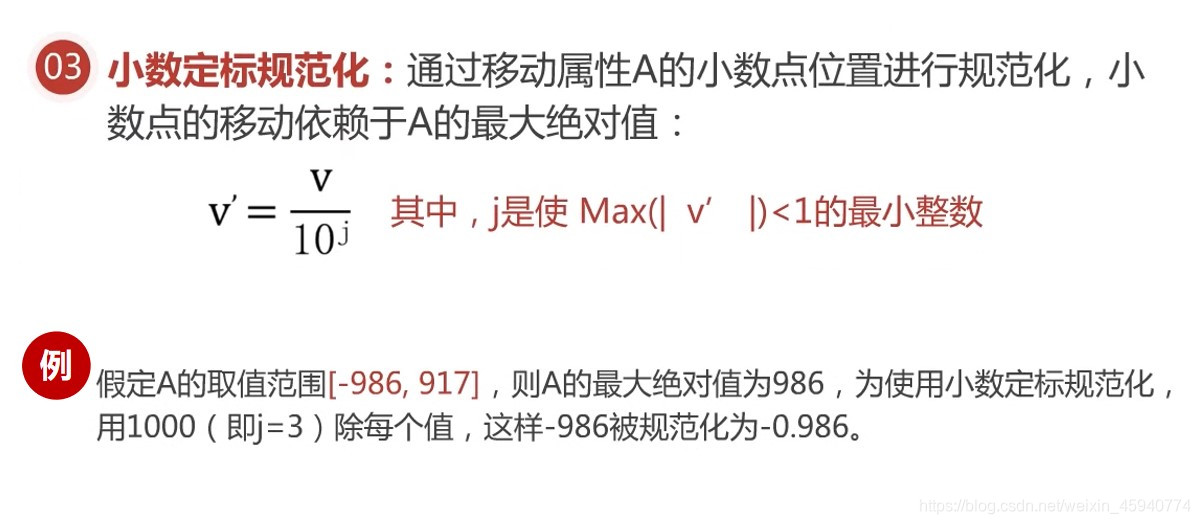

小数定标规范化

数据预处理的工具

Kettle、python

小结

第三章-数据的导入与导出

基于Web的数据导入与导出

基于CDC变更数据的导入与导出★

常用的4种CDC方法是:基于源数据的CDC、基于触发器的CDC、基于快照的CDC和基于日志的CDC,其中前三种是侵入式的。

处理的文件类型

TXT、CSV、XML、JSON等类型的文件

第四章-数据清理

Kettle如何做不完全重复数据的清理-处理思路★

- 首先,根据Name字段进行模糊查找,找出疑似重复数据的记录;

- 然后,根据参考字段E-Mail进一步检测数据的重复性;

- 最后,去除或者合并这些疑似重复的记录。

步骤:输入、模糊匹配、找出疑似重复记录、去重、输出

第五章-Kettle作业设计

跳

作业的跳是作业项之间的连接线,它定义了作业的执行路径。作业里的每个作业项的不同运行结果决定了作业的不同执行路径。对作业项的运行结果的判断:

(1)无条件的:不论上一个作业项执行成功还是失败,下一个作业项都会执行。

(2)当结果为真的时候继续下一步。

(3)当结果为假的时候继续下一步。

跳还有两种状态——Enabled和Disabled,即可用与不可用状态。

第六章-基于Kettle构建数据仓库

1. 星型模型特点

星形模型顾名思义,事实表和维度表形成星形的样式,即以事实表为中心,外围是若干张维度表;维度表通过主键和事实表的外键关联,在该模型中,每个维度表之间没有依赖关系,加载不分先后顺序。

2. 雪花模型特点

雪花模型是在星形模型的基础之上拓展而来的,每一个维度可以再扩散出更多的维度,根据维度的层级拆分成颗粒度不同的多张表。

3. 数据仓库和数据库的区别

数据库:主要处理基本的、日常的、实时性要求非常高的事务处理,例如在线购物。

数据仓库:主要解决复杂的分析操作,侧重决策支持,并且提供直观易懂的查询结果。

第七章-Pandas

四种处理的数据类型

- 表格型的数据,且表格的各列可能具有不同的数据类型,例如关系型数据库表格,或者Excel表格数据;

- 有序或无序的时间序列数据;

- 带有行和列标签的矩阵数据;

- 各种统计/观测数据集 。

第八章-基于python的数据整理

两种数据集合合并方法的联系&区别

联系:都是用于合并多个数据集。

区别

1. pandas.merge

基于一个或多个键连接多个DataFrame中的行。

2. pandas.concat

按行或按列将不同的对象加到一起。

作业案例题

3305

3305

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?