cuda在线安装命令,直接复制粘贴

# 安装 CUDA 工具包 11.4 版本。'-y' 参数是同意所有提示,无需手动确认。

sudo apt install cuda-toolkit-11-4 -y

# 安装针对 CUDA 的 NVIDIA 深度神经网络库开发包(cuDNN)。'-y' 参数同意安装过程中的所有提示

sudo apt install libcudnn8-dev -y

# 安装 NVIDIA TensorRT,这是一个用于深度学习推理的优化库。'-y' 参数用于自动确认安装。(这个根据需求安装,不需要就不用安装)

sudo apt install tensorrt -y

添加环境变量(下面三行必须添加)

# 为 CUDA 设置环境变量,指定 CUDA 的安装目录。

export CUDA_HOME=/usr/local/cuda-11.4

# 将 CUDA 库的路径添加到系统的库文件搜索路径中,这样程序可以找到 CUDA 库。

export LD_LIBRARY_PATH=/usr/local/cuda-11.4/lib64:$LD_LIBRARY_PATH

# 将 CUDA 的可执行文件路径添加到系统的 PATH 环境变量中,使得用户可以在任何位置调用 CUDA 程序和工具。

export PATH=/usr/local/cuda-11.4/bin:$PATH

然后安装pytorch

我这边选的离线安装,这是下载网址(进入选合适的版本)

PyTorch for Jetson - Jetson & Embedded Systems / Announcements - NVIDIA Developer Forums

然后scp直接拉到一个路径下直接命令,比较快()

pip install --no-index --find-links=你的路径 torch-1.12.0a0+2c916ef.nv22.3-cp38-cp38-linux_aarch64.whl

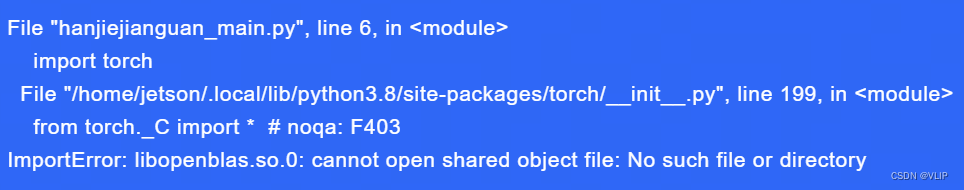

然后可能会报错,没报错就不用看下边了,如果是这个报错,一般都是无法找到 libopenblas.so.0 这个共享对象文件,直接命令下载

sudo apt-get update

sudo apt-get install libopenblas-base

完事就可以了,如果还不行直接把路径添加到环境变量里边,下边命令,把路径改了就行

export LD_LIBRARY_PATH=/usr/local/lib:$LD_LIBRARY_PATH

650

650

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?