SVM最早是由Vladimir N. Vapnik和Alexey Ya. Chervonenkis在1963年提出,目前的版本(soft margin)是由Corinna Cortes和Vapnik在1993年提出,并在1995年发表。深度学习出现之前,SVM被认为是机器学习中近十几年来最成功,表现最好的算法。

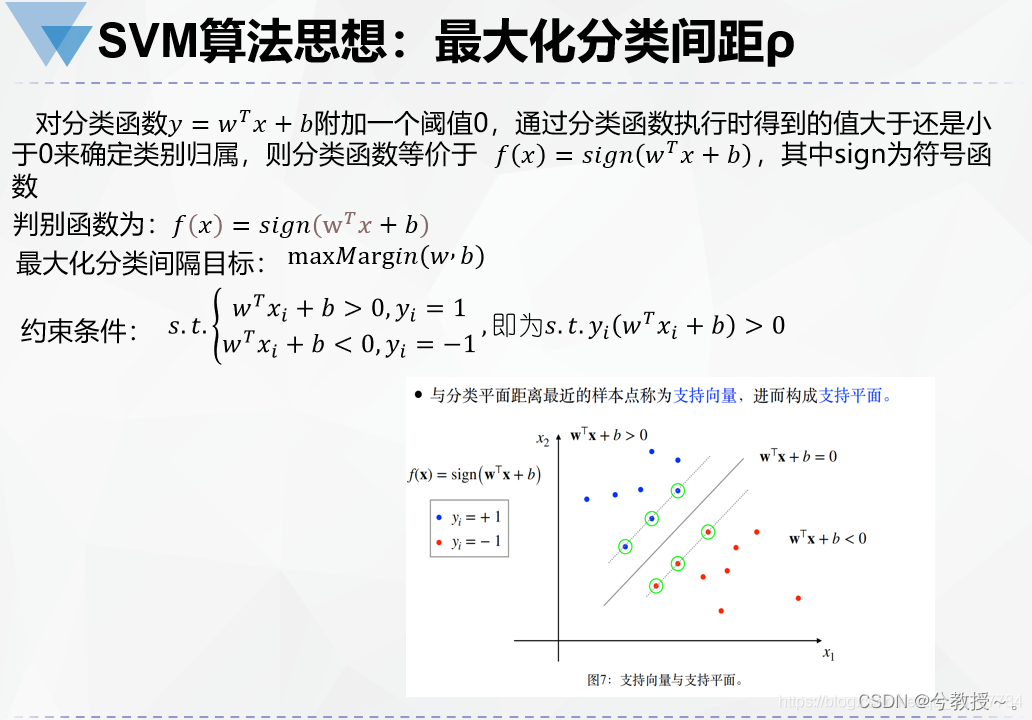

支持向量机是一种二分类模型,它将实例的特征向量映射为空间中的一些点,SVM的目的就是想要画出一条线,以“最好地”区分这两类点,以至如果以后有了新的点,这条线也能做出很好的分类。

1、能够画出多少条线对样本点进行区分?

答:线是有无数条可以画的,区别就在于效果好不好,每条线都可以叫做一个划分超平面。比如下面的绿线就不好,蓝线还凑合,红线看起来就比较好。我们所希望找到的这条效果最好的线就是具有‘最大间隔的划分超平面” 。

2、为什么要叫作“ 超平面”呢?

答:因为样本的特征很可能是高维的,此时样本空间的划分就不是一条线了 。

3、画线的标准是什么? /什么才叫这条线的效果好? /哪里好?

答: SVM将会寻找可以区分两个类别并且能使间隔(margin) 最大的划分超平面。比较好的划分超平面,样本局部扰动时对它的影响最小、产生的分类结果最棒、对未见示例的泛化能力最强。

4、间隔(margin) 是什么?

答:对于任意一个超平面,其两侧数据点都距离它有一个最小距离(垂直距离),这两个 最小距离的和就是间隔。

比如下图中两条虚线构成的带状区域就是margin,虚线是由距离中央实线最近的两个点所确定出来的(也就是由支持向量决定)。但此时margin比较小,如果用第二种方式画,margin 明显变大也更接近我们的目标。

5、为什么要让间隔(margin)尽量大 ?

答:因为大间隔(margin)犯错的几率比较小。

6、支持向量是什么 ?

答:从上图可以看出,虚线上的点到划分超平面的距离都是一样的,实际上只有这几个点共同确定了超平面的位置,因此被称作“支持向量(support vectors)”。

7、SVM分类 ?

答: Hard-Margin SVM

Soft-Margin SVM

Kernel SVM

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?