重新设置节点

moosefs.com

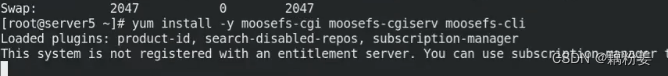

serevr2做master连接外网

server3,4以此类推

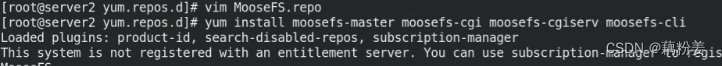

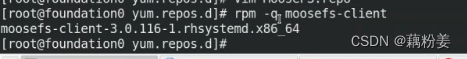

cd /etc/repos.d/

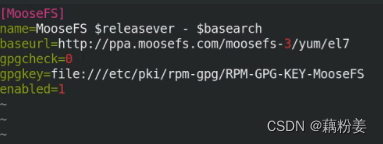

vim MooseFS.repo

这个装完之后,不用做什么配置

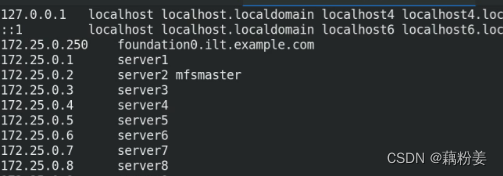

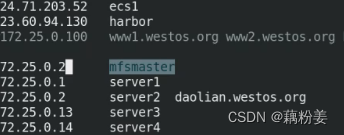

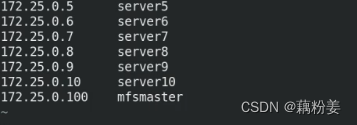

每个节点都要 做个解析

vim /etc/hosts

systemctl enable --now moosefs-master

ps ax

netstat -antlp

systemctl enable --now moosefs-cgiserv.service

netstat -antlp

加节点

server3

mkdir /mnt/chunk1

id mfs

chown mfs.mfs /mnt/chunk1/

cd ./etc/mfs/

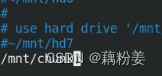

vim mfshdd.cfg #用来输出数据节点的

ll -d /mnt/chunk1/

df -h /

systemctl enable --now moosefs-chunkserver #如果没有成功,有可能是解析没有做

systemctl status --now moosefs-chunkserver

server4

mkdir /mnt/chunk2

id mfs

chown mfs.mfs /mnt/chunk2/

cd ./etc/mfs/

vim mfshdd.cfg #用来输出数据节点的

systemctl enable --now moosefs-chunkserver

宿主机做客户端

做解析

cd /etc/mfs/ #这个必须是空目录

ls

cd

mfsmount #会自动读取,连接的是9421

现在写数据,是将数据写入分布式系统中

mkdir dir1

mkdir dir2

ll

cp /etc/passwd dir1/

cd /etc/fstab dir2/

ls

mfssetgoal -r 1 dir1/ 设置副本数

mfsgetgoal dir1/

mfsgetgoal dir2/

cd dir1/

mfsfileinfo passwd #查看信息

lsof -i :9421

moosefs-metalogger日志服务器,是用来做冷备的,周期化的,会自动备份matster端的这个日志变更,当master出现故障时,可以激活,接管matser

pacemaker

9421连接客户端

9420数据

9419连接数据日志服务器

master的内存越大,能存的数量越多,跟文件大小无关

这个只是存数据,不是处理数据

分布式网路一定要快

功能:

对于网盘,数据删除之后有一个保留时长。

客户端

cd /mnt/mfs/

cd dir1/

ls

mfsgettrashtime passwd

数据比较庞大,变更比较快,服务端容量不是特别多,可以把回收时间调短一点,一般允许有一个七天的时间。

rm -f passwd #如果删除这个文件,怎么恢复,这是在后端操作,在前端只需要撤销

cd /mnt/

cd mfsmeta/

mfsmount -m /mnt/mfsmeta/ #挂载元数据到这个文件

mount #查看元数据目录,

cd

cd /mnt/mfsmeta/

cd trash/ #这是一个回收站

find -name *passwd* #查看被删除的文件

cd 004/

mv 00000004\|dir1\|passwd undel/ #前端只需要调用api接口就可以了

cd dir1\

ls #这时候被删除的文件就恢复了

数据放在两个机器上,这两台机器在一间房中,那如果要将两台机器放在两个room中呢?万一一个机房突然断电毛领一个机房还可以用

server4

cd /etc/yum.repos.d/

scp MooseFS.repo server5:/etc/yum.repos.d/

server5

yum install -y moosefs-chunkserver

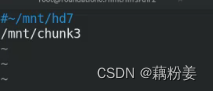

mkdir /mnt/chunk3

chown mfs.mfs /mnt/chunk3/

hosts文件加解析

systemctl enable --now moosefs-chunkserver

servere3

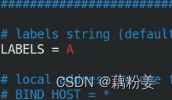

vim mfschunkserver.cfg

systemctl reload moosefs-chunkserver.service

三个节点分别有A,B,C标记,使得三台极其分别处于不同的机房

宿主机

cd /mnt/mfs/

cd dir2/

mfsfileinfo fstab#现在改机房

mfsfileinfo A,C class_ac

mfssetsclass -r class_ac fstab

mfsfileinfo fstab #如果发现没有改动,可能是节点有问题

server5

cd /etc/mfs/

vim mfschunkserver.cfg#之前没有告诉存储在什么地方

vim mfshdd.cfg

systemctl reload moosefs-chunkserver.service

cd /mnt/chunk3/

ls

宿主机

mfsfileinfo fstab

mfsxchgsclass -r class_ac class_ab fstab

mfsgetclass fstab

mfsfileinfo fstab

在布置的时候,没有布置元数据服务器,这个是做冷备的,我们要做热备。

systemctl stop moosefs-chunkserver.service

systemctl disable moosefs-chunkserver.service

yum install -y moosefs-master

server3或4都可以,给一个10G的磁盘

fdick -l

yum install -y targetcli

systemctl start target

systemctl enable target

targetcli

ls

cd /backstores/block

ls

create my_disk /dev/vdb

ls

cd /iscsi

ls

server2和5上

yum install -y iscsi-*

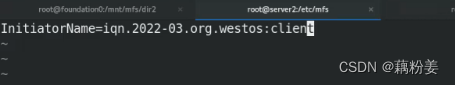

cat /etc/iscsi/initiatorname.iscsi #这是一个认证,复制iqn

server3或4都可以

create iqn.2022-03.org.westos:target1/

cd tpg1/

ls

cd acls

ls

create iqn.2022-03.org.westos:client

ls

cd luns

create /backstores/block/my_disk

ls

exit

server2和5

vim /etc/iscsi/initiatorname.iscsi

iscsiadm -m discovery -t st -p 172.25.0.3

iscsiadm -m node -l

fdisk -l #就会出现磁盘

mkfs.xfs /dev/sda #格式化,5上面不用格式化

ls

cd /mnt/

ls

df

cd

umount /mnt/ #是一个设备,不要同时挂

server2

cd /var/lib/

ls

cd mfs/

systemctl stop moosefs-master.service

ls #正常关闭metadata.mfs后面没有back,如果有,则影响下次打开

umount /var/lib/mfs/

当master停了之后,不要启动客户端,会卡住的,以为一直会保持连接

server5

mount /dev/sda /var/lib/mfs/

cd /var/lib/mfs/

ls

ll

systemctl start moosefs-master

systemctl stop moosefs-master

systemctl disable moosefs-master 3,4也有关闭,2在宿主机卸载umount之后,再关闭

umount /var/lib/mfs/

宿主机

evince

server2和5

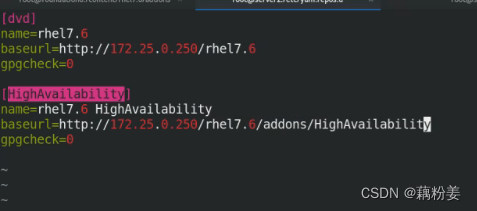

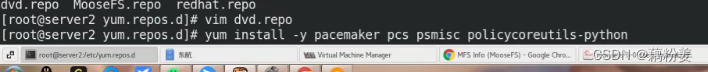

cd /etc/yum.repos.d/

vim dvd.repo

systemctl enable --now pcsd.service

echo westos | passwd --stdin hacluster

pcs cluster auth server2 server5 认证,密码是上面设置的那个

pcs cluster setup --name mycluster server2 server5

pcs cluster start --all

pcs cluster enabe --all

crm_verify -LV

pcs property set stonith-enabled=false

crm_verify -LV

pcs status

pcs resource create vip ocf:heartbeat:IPaddr2 ip=172.25.0.100 #这个100一定是没人用,有了vip之后就要起服务,但是起服务之前,要把存储挂上去。

pcs status

ip addr

df

pcs resource describe ocf:heartbeat:Filesystem

pcs resource create mfsdata ocf:heartbeat:Filesystem device=/dev/sda directory=/var/lib/mfs fstype=xfs op monitor interval=60s

pcs status

pcs resource create mfsmaster systemd:moosefs-master op monitor interval=60s

pcs resource group add mfsgroup vip mfsdata mfsmaster #后面三个是资源启动顺序,先起vip,再挂存储,再起服务。

pcs status

在所有节点以及客户端,修改hosts

systemctl start moosefs-chunkserver

访问100

客户端

修改完解析之后

mfsmount

cd /mnt/mfs

ls

cd dir2/

mfsfileinfo fstab

server2

pcs node standby 当2挂了之后,vip会转到其他的节点上

systemctl enable --now moosefs-cgiserv.service

server2

pcs node unstandby

1255

1255

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?