1. 概述

airflow是用来做定时任务的工具,对于我们开发者需要了解的只有两个对象:dag和task。dag是定时任务管理器,task是你要执行什么内容。

2. dag

实例化一个dag,这里就是告诉airflow任务什么时候执行,还有一些冗余信息,非常好理解。

3. task

3.1. 定时任务

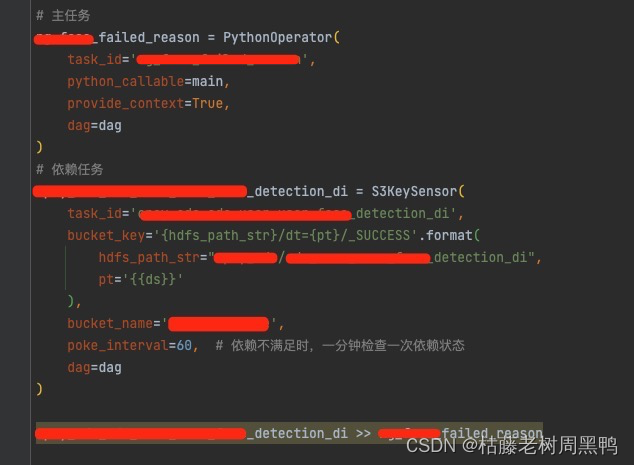

把需要执行的内容写进一个函数,比如图中的main。通过airflow.operators.python_operator.PythonOperator就可以包装一个任务,dag对象就会自动的按照时间执行该任务,即只要实例化这样一个任务对象就完事了。

传入参数方面,当provide_context=True时airflow会自动传入ds(日期)等参数。额外参数的注入可以使用op_args, op_kwargs,当然也可以使用partial方法把你需要的参数给固定了再传递给airflow

详见:https://airflow.apache.org/docs/apache-airflow/stable/templates-ref.html

3.2. 依赖任务

有的情况下,我们需要上游任务完成我们再执行任务。通常我们会约定在对应的hdfs路径下写一个_SUCCESS文件,如果找到了就认为完成。依赖任务可以通过airflow.providers.amazon.aws.sensors.s3.S3KeySensor实现,示例如下:

最后一行task_a >> task_b表明顺序关系,先执行task_a再执行task_b。另外如果需要用昨天的日期填充可以写成pt='{{macros.ds_add(ds, -1)}}'

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?