字节跳动大模型团队成果 Depth Anything V2 现已被苹果官方收入 Core ML 模型库。本文介绍了 Depth Anything 系列成果的研发历程、技术挑战与解决方法,分享了团队对于 Scaling Laws 在单一视觉任务方面的思考。值得一提的是,Depth Anything V1 与 V2 两个版本论文一作是团队实习生。

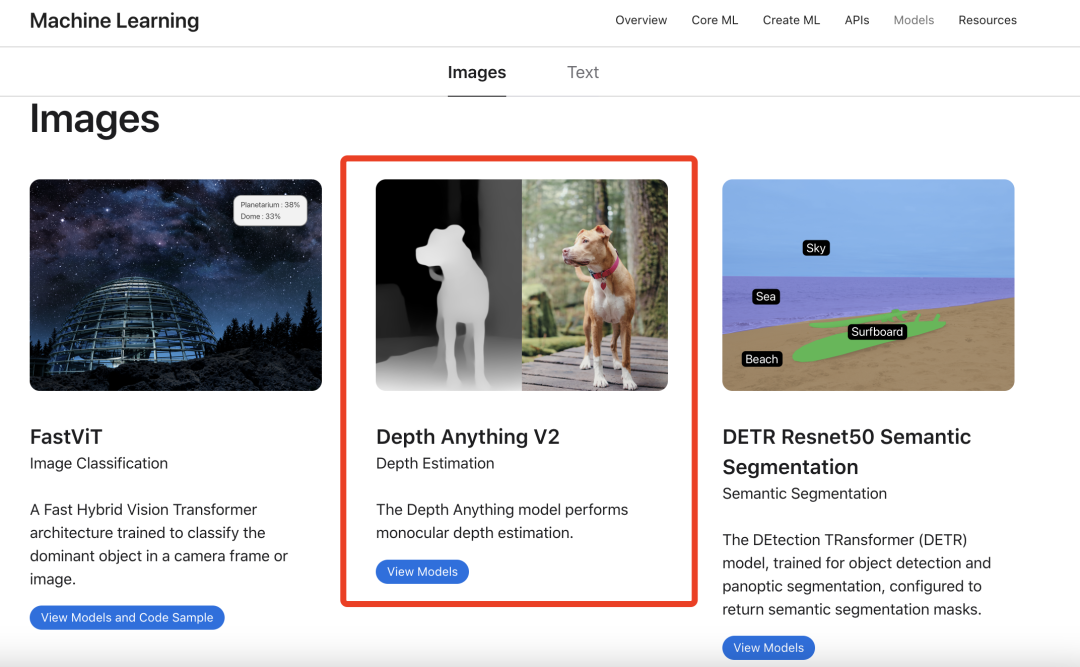

近日,字节跳动大模型团队开发的成果 Depth Anything V2 ,入选苹果公司 Core ML 模型库,目前已呈现在开发者相关页面中。

Depth Anything 是一种单目深度估计模型,V1 版本发布于 2024 年初,V2 版本发布于 2024 年 6 月,包含 25M 到 1.3B 参数的不同大小模型,可应用于视频特效、自动驾驶、3D 建模、增强现实、安全监控以及空间计算等领域。

相比上一代版本,V2 版在细节处理上更精细,鲁棒性更强,并且对比基于 Diffusion 的 SOTA 模型,速度上有显著提升。

目前 Github 上该系列成果总计收获 8.7k Star。其中,Depth Anything V2 发布不久,已有 2.3k star ,更早版本 Depth Anything V1 收获 6.4k Star。值得一提的是,Depth Anything V1 与 V2 两个版本论文一作是团队实习生。

更多模型效果,点击下方视频了解:

本次苹果公司收录的 Depth Anything V2 为 Core ML 版本。作为该公司的机器学习框架,Core ML 旨在将机器学习模型集成到 iOS,MacOS 等设备上高效运行,可在无互联网连接情况下,执行复杂 AI 任务,从而增强用户隐私并减少延迟。

Core ML 版本 Depth Anything V2 采用最小 25M 模型,经 HuggingFace 官方工程优化,在 iPhone 12 Pro Max 上,推理速度达到 31.1 毫秒。与其一同入选的模型还有 FastViT 、ResNet50 、YOLOv3 等,涵盖自然语言处理到图像识别多个领域。

相关论文与更多效果展示:

Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data

论文链接:https://arxiv.org/abs/2401.10891

效果展示:https://depth-anything.github.io/

Depth Anything V2

论文链接:https://arxiv.org/abs/2406.09414

效果展示:https://depth-anything-v2.github.io/

1. Scaling Laws 对单一视觉任务的启示

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1569

1569

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?