赛题理解

基于用户对新闻的操作信息,进行数据分析提取有价值的信息,处理后的数据对构建推荐系统模型也有帮助。同时在数据分析的过程中对用户感兴趣的部分进行挖掘提取,加强用户体验。熟悉数据集里包括的所有数据,对数据中每个字段进行含义解析和可视化分析,了解各数据之间的相关性,用户与文章交互的分布,以分析这些基本属性来帮助构造推荐模型,提高推荐的准确性,也对用户一些分层分布有一定了解。

关于代码

# path = './data/' # 自定义的路径

path = './data/' # 天池平台路径

trn_click = pd.read_csv(path+'train_click_log.csv')

#trn_click = pd.read_csv(path+'train_click_log.csv', names=['user_id','item_id','click_time','click_environment','click_deviceGroup','click_os','click_country','click_region','click_referrer_type'])

item_df = pd.read_csv(path+'articles.csv')

item_df = item_df.rename(columns={'article_id': 'click_article_id'}) #重命名,方便后续match

item_emb_df = pd.read_csv(path+'articles_emb.csv')

tst_click = pd.read_csv(path+'testA_click_log.csv')

trn_click['rank'] = trn_click.groupby(['user_id'])['click_timestamp'].rank(ascending=False).astype(int)

tst_click['rank'] = tst_click.groupby(['user_id'])['click_timestamp'].rank(ascending=False).astype(int)

trn_click['click_cnts'] = trn_click.groupby(['user_id'])['click_timestamp'].transform('count')

tst_click['click_cnts'] = tst_click.groupby(['user_id'])['click_timestamp'].transform('count')

首先对数据进行读取,然后分别对训练集和测试集先进行对user_id的聚合后取出click_timestamp一列进行排序并转换为int类型,之后再统计每个用户总共点击了多少次文章,两个操作的结果都生成新的列记录。

plt.figure()

plt.figure(figsize=(15, 20))

i = 1

for col in ['click_article_id', 'click_timestamp', 'click_environment', 'click_deviceGroup', 'click_os', 'click_country',

'click_region', 'click_referrer_type', 'rank', 'click_cnts']:

plot_envs = plt.subplot(5, 2, i)

i += 1

v = trn_click[col].value_counts().reset_index()[:10]

fig = sns.barplot(x=v['index'], y=v[col])

for item in fig.get_xticklabels():

item.set_rotation(90)

plt.title(col)

plt.tight_layout()

plt.show()

对各基本属性进行统计并取统计结果前10个绘制柱状图进行观察,可发现点击时间中有两个时间是点击量最高的时间,其他时间基本相同。点击环境4和点击设备组1在各自的领域中是占比最高的。在点击系统中,17的占比最高,系统2和系统20也有一部分用户,其他系统的占比均很微小。而观察点击国家的柱状图可看出点击量几乎都由国家1贡献的,其他国家贡献的点击率寥寥无几。

user_click_merge = trn_click.append(tst_click)

#用户重复点击

user_click_count = user_click_merge.groupby(['user_id', 'click_article_id'])['click_timestamp'].agg({'count'}).reset_index()

user_click_count.loc[:,'count'].value_counts()

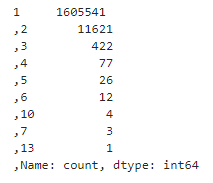

通过以用户id和点击文章id作为主键对表格进行groupby聚合后进行统计,可得出用户点击次数表,对应用户对某篇文章的点击次数,再对点击次数进行统计,得到如上图的结果。可发现大部分用户并无重复点击的情况,一部分用户存在了对同一文章点击两次的情况,极少部分用户对同一文章进行了3次以上的点击。基于此,对于用户重复点击过多的文章,我们可以筛选出来进一步分析其重复点击过多的原因。

user_click_item_count = sorted(user_click_merge.groupby('user_id')['click_article_id'].count(), reverse=True)

plt.plot(user_click_item_count)

plt.plot(user_click_item_count[:50])

统计所有用户的点击次数并进行排序后,绘制折线图观察其分布状况,如上所示,,对总体观察,只有小部分用户的点击量在100次以上,其余用户的点击量都小于100次。对点击量排名前50的用户观察,可发现前50的用户点击量都在100次以上,因此可将点击量100次以上的用户划分作为活跃用户分析。

plt.plot(sorted(user_click_merge.groupby('user_id')['words_count'].mean(), reverse=True))

user_click_merge.groupby('user_id')['words_count'].mean().reset_index().describe()

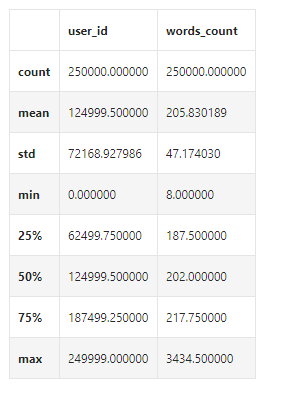

通过对用户点击的文章词数进行分析,可发现大部分用户阅读的文章词数都小于400词,属于短文章类型,而只有极小部分用户会选择阅读400词以上的文章,这可能是由于现在生活节奏加快,大部分人的生活时间开始碎片化导致的。通过对表格使用describe函数分析得出的结果可知,阅读文章词数的平均数为205,且75%分位数为217,故可知大部分用户的阅读文章词数都在200词左右。

总结

本次学习是对新闻点击数据进行分析,数据分析的代码并不难,大部分都浅显易懂,但由于数据本身全为数字,因此在进行绘制平面图可视化数据时,显示的标签都是数字,这样在一定程度上会增加对图的理解难度,故在用matplotlib进行绘制可视化图时可再增加一些细节辅助理解。

由于代码很多,所以我只放了一部分来讲述,讲述的内容都是基于我自己的理解。

总之,本次学习也很顺利,再接再厉

1483

1483

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?