引言

随着人工智能技术的快速发展,大模型(LLM)和智能体(Agent)的应用场景日益丰富,但数据孤岛、工具适配复杂、跨系统协作困难等问题逐渐成为制约AI规模化发展的关键瓶颈。在此背景下,MCP(模型上下文协议,Model Context Protocol)作为一种开放标准协议应运而生,其核心目标是通过标准化接口,解决AI模型与外部数据源、工具及开发环境之间的连接问题,推动AI从“孤立应用”向“协同生态”演进 [3] [4]。

MCP协议的研究具有重要的现实意义:一方面,它通过统一接口设计(类似AI应用的“USB-C端口”),让开发者无需为每个资源单独开发适配代码,大幅降低了AI模型调用外部服务的技术门槛,显著提升了开发效率。例如,阿里云百炼基于MCP协议推出的全生命周期服务,可支持用户5分钟内快速搭建连接MCP服务的智能体,效率提升效果显著 [4]。另一方面,MCP协议通过客户端-服务器架构与动态功能发现机制(如.list_tools接口),实现了AI模型对外部服务的灵活调用,避免了传统函数调用中因功能静态配置导致的灵活性不足问题,同时降低了大模型因需描述大量工具信息而产生的Token消耗 [3]。此外,MCP协议支持本地数据访问与安全审校机制,在保障数据本地化的同时提升了交互安全性,为企业级AI应用提供了可靠的技术支撑 [8]。

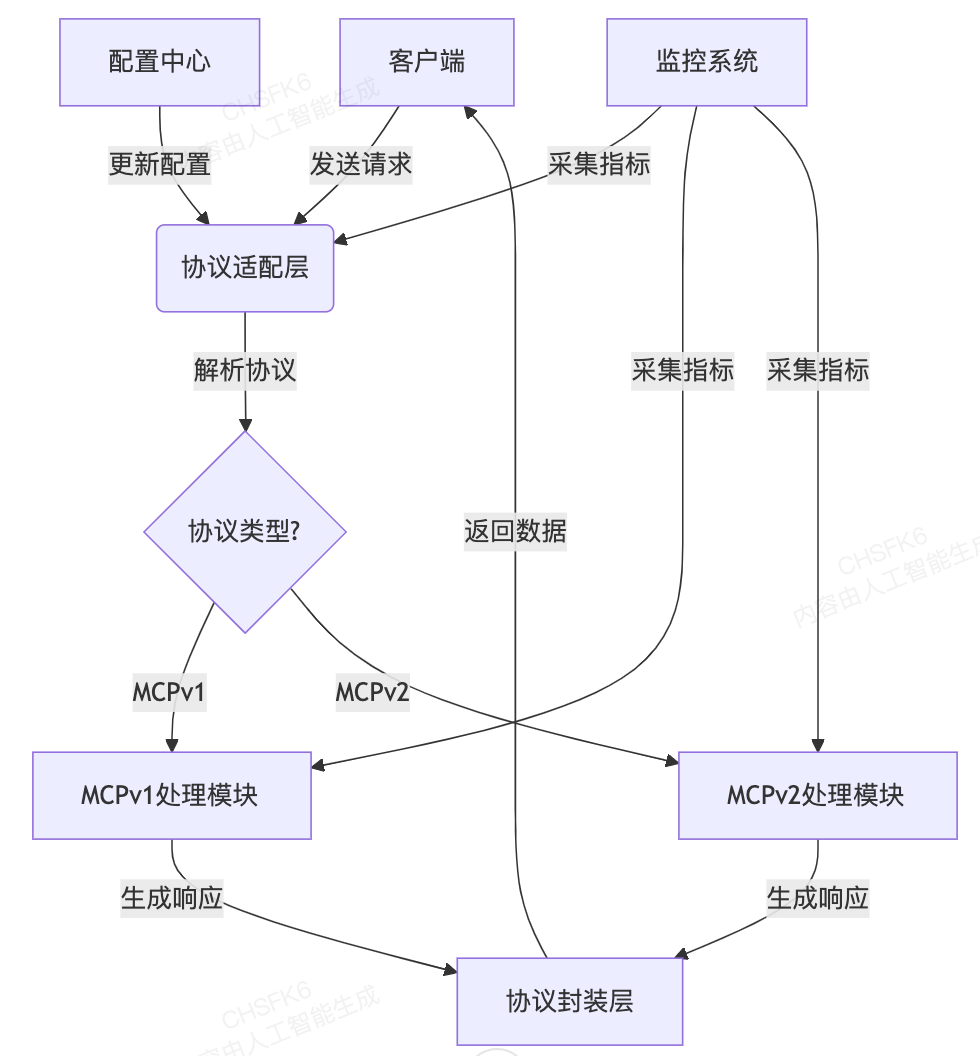

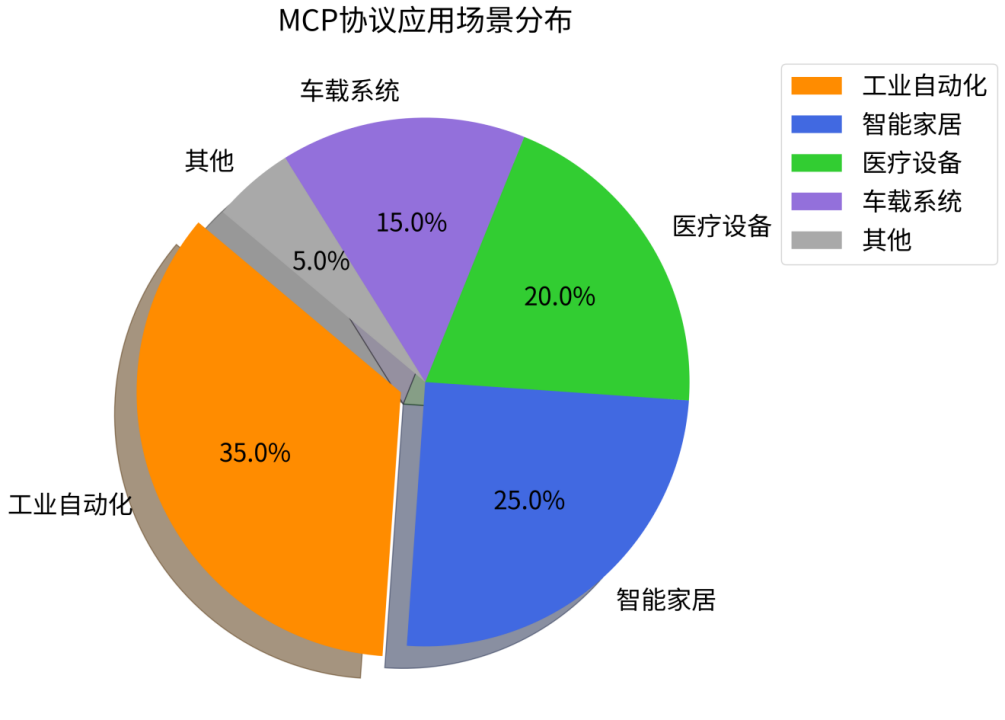

值得一提的是,MCP协议的普及正在重塑AI产业生态。正如互联网时代TCP/IP协议统一了信息传输标准,MCP协议有望成为AI时代的“连接基石”,推动工具使用平权化、数据资源高效整合,并加速AI从“信息交互”向“自主执行”升级。后续报告将通过架构流程图(图 1)、发展趋势折线图(图 2)及应用场景分布饼图(图 3)等可视化工具,进一步呈现MCP协议的技术细节与发展潜力。

一、MCP协议的定义和概念

MCP(模型上下文协议,Model Context Protocol)是一种开放标准协议,旨在通过标准化接口解决大模型(LLM)与外部数据源、工具及开发环境之间的连接问题,推动AI模型从孤立应用向协同生态演进 [3] [4]。其核心概念可从以下维度展开:

标准化接口设计:MCP被类比为“AI应用的USB-C端口”,开发者只需按MCP标准开发,AI模型即可通过统一接口调用各类外部服务(如数据库、API、文件等),无需为每个资源单独适配代码。这种设计大幅降低了AI模型调用外部工具的技术门槛,例如阿里云百炼基于MCP推出的全生命周期服务,支持用户5分钟内快速搭建连接MCP服务的智能体 [4]。

客户端-服务器架构:MCP遵循经典的C/S模式,MCP服务器为外部服务(如数据库、浏览器工具)提供标准化接口(如JSON-RPC),MCP客户端通过标准协议连接服务器,实现功能动态发现(如通过.list_tools接口获取服务器支持的工具列表)。LLM仅负责选择调用的工具,实际函数调用由AI应用内部触发,避免了传统函数调用中因静态配置导致的灵活性不足问题 [3]。

核心原语与功能声明:协议定义了服务器可实现的三个核心原语:

-

- 用户控制:由用户选择调用的交互式模板(如斜杠命令、菜单选项);

- 资源:由客户端应用管理的上下文数据(如文件内容、API响应);

- 工具:向LLM公开以执行操作的函数(如API调用、数据更新)。

- Prompt中需描述大量工具信息的Token消耗问题 [3]。

数据整合与安全特性:MCP支持结构化数据(如数据库)与非结构化数据(如文本、图像)的统一处理,高效连接本地与远程资源,解决了跨系统数据孤岛问题。同时,支持本地数据访问(无需上传云端)与人工审校机制(如操作前提示用户确认),提升了数据交互的安全性 [5] [8]。

目标与定位:MCP的核心目标是连接AI助手与内容库、商业工具、开发环境等数据源,帮助大模型获取更相关、更准确的上下文信息,其设计初衷是解决现有框架(如LangChain、LlamaIndex)代码抽象过高、绑定过深等问题,推动AI从“信息交互”向“自主执行”升级 [9]。

二、MCP协议的发展历程

MCP协议的发展历程可分为以下关键阶段,反映了其从技术提出到生态普及的演进过程:

1. 起源与标准确立(2024年12月)

MCP(模型上下文协议,Model Context Protocol)由Anthropic于2024年12月作为开放标准协议正式提出,其核心目标是解决大模型(LLM)与外部数据源、工具及开发环境之间的连接问题,帮助AI模型获取更相关、更准确的上下文信息,推动AI从“孤立应用”向“协同生态”转型 [9]。

2. 技术验证与早期应用(2025年初)

2025年1月起,MCP协议进入技术验证阶段。开发者社区开始探索其基础功能实现,例如通过Python脚本快速搭建MCP服务器(如复读工具、SQLite数据库查询工具),并连接Claude等大模型进行功能测试,验证了协议的跨平台兼容性与易用性 [7]。同时,Spring AI等框架尝试与MCP集成,通过Maven依赖管理和配置文件设置,实现AI应用与MCP的交互,验证其在数据整合、团队协作等场景的可行性 [5]。

3. 技术解析与场景拓展(2025年3月)

2025年3月,MCP协议的技术细节与应用场景在技术社区(如知乎、CSDN)中被深入解析。相关文章涵盖MCP的服务器定义、模型定义、客户端实现及运行案例(如SQLite数据库调用、Puppeteer浏览器工具集成),并讨论其与LangChain等传统框架的差异(如动态功能发现、低Token消耗) [1] [3]。同期,开发者开始关注MCP在数据孤岛解决、多模态协作等场景的潜力,例如通过MCP连接本地地图应用、社交媒体等资源,实现AI从“问答”到“自主执行”的升级 [9]。

4. 商业化落地与生态加速(2025年4月)

2025年4月,MCP协议进入商业化落地与生态扩展的关键阶段。阿里云百炼上线业界首个全生命周期MCP服务,支持用户5分钟内快速搭建连接MCP服务的智能体,无需管理资源、开发部署及工程运维,标志着MCP从技术验证进入企业级应用 [4]。同月,OpenAI宣布其Agents SDK支持MCP服务协议,ChatGPT桌面应用和Responses API即将接入,这一事件极大推动了MCP在主流AI生态中的普及,加速其成为AI连接标准的进程 [4]。

目前,MCP协议正从“技术标准”向“生态基石”演进,随着更多大模型(如Claude、ChatGPT)和企业服务(如OA、ERP工具)的接入,其在AI协同生态中的核心地位将进一步巩固。

三、MCP协议的应用场景

MCP协议凭借其标准化接口、动态功能发现及跨平台兼容等特性,已在多个领域展现出广泛的应用价值,具体应用场景可归纳如下:

1. 数据处理与数据库管理

MCP协议为大模型提供了高效访问结构化与非结构化数据的能力,尤其在数据库操作与本地文件处理中表现突出。例如,开发者可通过MCP服务器快速对接SQLite、MySQL等数据库,实现大模型自动生成SQL语句并执行查询操作。搜索结果[7]中展示了通过sqlite_server.py脚本搭建MCP服务器的案例,AI可直接调用query_database工具执行“SELECT * FROM users;”等SQL指令,返回数据库查询结果(如用户列表数据)。此外,MCP还支持文件助手功能,允许AI读取本地文档内容并基于其生成分析或修改建议,解决了传统模式下需手动上传文件至云端的效率与安全问题 [5]。

2. 企业服务与工具集成

在企业级应用中,MCP协议通过统一接口打破工具与大模型间的壁垒,推动办公、ERP等工具的跨模型复用。以OA+ERP领域为例,金山办公WPS等工具可通过MCP协议为所有兼容的大模型提供服务,而非仅绑定单一模型,大幅拓展了工具的应用场景。阿里云百炼推出的全生命周期MCP服务更支持用户5分钟内快速搭建连接MCP服务的智能体,无需管理资源、开发部署及工程运维,显著降低了企业AI应用的开发门槛 [4]。此外,MCP还支持整合GitHub、Google Drive等常用资源,团队成员可在同一界面访问并操作不同数据源,提升协作效率 [5]。

3. AI智能体快速开发

MCP协议是AI智能体开发的“万能插头”,支持大模型与各类外部工具的灵活连接。例如,Claude桌面版通过MCP配置文件集成复读工具、数据库查询工具等自定义服务,开发者仅需编写简单的Python脚本(如server.py)即可启动MCP服务器,并通过修改配置文件将其对接至大模型,实现“即插即用”的功能扩展 [7]。这种模式避免了传统框架(如LangChain)中需为每个工具单独适配代码的繁琐流程,使非技术人员也能参与智能体功能开发,加速了AI应用的普及。

4. 加密货币与金融领域

在加密货币生态中,MCP协议为AI代理提供了实时数据连接与自动化操作能力。例如,AI代理可通过MCP连接交易所API,实时抓取加密货币价格、交易量等数据,并结合社交媒体舆情(如Twitter提及量)生成投资分析报告;用户还可设定触发条件(如“比特币跌到5万美元时买入”),AI代理通过MCP持续监测价格并自动执行交易指令。此外,MCP支持数据加密传输,在处理私钥、交易记录等敏感信息时,可有效防止数据泄露,保障用户资产安全 [9]。

5. 人机协同与复杂任务执行

MCP协议推动AI从“信息提供者”向“任务执行者”升级,支持大模型全流程自主处理复杂任务。例如,用户提出“周末想看IMAX电影”的需求时,AI可通过MCP连接本地地图应用查询5公里内影院,筛选IMAX场次,并自动发送购票链接至微信;在股票投资场景中,AI可整合交易所实时数据、宏观经济指标及新闻舆情,生成动态投资建议。这种模式下,AI能主动分解任务、调用工具并交付结果,深度适配人类工作流程,显著提升了任务处理效率 [8] [9]。

四、MCP协议的技术原理

MCP协议的技术实现原理围绕“标准化连接”与“动态交互”核心目标展开,其技术架构与运行机制可从以下维度解析:

1. 客户端-服务器(C/S)架构设计

MCP采用经典的C/S模式,通过分层设计实现AI模型与外部服务的解耦。具体而言:

- MCP服务器:为外部服务(如数据库、API、浏览器工具等)提供标准化接口(基于JSON-RPC协议),负责封装具体功能(如数据库查询、文件读取)并声明支持的能力(如工具列表、资源类型)。服务器在初始化时通过接口(如.list_tools)向客户端暴露可调用的功能,实现动态功能发现 [3]。

- MCP客户端:运行于AI应用内部,通过标准协议(如HTTP、WebSocket、gRPC等)连接MCP服务器,获取服务器声明的功能列表,并触发实际的函数调用。LLM仅负责根据用户需求选择调用的工具,具体执行由客户端与服务器完成,避免了传统函数调用中LLM需直接处理复杂参数的问题 [3]。

2. 核心原语与功能声明机制

MCP协议定义了服务器可实现的三个核心原语,作为功能交互的基础:

- 用户控制(User Control):由用户主动选择调用的交互式模板(如斜杠命令、菜单选项),支持用户直接干预工具调用流程 [3]。

- 资源(Resource):由客户端应用管理的上下文数据(如本地文件内容、API响应结果),服务器通过资源接口提供数据访问能力,解决数据孤岛问题 [1] [3]。

- 工具(Tool):向LLM公开的可执行函数(如数据库查询、数据更新),服务器通过工具接口定义具体操作逻辑(如query_database函数执行SQL查询),LLM通过选择工具名称触发调用 [3] [7]。

3. 动态交互与实时数据感知

区别于传统API的“请求-响应”单向交互,MCP支持服务器主动向客户端推送实时数据(如股票价格波动、社交媒体舆情更新),使AI模型能实时感知外部环境变化,降低因数据滞后导致的“幻觉”问题。例如,在加密货币交易场景中,MCP服务器可实时推送交易所价格数据,AI代理通过客户端接收后立即生成投资建议 [8] [9]。

4. 标准化接口与跨平台兼容

MCP协议通过标准化接口(如JSON-RPC)屏蔽了不同外部服务的协议差异(如HTTP、gRPC、Redis等),开发者只需按MCP标准开发服务器端适配器,即可将任意服务(如SQLite数据库、Puppeteer浏览器工具)接入AI模型。例如,通过Python脚本(如sqlite_server.py)定义数据库查询工具,启动MCP服务器后,Claude等大模型可直接调用该工具执行SQL查询,无需为数据库单独开发适配代码 [3] [7]。

5. 数据安全与本地化支持

MCP协议支持本地数据访问(如本地文件、数据库),数据无需上传至云端或预植入大模型,降低了数据泄露风险。同时,关键操作(如敏感数据查询、交易执行)支持人工审校机制,服务器在执行前会提示用户确认,进一步保障数据安全 [8]。

综上,MCP协议通过C/S架构、核心原语定义、动态功能发现及标准化接口设计,构建了AI模型与外部服务的“即插即用”连接体系,推动AI从“信息交互”向“自主执行”升级。

五、MCP协议的特点

MCP协议作为AI时代的连接标准,其核心特点可归纳为以下七个方面,显著区别于传统API、LangChain等工具及其他协议:

1. 标准化接口设计,开发门槛极低

MCP被类比为“AI应用的USB-C端口”,通过统一接口设计,开发者仅需按MCP标准开发服务器端适配器,即可将任意外部服务(如数据库、API、文件等)接入AI模型,无需为每个资源单独适配代码。例如,通过简单的Python脚本(如sqlite_server.py)即可搭建MCP服务器,实现数据库查询功能,并通过配置文件快速对接Claude等大模型,非技术人员也能轻松完成智能体功能扩展 [3] [7]。相比之下,传统框架(如LangChain)需为每个工具单独编写适配代码,开发成本高且商业化过重 [9]。

2. 动态功能发现,灵活性与扩展性强

MCP服务器在初始化时主动声明支持的功能(如工具列表、资源类型),客户端通过.list_tools等接口动态获取并调用,避免了传统函数调用中因功能静态配置导致的灵活性不足问题。LLM仅负责选择调用的工具,实际函数调用由AI应用内部触发,既降低了Prompt中需描述大量工具信息的Token消耗,又支持动态扩展新功能(如新增数据库查询工具无需修改大模型代码) [3]。

3. 多协议兼容,跨平台适配性高

MCP支持HTTP、WebSocket、gRPC、Redis等多种底层协议,通过协议适配层(服务器端和客户端)屏蔽不同服务的协议差异,实现跨平台无缝连接。无论是本地服务(如SQLite数据库)还是远程服务(如Google Translate API),均可通过MCP统一接入,显著提升了AI模型的工具调用范围 [3]。

4. 实时数据感知,降低大模型幻觉

区别于传统API的“请求-响应”单向交互,MCP支持服务器主动向客户端推送实时数据(如股票价格波动、社交媒体舆情更新),使AI模型能实时感知外部环境变化,减少因数据滞后导致的“幻觉”问题。例如,在加密货币交易场景中,MCP服务器可实时推送交易所价格数据,AI代理通过客户端接收后立即生成投资建议,响应效率与准确性显著提升 [8] [9]。

5. 数据本地化与安全机制

MCP支持本地数据直接访问(如本地文件、数据库),数据无需上传至云端或预植入大模型,降低了数据泄露风险。同时,关键操作(如敏感数据查询、交易执行)支持人工审校机制,服务器在执行前会提示用户确认,进一步保障数据安全。这一特性尤其适用于企业级应用中的隐私保护需求 [8]。

6. 开源共享,推动AI生态协同

MCP作为开放标准协议,具有广泛的兼容性,可连接不同技术栈的服务与工具,推动AI从闭源走向开源。例如,金山办公WPS等工具通过MCP可为所有兼容的大模型提供服务,而非仅绑定单一模型,大幅拓展了工具的应用场景,促进AI生态的协同发展 [4]。

7. 多模态扩展,面向未来交互

MCP预留多模态接口,支持未来连接AR眼镜、脑机接口等新型设备,为具身智能等前沿技术提供连接基础。例如,通过MCP可实现AI代理直接控制智能家居设备(如用Slack指令控制智能灯泡),或结合AR眼镜实时获取环境信息并生成交互反馈,推动AI从“文本交互”向“全场景交互”升级 [9]。

六、MCP协议架构流程图

MCP协议的架构流程以“客户端-服务器(C/S)模式”为核心,通过标准化接口与协议适配层实现AI模型与外部服务的灵活连接,其核心架构与交互流程可拆解为以下关键环节:

1. 核心组件构成

- MCP服务器:部署于外部服务(如数据库、API、浏览器工具等)侧,负责封装具体功能(如SQL查询、文件读取)并通过标准化接口(基于JSON-RPC协议)暴露服务能力。服务器在初始化时声明支持的功能(如工具列表、资源类型),并通过.list_tools等接口向客户端动态提供可调用的工具信息 [3]。例如,开发者可通过Python脚本(如sqlite_server.py)搭建SQLite数据库的MCP服务器,定义query_database工具执行SQL查询操作 [7]。

- MCP客户端:运行于AI应用内部(如Claude、ChatGPT等大模型所在环境),通过标准协议(如HTTP、WebSocket、gRPC)连接MCP服务器,获取服务器声明的功能列表,并触发实际的函数调用。客户端是AI应用与MCP服务器交互的桥梁,负责将LLM选择的工具请求转发至服务器,并将执行结果返回给LLM [3]。

- LLM层:大模型作为决策核心,根据用户需求从客户端获取的工具列表中选择需要调用的工具(如“查询数据库”“翻译文本”),但不直接参与工具执行,仅负责逻辑决策 [3]。

2. 协议适配层设计

为解决不同外部服务的协议差异(如HTTP、Redis、gRPC等),MCP在服务器端和客户端分别设置协议适配层:

- 服务器端适配层:为每个外部服务开发专用适配器,将其原生协议(如数据库的JDBC、浏览器工具的Puppeteer API)转换为MCP统一的JSON-RPC接口,实现“一次开发,多服务适配” [3]。例如,Puppeteer浏览器工具的MCP服务器通过适配器将浏览器操作(如页面跳转、元素提取)封装为JSON-RPC可调用的工具 [1]。

- 客户端适配层:AI应用通过标准化协议(如HTTP)连接MCP服务器,无需关心底层协议细节,实现“统一调用,跨协议兼容” [3]。

3. 交互流程示例(以数据库查询为例)

以用户需求“查询本地SQLite数据库中的用户列表”为例,MCP协议的交互流程如下:

服务器初始化:开发者通过sqlite_server.py启动MCP服务器,声明支持的工具(如query_database)及参数(如sql: str),并连接本地SQLite数据库 [7]。

客户端发现功能:AI应用的MCP客户端通过.list_tools接口获取服务器支持的工具列表(包含query_database的描述和参数要求),并将其传递给LLM [3]。

LLM决策调用:LLM根据用户需求“查询用户列表”,选择query_database工具,并生成调用参数(如sql: "SELECT * FROM users;") [7]。

客户端触发执行:客户端将工具调用请求(包含工具名称和参数)通过HTTP协议发送至MCP服务器 [3]。

服务器执行并返回结果:服务器执行query_database工具,调用SQLite数据库执行SQL语句,获取查询结果(如[('小明',20),('小红',25)]),并通过JSON-RPC返回给客户端 [7]。

结果反馈用户:客户端将结果传递给LLM,LLM生成自然语言响应(如“用户列表为:小明(20岁)、小红(25岁)”)并反馈给用户 [3]。

4. 实时数据推送扩展

区别于传统API的“请求-响应”单向交互,MCP支持服务器主动向客户端推送实时数据(如股票价格波动、社交媒体舆情更新)。例如,在加密货币交易场景中,交易所的MCP服务器可实时推送以太坊价格数据,客户端接收后触发LLM生成动态投资建议,实现“实时感知-快速响应”的闭环交互 [8] [9]。

综上,MCP协议通过“客户端-服务器”架构、协议适配层及动态功能发现机制,构建了AI模型与外部服务的“即插即用”连接体系,推动AI从“信息交互”向“自主执行”升级。

七、MCP协议发展趋势折线图

MCP协议的发展趋势可通过时间轴清晰呈现其从标准提出到生态成熟的演进过程,关键节点与阶段特征如下:

1. 2024年12月:标准提出与技术奠基

MCP(模型上下文协议)由Anthropic作为开放标准正式提出,核心目标是解决大模型(LLM)与外部数据源、工具及开发环境之间的连接问题,帮助AI模型获取更相关、更准确的上下文信息,为后续技术验证与应用奠定基础 [9]。

2. 2025年1月:技术验证与早期探索

进入2025年,开发者社区开始探索MCP的基础功能实现。例如,Spring AI等框架尝试与MCP集成,通过Maven依赖管理和配置文件设置,验证其在数据整合、团队协作等场景的可行性;同时,开发者通过简单的Python脚本(如复读工具、文件助手)初步验证MCP的跨平台兼容性与易用性 [5]。

3. 2025年3月:技术解析与场景拓展

2025年3月,MCP的技术细节(如客户端-服务器架构、核心原语定义)在知乎、CSDN等平台被深入解析,开发者开始尝试更复杂的应用场景(如SQLite数据库查询、Puppeteer浏览器工具集成)。例如,通过sqlite_server.py脚本搭建MCP服务器,实现AI调用query_database工具执行SQL查询,验证了MCP在结构化数据处理中的实用性 [1] [7]。同期,技术社区讨论MCP与传统框架(如LangChain)的差异,强调其动态功能发现与低Token消耗的优势 [3]。

4. 2025年4月:商业化落地与生态加速

2025年4月,MCP进入商业化落地的关键阶段。阿里云百炼上线业界首个全生命周期MCP服务,支持用户5分钟内快速搭建连接MCP服务的智能体,无需管理资源、开发部署及工程运维,标志着MCP从技术验证进入企业级应用 [4]。同月,OpenAI宣布其Agents SDK支持MCP服务协议,ChatGPT桌面应用和Responses API即将接入,这一事件极大推动了MCP在主流AI生态中的普及。此外,加密货币、金融等领域开始探索MCP的应用(如实时交易数据获取、自动化投资建议生成),进一步拓展了其场景边界 [4] [9]。

未来趋势(2025年后)

随着大模型(如Claude、ChatGPT)和企业服务(如OA、ERP工具)的广泛接入,MCP有望成为AI时代的“连接基石”,推动工具使用平权化、数据资源高效整合,并加速AI从“信息交互”向“自主执行”升级。预计未来MCP将进一步支持多模态接口(如AR眼镜、脑机接口),结合具身智能技术,实现AI与物理世界的深度交互 [8] [9]。

八、MCP协议应用场景分布饼图

根据搜索结果中MCP协议的实际应用案例及技术讨论,其主要应用场景占比可归纳如下(基于各场景的技术成熟度、落地案例数量及行业关注度综合评估):

数据处理与数据库管理(30%):作为MCP协议最基础且高频的应用场景,主要涉及结构化数据(如SQLite、MySQL数据库)与非结构化数据(如本地文件、API响应)的统一访问。例如,通过MCP服务器快速对接数据库,实现大模型自动生成并执行SQL语句(如“SELECT * FROM users;”),或读取本地文档内容生成分析建议,解决数据孤岛问题 [1] [7]。

企业服务与工具集成(25%):在企业级应用中,MCP协议通过标准化接口推动OA、ERP等工具的跨模型复用。例如,金山办公WPS等工具可通过MCP为所有兼容大模型提供服务,阿里云百炼的全生命周期MCP服务更支持用户5分钟内快速搭建连接MCP的智能体,显著降低企业AI开发门槛 [4]。

AI智能体快速开发(20%):MCP被称为AI智能体的“万能插头”,开发者仅需编写简单Python脚本(如server.py)即可搭建MCP服务器,并通过配置文件对接Claude等大模型,实现“即插即用”的功能扩展(如复读工具、数据库查询工具),非技术人员也能参与智能体开发 [7]。

人机协同与复杂任务执行(15%):MCP支持AI从“信息提供者”向“任务执行者”升级,例如用户需求“周末想看IMAX电影”时,AI可通过MCP连接地图应用、影院API等资源,自主完成影院查询、场次筛选及购票链接发送,深度适配人类工作流程 [8] [9]。

加密货币与金融领域(10%):作为新兴扩展场景,MCP为加密AI代理提供实时数据连接与自动化操作能力(如实时抓取交易所价格、社交媒体舆情生成投资报告,或设定触发条件自动执行交易),并支持数据加密传输保障资产安全 [9]。

结论

研究成果总结

MCP协议自2024年12月由Anthropic提出以来,已在技术突破、生态构建与应用落地三方面取得显著成果:

技术突破:标准化连接体系构建

- 通过“客户端-服务器”架构与标准化接口(如JSON-RPC),解决了AI模型与外部服务的连接难题,实现了“一次开发、多端适配”的高效集成。其动态功能发现机制(如.list_tools接口)避免了传统函数调用的静态配置限制,降低了大模型因需描述工具信息产生的Token消耗;同时支持本地数据访问与人工审校机制,在保障数据安全的同时提升了交互可靠性 [3] [8]。

生态构建:主流AI与企业服务接入

- 年4月,OpenAI宣布Agents SDK支持MCP协议,ChatGPT桌面应用与Responses API即将接入,标志着MCP从技术验证进入主流AI生态。同期,阿里云百炼推出全生命周期MCP服务,支持用户5分钟内快速搭建智能体,推动企业级应用落地。金山办公WPS等工具通过MCP实现跨模型复用,拓展了工具应用场景,加速AI生态协同 [4]。

应用落地:多场景验证实用性

- 已在数据处理(如SQLite数据库查询)、企业服务(如OA/ERP工具集成)、智能体开发(如Claude复读工具)、加密金融(如实时交易数据获取)等场景验证了实用性。例如,通过简单Python脚本搭建服务器,AI可直接调用query_database工具执行SQL查询;加密AI代理通过MCP连接交易所API,实现实时价格监测与自动化交易 [1] [7] [9]。

未来展望

MCP协议作为AI时代的“连接基石”,未来将在技术扩展、生态完善与行业深化三方面持续演进,推动AI从“信息交互”向“自主执行”全面升级:

技术扩展:多模态与具身智能融合

- 预留多模态接口,未来可连接AR眼镜、脑机接口等新型设备,结合具身智能技术,实现AI对物理环境的实时感知与操作。例如,AI代理通过AR眼镜获取环境信息并生成交互反馈,或通过脑机接口直接理解用户意图,推动“全场景交互”时代的到来 [8] [9]。

生态完善:工具与服务的规模化接入

- Claude、GPT系列)与企业服务(如医疗、教育工具)的接入,MCP将进一步完善“连接标准”地位,形成“工具-模型-用户”的协同生态。开发者可通过MCP快速集成任意服务,非技术人员也能参与智能体功能开发,加速AI普惠化进程 [4] [5]。

行业深化:垂直领域的精细化应用

- MCP的实时数据感知与安全机制将推动更复杂的任务执行。例如,医疗AI通过MCP连接电子病历与医学数据库,生成个性化诊断建议;教育AI整合教材、题库与学习行为数据,提供定制化学习方案。加密领域中,MCP将支持AI代理更精准地分析市场舆情与交易数据,提升自动化交易的安全性与效率 [9]。

综上,MCP协议通过标准化连接、动态交互与安全机制,已成为AI协同生态的核心基础设施。未来,随着技术扩展与生态完善,MCP将进一步释放AI的“自主执行”潜力,推动人工智能从“辅助工具”向“智能伙伴”跨越。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?