适用平台:Matlab2021b版及以上

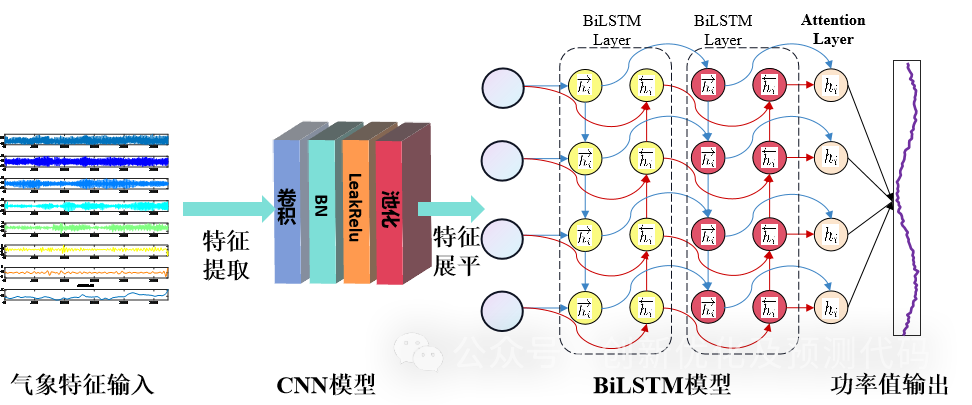

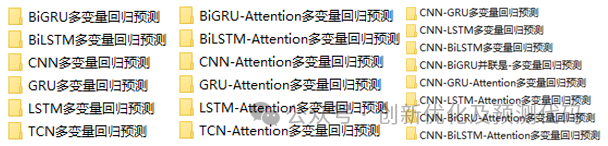

方法:你肯定见过这样的文献:什么CNN、LSTM、GRU、BiLSTM、GRU、Attention以及它们的复合模型CNN-LSTM、CNN-GRU模型等经久不衰,我们的程序中额外加入了特征可视化的部分,提高模型的可解释性。

期刊水平:仔细看下面的文献均来自《中国电机工程学报》《电网技术》《高电压技术》《电工技术学报》《电力系统自动化》等国内顶级EI期刊

发文日期:从2021-2023-至今,不同的深度学习方法组合成复合预测模型,这是当前的发文主流,你也可以!

复合模型:以CNN-BiLSTM-Attention复合模型为例,结合了卷积神经网络(CNN)和长短时记忆网络(LSTM),以克服各自模型在处理序列数据中的局限性。以下是CNN-LSTM复合模型的一些优势:

局部和全局特征捕捉:CNN通过卷积层可以有效地捕捉输入序列中的局部特征,而LSTM则能够学习序列中的长期依赖关系,捕捉全局特征。这种组合允许模型同时关注序列的局部和全局信息,提高了对序列中复杂模式的识别能力。

时空关系建模:对于时序数据中的时空关系,CNN-LSTM模型能够利用CNN对时间序列进行卷积操作,捕捉时间上相邻的特征,并通过LSTM记忆单元来处理序列中的长期依赖。这使得模型能够更好地理解输入数据的时空结构。

层次性特征提取:CNN通常在底层提取低级特征,而LSTM在更高层次上提取抽象的特征。通过将它们组合在一起,模型可以在不同层次上进行层次性的特征提取,使得模型能够更全面地理解输入序

Attention自注意力机制:自注意力层被嵌入到BiLSTM层后,自注意力层用于捕捉时间序列数据中的全局依赖关系,自注意力机制允许网络在学习时动态地调整各个时间步的权重,以便更好地捕捉长期依赖和全局模式。

首先简单介绍现有的预测算法特点!再将它们按需搭积木式结合:

CNN-LSTM,CNN-GRU CNN-BiLSTM,CNN-BiGRU,CNN-LSTM-Attention,CNN-GRU-Attention,CNN-BiLSTM-Attention,CNN-BiGRU-Attention,TCN-Attention,你也可以发表高水平论文!

CNN(卷积神经网络):CNN适用于图像数据,但在时序数据中也可用。卷积层可以捕捉输入序列中的局部模式。对于风速-光伏-功率回归预测,CNN可以通过学习时间序列中的局部特征来提高预测性能。用于捕捉局部模式,有助于识别特定时间窗口内的变化,适用于一维波动时序数据。

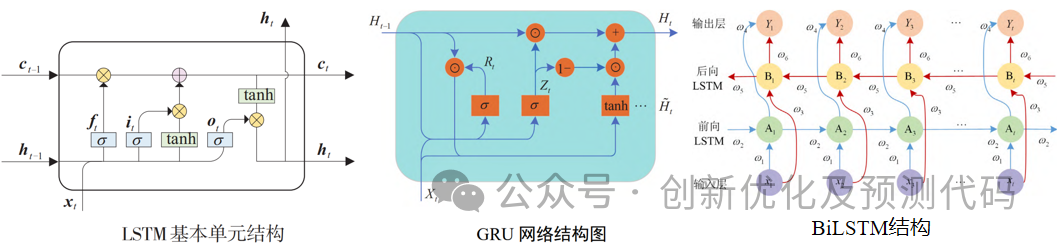

LSTM(长短时记忆网络):LSTM专门设计用于处理序列数据。其内部结构允许网络选择性地保留或遗忘信息,有助于处理时序数据中的长期依赖关系。在风速-光伏-功率回归预测中,LSTM可以更好地捕捉不同时间步之间的关联,适用于处理光伏和风速等具有动态变化的特征。

GRU(门控循环单元):GRU与LSTM类似,但结构更简单。它也适用于处理序列数据,具有更新门和重置门来调节信息的流动。GRU相对于LSTM计算效率更高,对于中等规模的数据集可能表现得更好。

BiLSTM(双向长短时记忆网络):BiLSTM结合了前向和后向的LSTM,同时考虑过去和未来的上下文信息。在风速-光伏-功率回归预测中,BiLSTM可以更全面地捕捉时间序列中的模式,尤其是在需要考虑全局前后数据的情况,需要注意测试集数据泄露的问题。

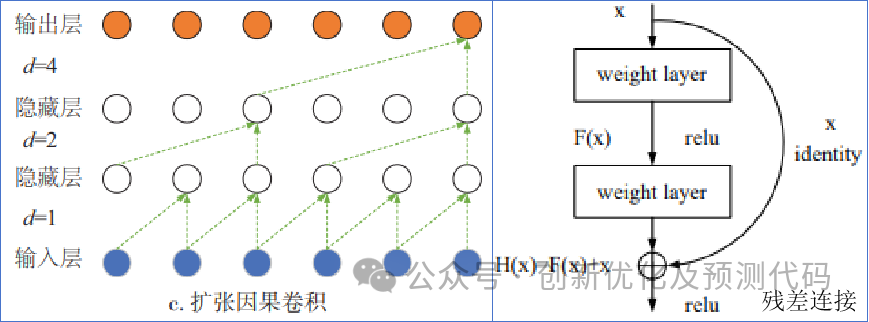

TCN(时域卷积网络): TCN创新地提出一维扩张因果卷积层构建残差结构来捕捉序列中的模式,并通过堆叠这些层来增加模型的复杂性。它具有并行计算的优势。优势:在风速-光伏-功率回归预测中,TCN可以有效地捕捉序列中的局部和全局模式,具有较快的训练速度。

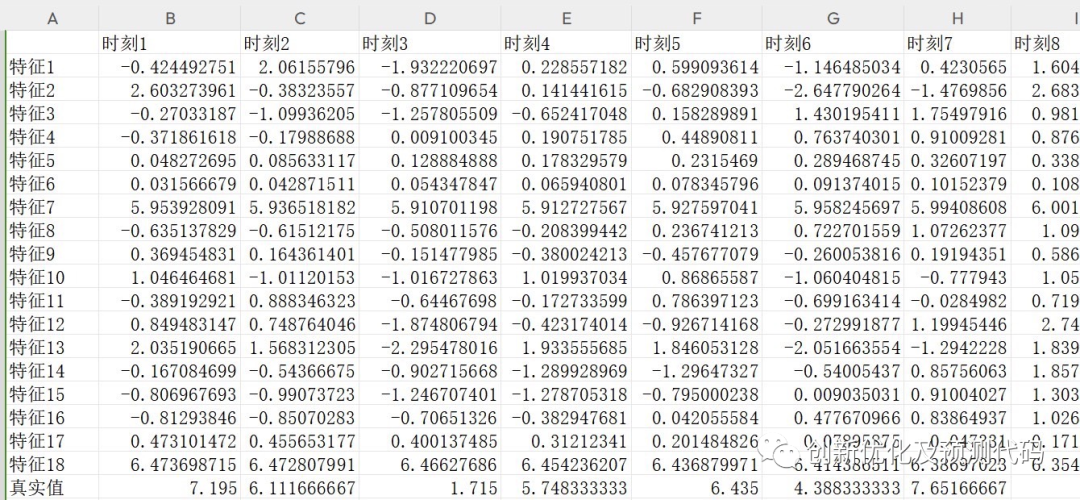

程序数据集格式:

前一天18个气象特征(特征),采样时间为24小时,输出为第二天的24小时的功率出力(真实值),也就是18×24输入,1×24输出,一共有75个这样的样本。

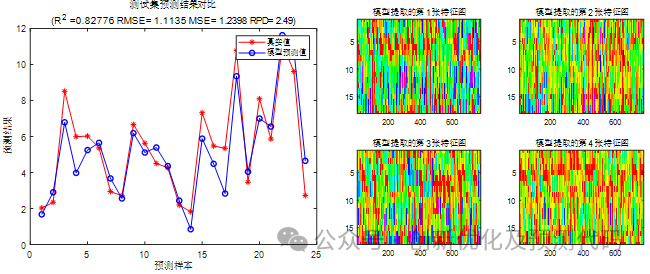

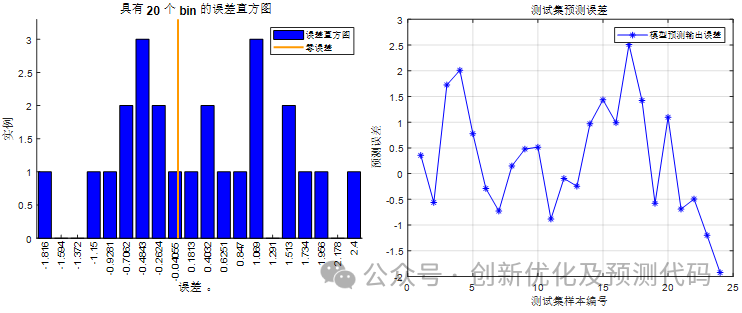

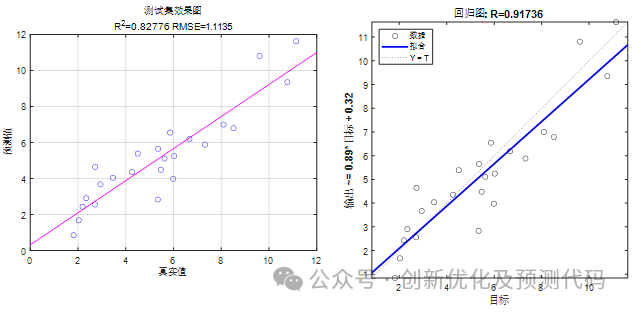

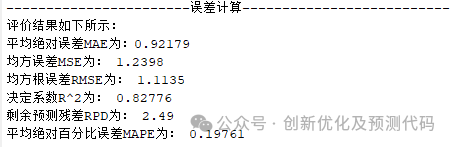

下面展示模型的出图效果!

部分图片来源于网络,侵权联系删除!

关注小编会不定期推送高创新型、高质量的学习资料、文章程序代码,为你的科研加油助力!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?