该部分笔记参考课程:https://aistudio.baidu.com/aistudio/projectdetail/717724

加载飞桨、numpy相关类库

#加载飞桨、numpy相关类库

import paddle

import numpy as np

import paddle.fluid as fluid

#飞桨主库:fluid

import paddle.fluid.dygraph as dygraph

#dygraph动态图类库

#静态图模式(声明式编程范式,类比C++):先编译后执行;性能更好便于部署

#动态图模式(命令式编程范式,类比Python):解析式执行方式;更方便调试

from paddle.fluid.dygraph import Linear

#Linear 为神经网络的全连接层函数

#即对所有输入进行权重相加并包含激活函数的基本神经元结构

import os

'''

os模块是python与操作系统交互的主要模块

os模块可以弥补操作系统之间差异带来的编程方面的不同

工作中使用的主要场景就是在文件路径描述

windows和linux 之间文件路径的不同.

https://www.jianshu.com/p/ed0774f82816

'''

import random数据处理

#**************** 数据处理 ************

def load_data():

#从文件中导入数据

datafile = './work/housing.data'

data = np.fromfile(datafile, sep = ' ')

'''

fromfile()函数读回数据时需要用户指定元素类型

并对数组的形状进行适当的修改

fromfile(dataname, dtype = np.float, count = -1, sep = ' ')

http://doc.codingdict.com/NumPy_v111/reference/generated/numpy.fromfile.html

https://blog.csdn.net/kebu12345678/article/details/54837245

'''

feature_names = ['CRIM', 'ZN', 'INDUS', 'CHAS', 'NOX', 'RM', 'AGE', \

'DIS', 'RAD', 'TAX', 'PTRATIO', 'B', 'LSTAT', 'MEDV']

feature_num = len(feature_names)

#此时数据为一维列向量

#将原始数据Reshape,变成[N,14]的形状

data = data.reshape(data.shape[0]//feature_num, feature_num)

# 将原数据集拆分成训练集和测试集

# 这里使用80%的数据做训练,20%的数据做测试

# 测试集和训练集必须是没有交集的

ratio = 0.8

offset = int(data.shape[0] * ratio)

training_data = data[:offset]

#计算train数据集的最大值,最小值,平均值

maximums, minimums, avgs = training_data.max(axis = 0), training_data.min(axis = 0), \

training_data.sum(axis = 0)/training_data.shape[0]

#记录数据的归一化参数,在预测时对数据做归一化

global max_values

global min_values

global avgs_values

max_values = maximums

min_values = minimums

avgs_values = avgs

#对数据进行归一化处理

for i in range(feature_num):

data[:, i] = (data[:, i] - avgs_values[i]) / (max_values[i] - min_values[i])

#测试集与训练集采用相同的标准进行归一化

training_data = data[:offset]

test_data = data[offset:]

return training_data, test_data模型设计

#**************** 模型设计 ************

'''

模型定义的实质是定义线性回归的网络结构

通过创建Python类的方式完成模型网络的定义

即定义init函数和forward函数

在forward函数中使用的网络层需要在init函数中声明

'''

#定义init函数:在类的初始化函数中声明每一层网络的实现函数

class Regressor(fluid.dygraph.Layer):

def __init__(self):

super(Regressor, self).__init__()

# 定义一层全连接层,输出维度是1,激活函数为None,即不使用激活函数

self.fc = Linear(input_dim = 13, output_dim = 1, act = None)

# 网络的前向计算函数

#定义forward函数:构建神经网络结构,实现前向计算过程

def forward(self, inputs):

x = self.fc(inputs)

return x训练配置

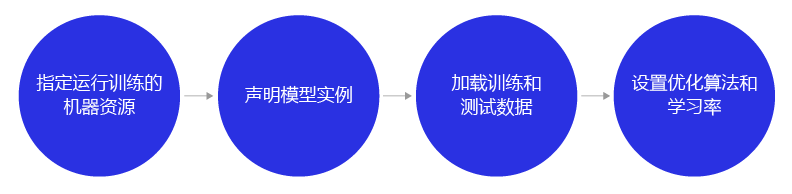

- 以guard函数指定运行训练的机器资源,表明在with作用域下的程序均执行在本机的CPU资源上。dygraph.guard表示在with作用域下的程序会以飞桨动态图的模式执行(实时执行)。

- 声明定义好的回归模型Regressor实例,并将模型的状态设置为训练。

- 使用load_data函数加载训练数据和测试数据。

- 设置优化算法和学习率,优化算法采用随机梯度下降SGD,学习率设置为0.01。

#**************** 训练配置 ************

#定义飞桨动态图的工作环境

with fluid.dygraph.guard():

#声明定义的回归模型

model = Regressor()

#开启训练模式

model.train()

#加载数据

training_data, test_data = load_data()

# 定义优化算法,这里使用随机梯度下降-SGD

# 学习率设置为0.01

opt = fluid.optimizer.SGD(learning_rate = 0.01, parameter_list = model.parameters())说明:

- 默认本案例运行在读者的笔记本上,因此模型训练的机器资源为CPU。

- 模型实例有两种状态:训练状态

.train()和预测状态.eval()。训练时要执行正向计算和反向传播梯度两个过程,而预测时只需要执行正向计算。为模型指定运行状态,有两点原因:

(1)部分高级的算子(例如Drop out和Batch Normalization)在两个状态执行的逻辑不同。

(2)从性能和存储空间的考虑,预测状态时更节省内存,性能更好。

- 在上述代码中可以发现声明模型、定义优化器等操作都在

with创建的 fluid.dygraph.guard()上下文环境中进行,可以理解为with fluid.dygraph.guard()创建了飞桨动态图的工作环境,在该环境下完成模型声明、数据转换及模型训练等操作。 - 使用飞桨框架只需要定义SGD就可以实现优化器设置,大大简化了随机梯度下降法的编写过程。

训练过程

- 内层循环:采用分批的方式将整个数据集遍历一次;batch的取值会影响模型训练效果。batch过大,会增大内存消耗和计算时间,且效果并不会明显提升;batch过小,每个batch的样本数据将没有统计意义。

- 外层循环: 定义遍历数据集的次数,通过参数EPOCH_NUM设置

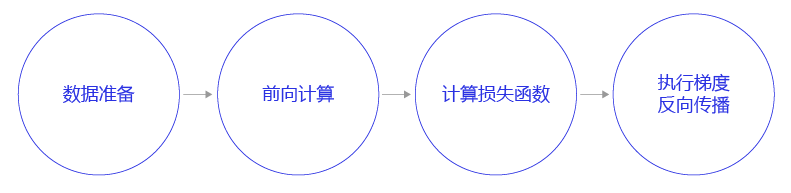

- 内层循环需执行以下四个步骤:

- 数据准备:将数据转变成np.array和内置格式

- 前向计算:将一个批次的样本数据灌入网络中,计算输出结果。

- 计算损失函数:以前向计算结果和真实房价作为输入,通过损失函数square_error_cost计算出损失函数值(Loss)。

- 反向传播:执行梯度反向传播

backward函数,即从后到前逐层计算每一层的梯度,并根据设置的优化算法更新参数opt.minimize。

#**************** 训练过程 ************

#定义工作环境

with dygraph.guard(fluid.CPUPlace()):

#定义批大小及训练次数

EPOCH_NUM = 10

BATCH_SIZE = 10

#定义外层循环

for epoch_id in range(EPOCH_NUM):

#在每轮迭代开始之前,将训练数据的顺序随机的打乱

np.random.shuffle(training_data)

#将训练数据进行拆分,每个batch包含10条数据(数据集较小)

mini_batches = [training_data[k:k+BATCH_SIZE] for k in range(0, len(training_data), BATCH_SIZE)]

#定义内层循环

for iter_id, mini_batch in enumerate(mini_batches):

x = np.array(mini_batch[:,:-1]).astype('float32')

#获得当前批次训练数据

y = np.array(mini_batch[:,-1:]).astype('float32')

#获得当前批次训练标签(真实房价)

#将numpy数据转化成飞桨动态图variable形式

house_features = dygraph.to_variable(x)

prices = dygraph.to_variable(y)

#前向计算

predicts = model(house_features)

#计算损失

loss = fluid.layers.square_error_cost(predicts, label = prices)

avg_loss = fluid.layers.mean(loss)

if iter_id % 20 == 0:

#每200个数据输出一次

print("epoch: {}, iter: {}, loss is:{}".format(epoch_id, iter_id, avg_loss.numpy()))

#反向传播

avg_loss.backward()

#最小化loss更新参数

opt.minimize(avg_loss)

#清除梯度

model.clear_gradients()

#保存模型

fluid.save_dygraph(model.state_dict(), 'LR_model')保存和测试模型

#*********** 测试模型 ************

#现实应用场景中模型的训练和测试往往是分开的

'''

配置模型预测的机器资源。本案例默认使用本机,因此无需写代码指定。

将训练好的模型参数加载到模型实例中。

从文件中读取模型参数;将参数内容加载到模型。

加载完毕后,需要将模型的状态调整为eval()(校验)。

校验和预测状态的模型只需要支持前向计算,模型的实现更加简单,性能更好。

将待预测的样本特征输入到模型中,打印输出的预测结果。

'''

#定义函数实现从数据集中抽取一条样本作为测试样本

def load_one_example(data_dir):

f = open(data_dir, 'r')

datas = f.readlines()

#readlines()从文件中一行一行地读数据(包括换行符),返回一个列表

#选择倒数第十条数据用于测试

tmp = datas[-10]

tmp = tmp.strip().split()

#strip()删除字符序列,默认删除空白符

#split()通过指定分隔符对字符串进行切片,并返回分割后的字符串列表(list)

one_data = [float(v) for v in tmp]

#对数据进行归一化处理

for i in range(len(one_data)-1):

one_data[i] = (one_data[i] - avgs_values[i]) / (max_values[i] - min_values[i])

data = np.reshape(np.array(one_data[:-1]), [1,-1]).astype(np.float32)

label = one_data[-1]

return data, label

with dygraph.guard():

#参数为保存模型参数的文件地址

model_dict, _ = fluid.load_dygraph('LR_model')

model.load_dict(model_dict)

model.eval()

#参数为数据集的文件地址

test_data, label = load_one_example('./work/housing.data')

#此处为什么不直接使用之前划分好的测试集的数据?

#将数据转化为动态图的variable格式

test_data = dygraph.to_variable(test_data)

results = model(test_data)

#对结果做反归一化处理

results = results * (max_values[-1] - min_values[-1]) + avgs_values[-1]

print("Inference result is {}, the corresponding label is{}".format(results.numpy(), label))

通过比较“模型预测值”和“真实房价”可见,模型的预测效果与真实房价接近。房价预测仅是一个最简单的模型,使用飞桨编写均可事半功倍。那么对于工业实践中更复杂的模型,使用飞桨节约的成本是不可估量的。同时飞桨针对很多应用场景和机器资源做了性能优化,在功能和性能上远强于自行编写的模型。

861

861

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?