近日马斯克旗下大模型公司 xAI 宣布正式开源 3140 亿参数的混合专家(MoE)模型「Grok-1」,以及该模型的权重和网络架构。这也使得Grok-1成为当前参数量最大的开源大语言模型。

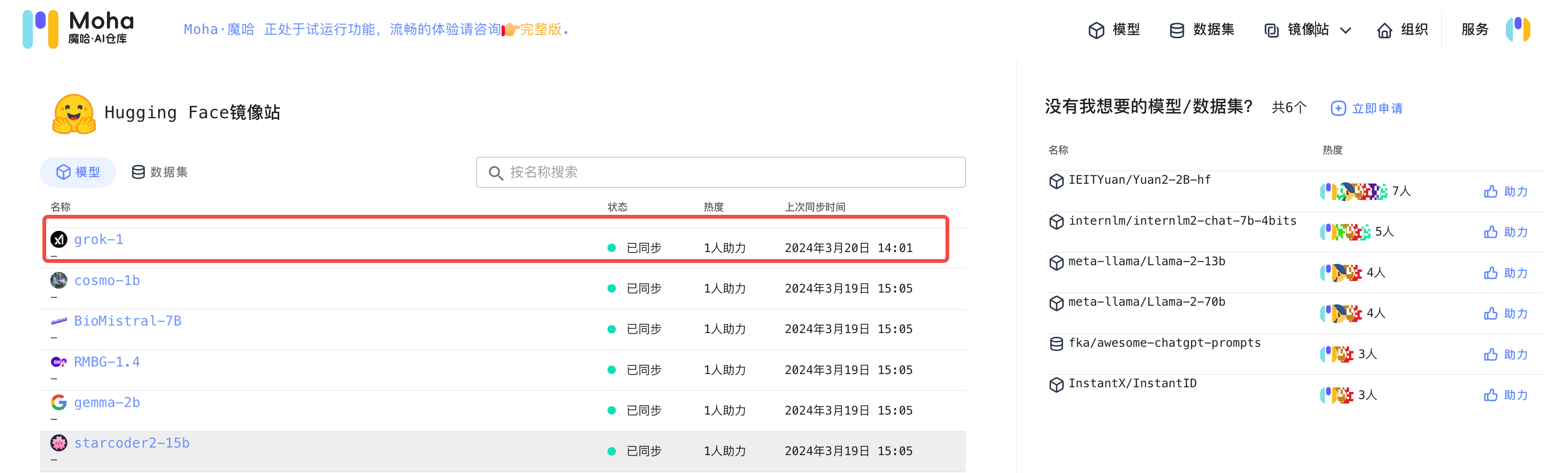

当前,魔哈已经完整从HuggingFace上将grok-1镜像下来,并每日后台在自动与HF同步更新。赶紧分享给你身边还在“抱怨”无法下载的小伙伴吧 👋

您可以使用huggingface-cli和git两种方法下载grok

hunggingface-cli 下载

export HF_ENDPOINT=https://moha.xiaoshiai.cn/huggingface

huggingface-cli download xai-org/grok-1

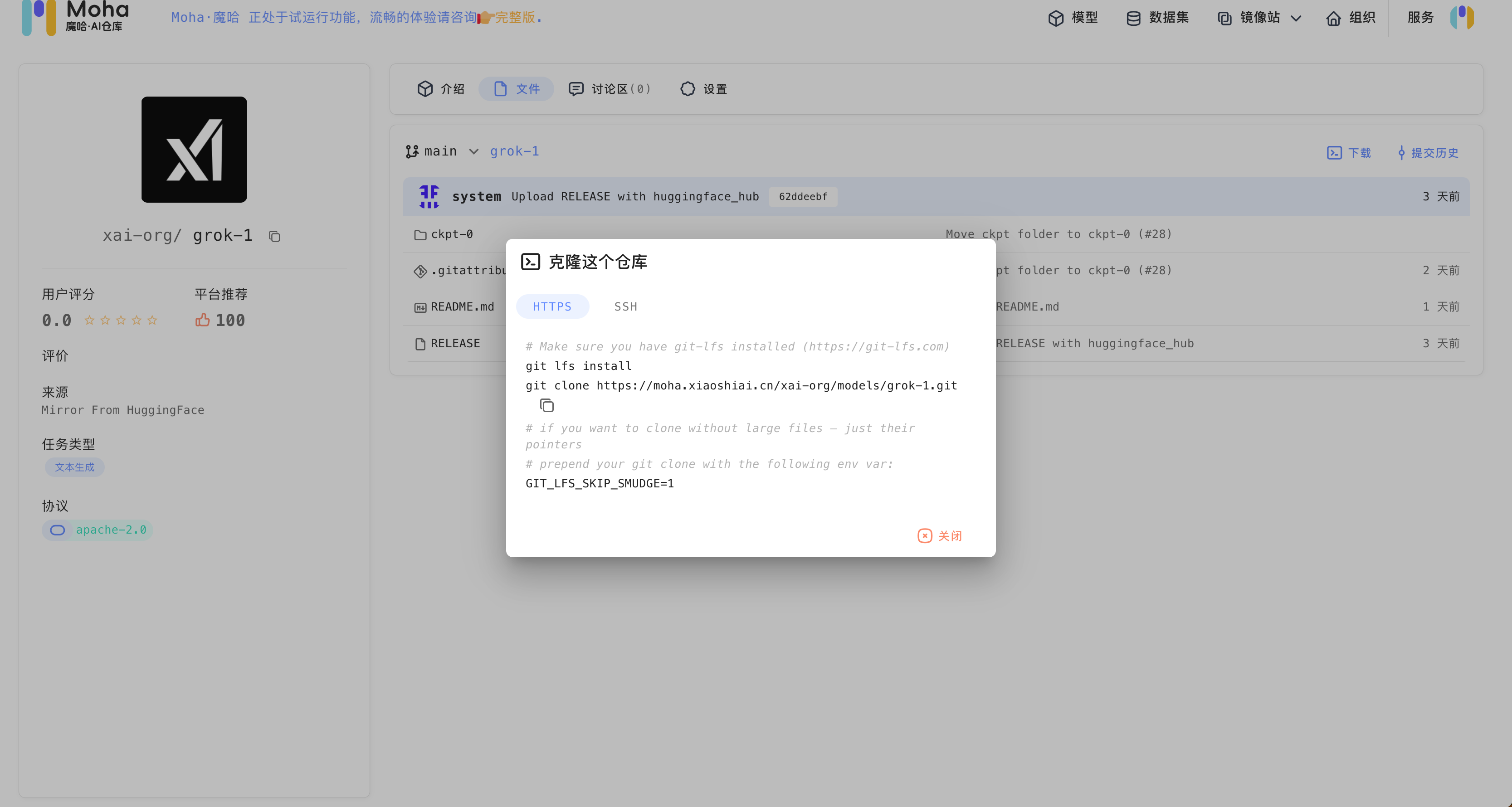

Git 下载

晓石AI

关注公众号"晓石AI" 了解我们更多产品

1403

1403

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?