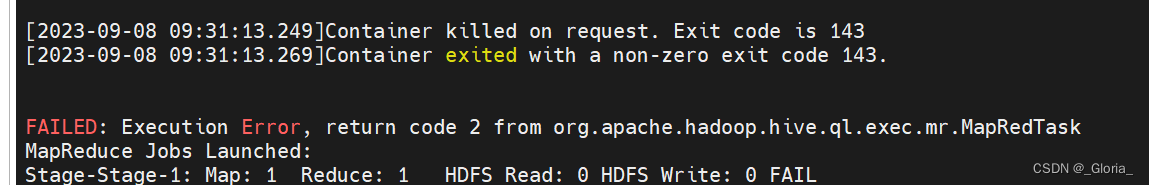

在Hive中执行相对复杂的hql时,总是会报错,exit code为143.

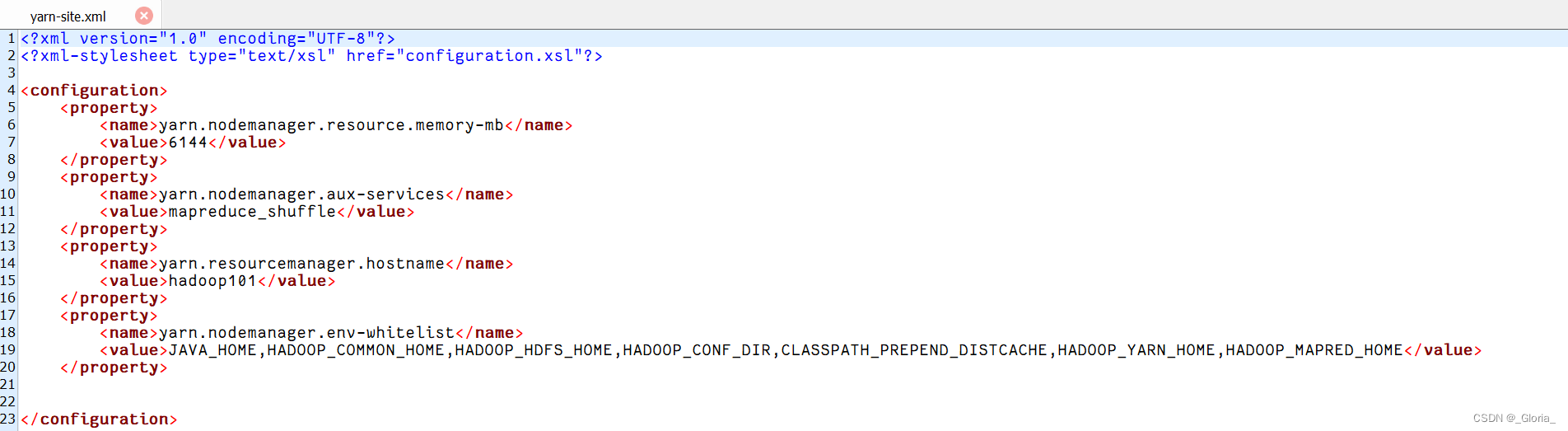

根据网上的解决办法,我将虚拟机的内存从4G增大到8G,并在yarn-site.xml中进行如下修改,将yarn.nodemanager.resource.memory=mb 从(4*1024*0.75= 3072)改成(8*1024*0.75=6144)

这样就没有再报错了.

接下来使用sqoop时又出现了报错,也是143错误.

大家可以看这个链接:

hadoop - Container is running beyond memory limits - Stack Overflow

向mapred-site.xml配置文件中添加

<property>

<name>mapreduce.map.memory.mb</name>

<value>4096</value>

</property>

<property>

<name>mapreduce.reduce.memory.mb</name>

<value>4096</value>

</property>

3466

3466

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?