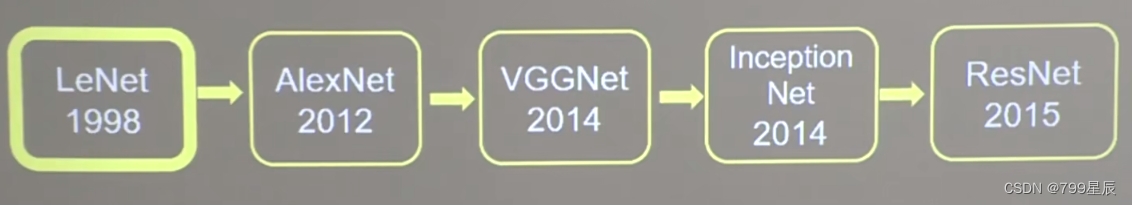

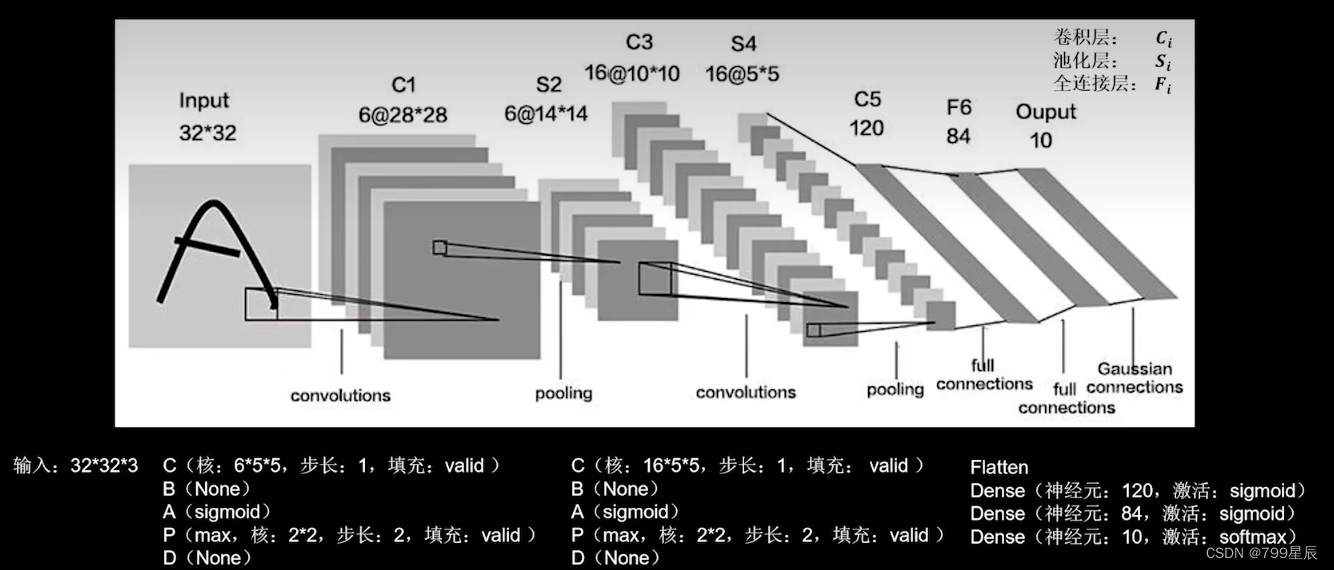

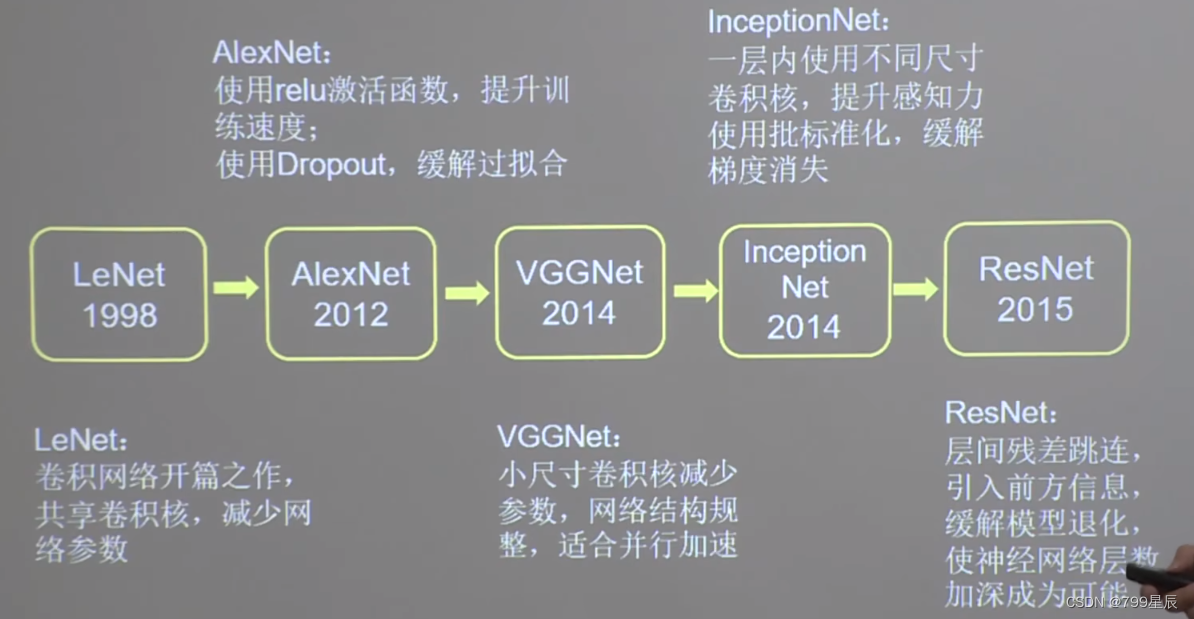

LeNet

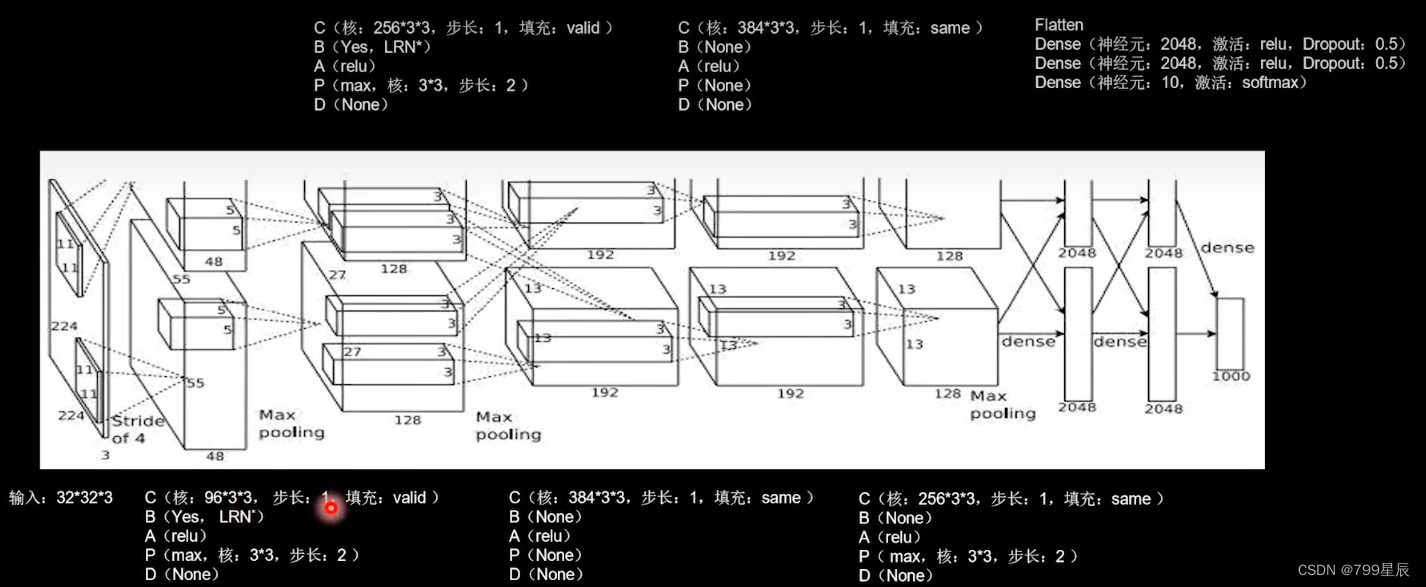

AlexNet

使用ReLu激活函数提升了训练速度,使用Dropout缓解了过拟合。

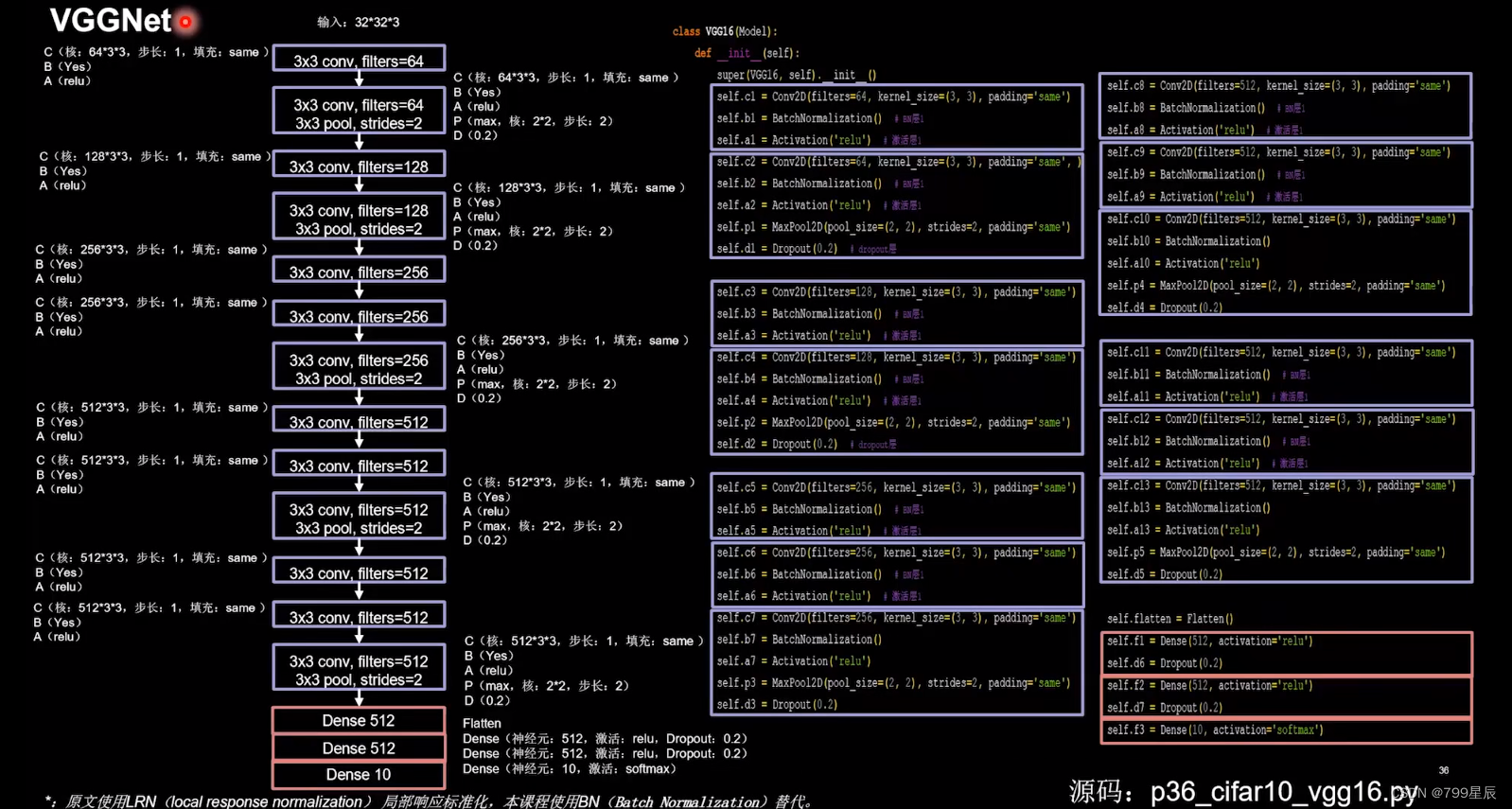

VGGNet

使用小尺寸卷积核,在减少参数的同时,提高了识别准确率。

越靠后,特征图越小,通过增加卷积核的个数,增加了特征图的深度,保持了信息的承载能力。

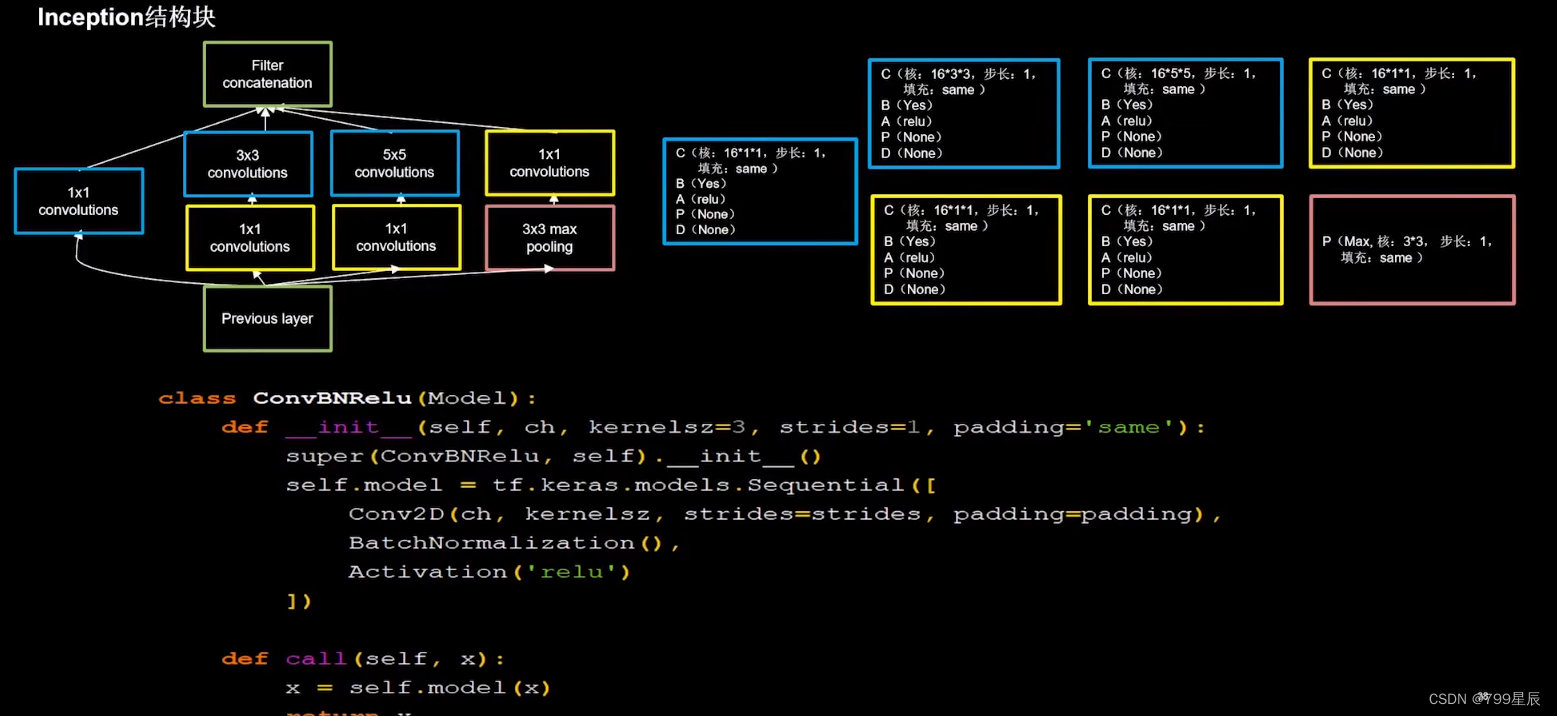

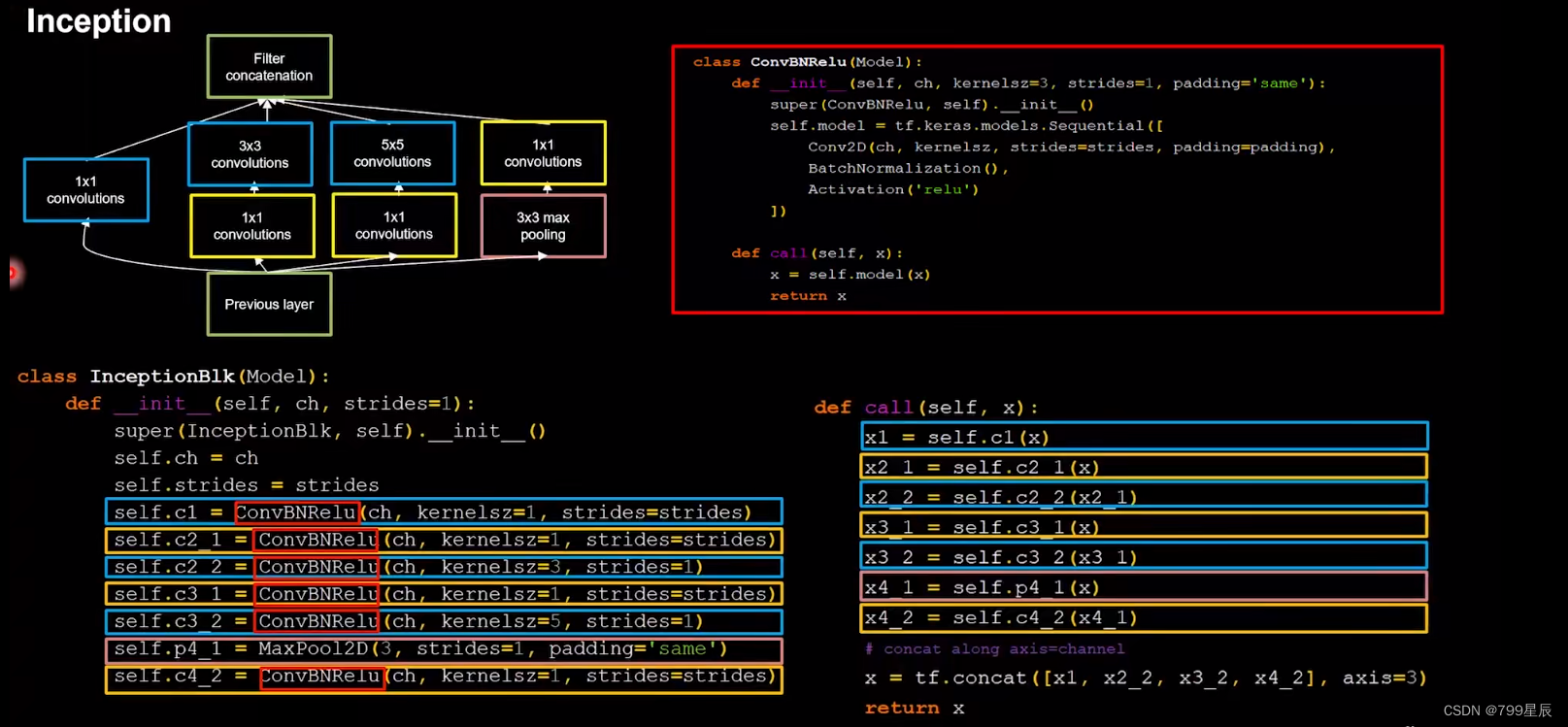

InceptionNet

引入了Inception结构块,在同一层网络内使用不同尺寸的卷积核,提升了模型感知力;使用了批标准化,缓解了梯度消失。

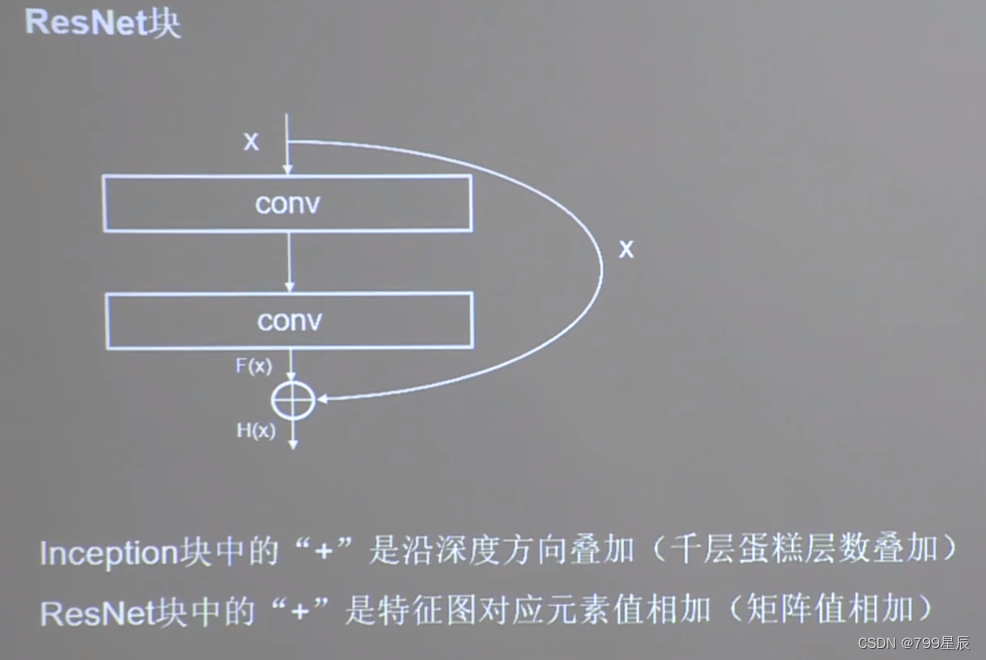

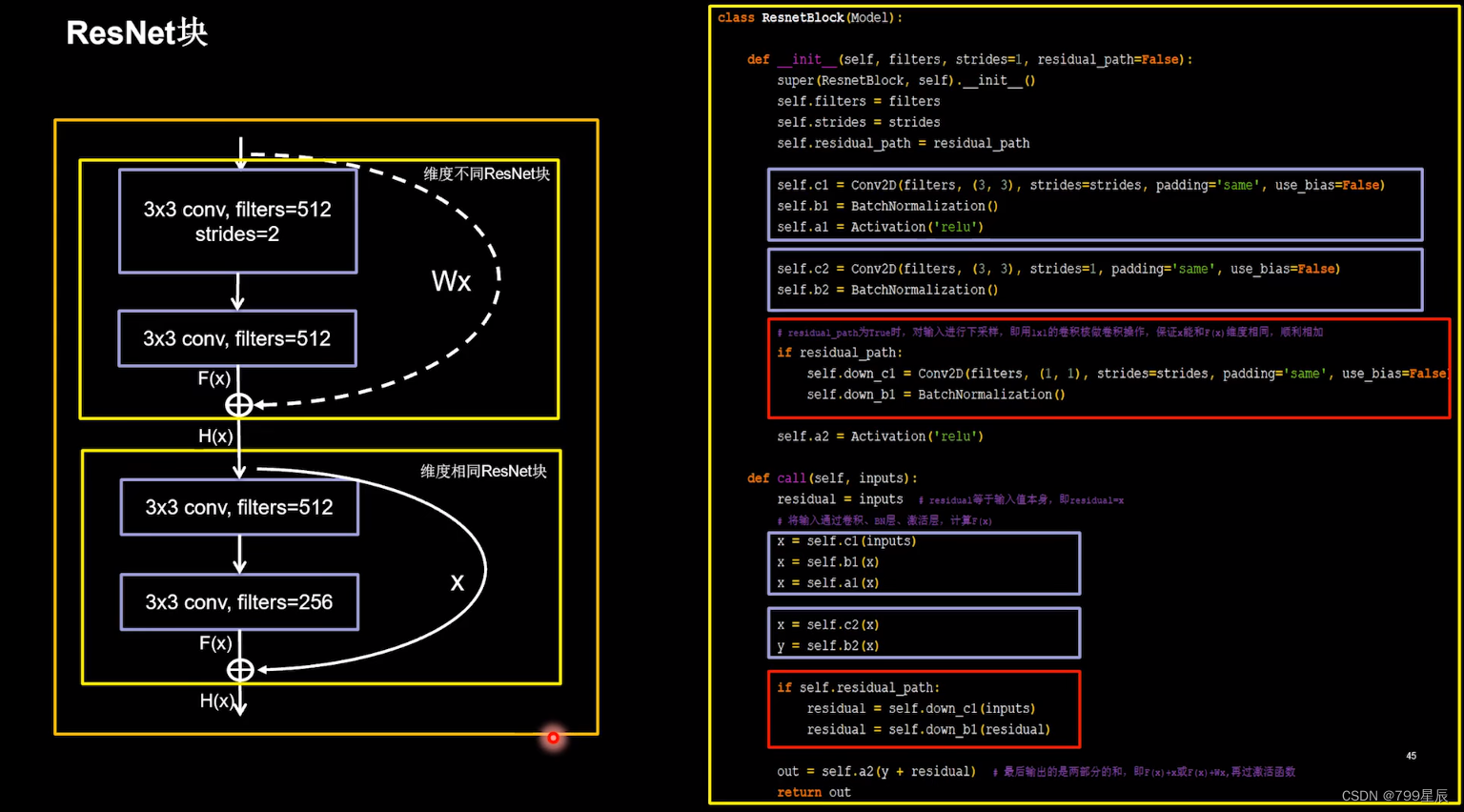

ResNet

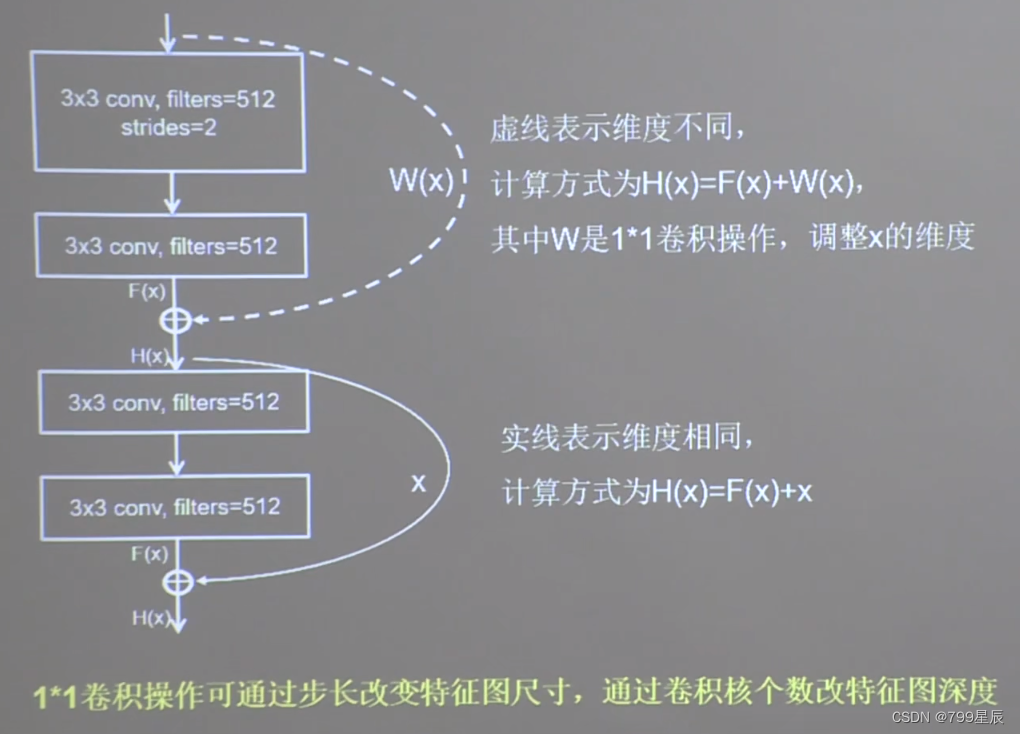

ResNet块有两种不同的结构,如图虚线和实线两种。

x是输入,y是输出。call函数是入口,根据if条件判断调用init中的函数。

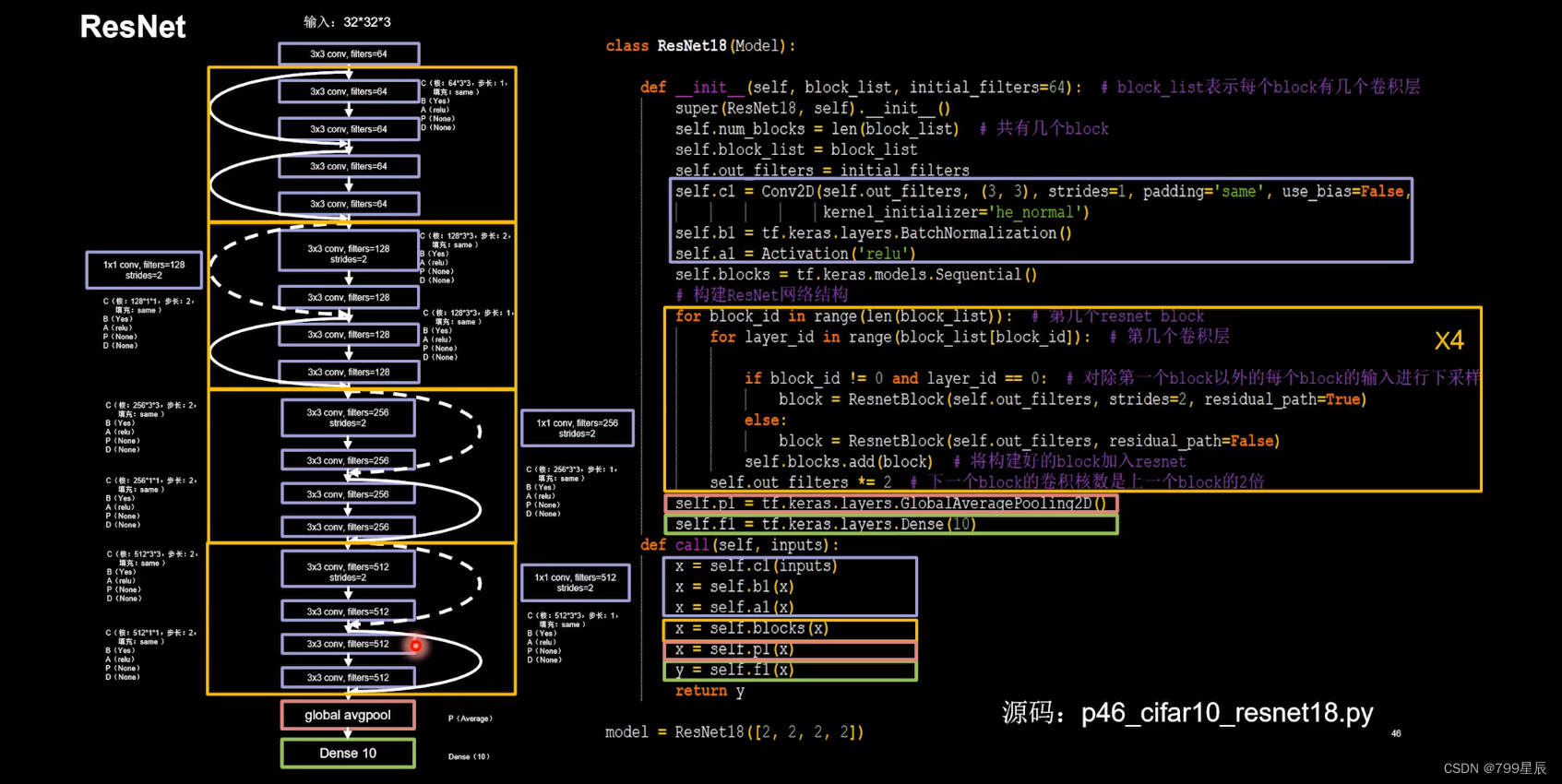

搭建网络结构(代码)

第一层采用64个3*3的卷积核。接下来是8个resnet块(4个橙色块)。

residual_path=true 虚线连接;residual_path=false 实线连接

经典卷积神经网络总结

134

134

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?