单机搭建(hadoop,zookeeper为集群,hbase是单机)

1.上传jdk,hadoop,zookeeper,hbase压缩包

2.解压到/usr/local目录下

3.配置jdk,hadoop,zookeeper,hbase环境变量

4.搭建hadoop集群

5.搭建zookeeper集群

6.更改Hbase配置

1.修改hbase-env.sh配置

cd /usr/local/hbase-2.0.5/conf

vim hbase-env.sh

- 修改jdk路径

export JAVA_HOME=/usr/local/jdk1.8.0_201

- 是否运用hbase自带zookeeper改为false

#export HBASE_MANAGES_ZK=true

改为

export HBASE_MANAGES_ZK=false

2.修改hbase-site.xml配置

vim hbase-site.xml

添加以下配置

<!-- 指定hdfs地址 -->

<property>

<name>hbase.rootdir</name>

<value>hdfs://Hbase1:9000/hbase</value>

</property>

<!-- 指定hbase是否为分布式 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 指定zookeeper集群的地址 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>Hbase1:2181,Hbase2:2181,Hbase3:2181</value>

</property>

3.修改regionservers配置(节点位置)

Hbase1

7.启动zookeeper(三台)

zkServer.sh start

8.启动Hadoop(一台)

start-dfs.sh

9.访问浏览器

http://192.168.88.81:16010/master-status

集群搭建(3台)

1.修改regionservers配置

vim regionservers

Hbase1

Hbase2

Hbase3

2.发送配置好的HBase和环境变量到其他两台

scp -r /usr/local/hbase-2.0.5 Hbase2:$PWD

scp -r /usr/local/hbase-2.0.5 Hbase3:$PWD

scp /etc/profile Hbase2:$PWD

scp /etc/profile Hbase3:$PWD

(注意发完之后生效环境变量)

source /etc/profile

3.启动zookeeper(三台)

zkServer.sh start

4.启动Hadoop(一台)

start-dfs.sh

5.启动Hbase

start-hbase.sh

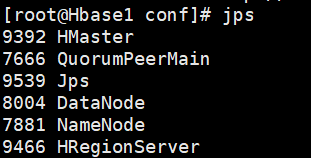

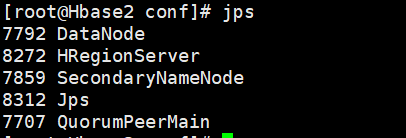

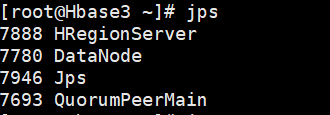

6.查看集群状态

Hmaster高可用配置

1.同时控制三台主机添加一个配置

cd /usr/local/hbase-2.0.5/conf/

touch backup-masters

echo Hbase2 > backup-masters

cat backup-masters

2.在其中一台主机上启动hbase

start-hbase.sh

启动hbase的主机和Hbase2主机上都有Hmaster进程

327

327

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?