Softmax 定义及作用

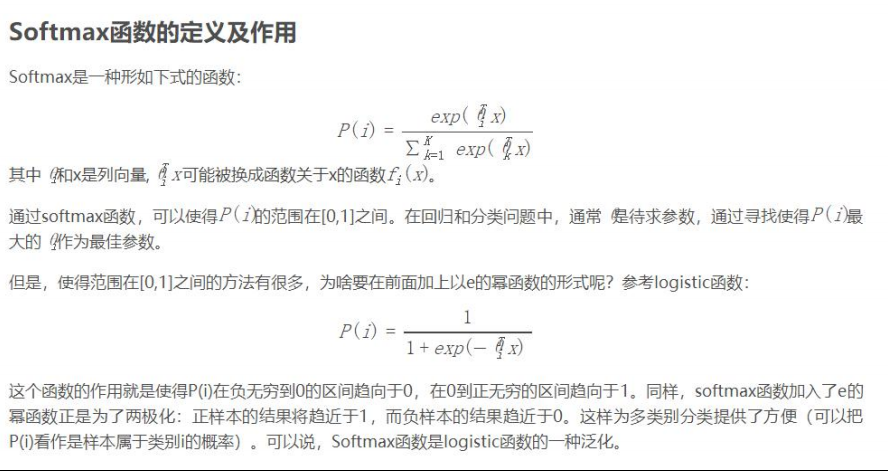

softmax

函数可以把它的输入,通常被称为

logits

或者

logit scores

,处理成

0

到

1

之间,并且能够把输出归一化到和为1

。这意味着

softmax

函数与分类的概率分布等价。它是一个网络预测多分类问题的最佳输出激活函数。

常用的优化器有哪些

Optimizer:

tf.train.GradientDescentOptimizer

tf.train.AdadeltaOptimizer

tf.train.AdagradOptimizer

tf.train.AdagradDAOptimizer

tf.train.MomentumOptimizer

tf.train.AdamOptimizer

tf.train.FtrlOptimizer

tf.train.ProximalGradientDescentOptimizer

tf.train.ProximalAdagradOptimizer

tf.train.RMSPropOptimizer

dropout 率的选择

1.

经过交叉验证,隐含节点

dropout

率等于

0.5

的时候效果最好,原因是

0.5

的时候dropout

随机生成的网络结构最多。

2. dropout

也可以被用作一种添加噪声的方法,直接对

input

进行操作。输入层设为更接近1

的数。使得输入变化不会太大(0.8)训练过程

3.

对参数

w

的训练进行球形限制

(max-normalization)

,对

dropout

的训练非常有用。

4.

球形半径

c

是一个需要调整的参数。可以使用验证集进行参数调优

5. dropout

自己虽然也很牛,但是

dropout

、

max-normalization

、

large decaying、learning rates and high momentum 组合起来效果更好,比如

max-norm regularization

就可以防止大的 learning rate

导致的参数

blow up

。

6.

使用

pretraining

方法也可以帮助

dropout

训练参数,在使用

dropout

时,要将所有参数都乘以 1/p

。

775

775

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?