太多了,记得看目录

需要启动的集群:启动HDFS和YARN集群

启动方式:单节点逐个启动 或者 使用脚本一键启动

一、单节点启动、关闭

HDFS进程:

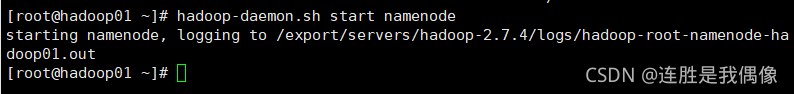

1. 启动HDFS的 namenode

hadoop01中,输入:hadoop-daemon.sh start namenode

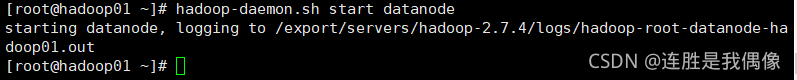

2. 启动HDFS的 datanode

hadoop01中,输入:hadoop-daemon.sh start datanode

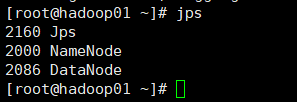

3. 验证启动

hadoop01中,输入:jps

这个命令可以查看和java相关的进程

出现了namenode和datanode就成功了

若启动未成功,转到此文章了解(2条消息) 启动Hadoop集群、启动Hadoop的HDFS失败、namenode启动不了、datanode启动不了、jps后进程只有一个_连胜是我偶像的博客-CSDN博客

4.其他两台主机 不一样设置

只启动 HDFS DataNode进程 --> 验证启动

Hadoop集群管理:启动与关闭HDFS和YARN

Hadoop集群管理:启动与关闭HDFS和YARN

本文详细介绍了如何在单节点和多节点环境下启动、关闭Hadoop HDFS和YARN集群。包括namenode、datanode、resourcemanager、nodemanager及secondarynamenode的启动与验证,以及使用脚本一键启动和关闭的步骤。

本文详细介绍了如何在单节点和多节点环境下启动、关闭Hadoop HDFS和YARN集群。包括namenode、datanode、resourcemanager、nodemanager及secondarynamenode的启动与验证,以及使用脚本一键启动和关闭的步骤。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2414

2414

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?