一、系统环境

os : Ubuntu 16.04 LTS 64bit

jdk : 1.8.0_161

hadoop : 2.6.4

mysql : 5.7.21

hive : 2.1.0

在配置Hive之前,要先配置Hadoop。

二、安装步骤

1、安装并配置MySQL

1.1 安装MySQL

运行 sudo apt-get install mysql-server ,安装mysql,安装过程中会有提示输入登录密码。

启动mysql服务 service mysql start

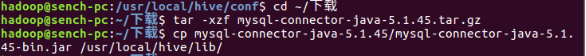

下载mysql-jdbc包,我下载的是mysql-connector-java-5.1.45.tar.gz,然后执行以下操作:

1.2 创建hive用户

以root用户进入MySQL数据库管理系统:

mysql -uroot -proot

创建用户名为hive密码为hive的用户:

create user 'hive' identified by 'hive';

给hive用户赋予操作权限:

grant all privileges on *.* to 'hive'@'localhost' identified by 'hive';

2.3 使用hive用户再在mysql中创建名为hive的数据库

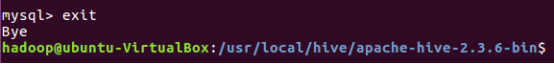

先退出MySQL(root用户身份):

以hive用户进入MySQL数据库管理系统:

mysql -uhive –phive

创建hive数据库:

mysql> create database hive;

2、Hive的安装与配置

2.1 Hive的安装

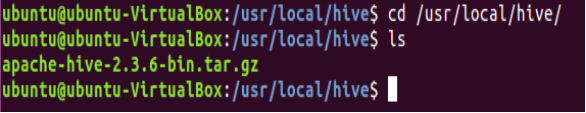

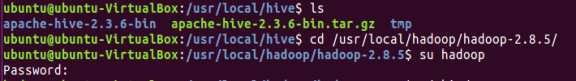

下载hive2.3.6,使用以下命令安装到/usr/local/hive/

解压Hive的安装包apache-hive-2.3.6-bin.tar.gz,操作命令如下:

sudo tar -zxvf apache-hive-2.3.6-bin.tar.gz

给hadoop用户赋值操作权限,操作命令如下:

sudo chown -R hadoop:hadoop ./apache-hive-2.3.6-bin/

说明:最后一条 sudo chown -R hadoop:hadoop ./apache-hive-2.3.6-bin/中的hadoop:hadoop是我的用户名及用户名所属用户组。

2.2 配置环境变量

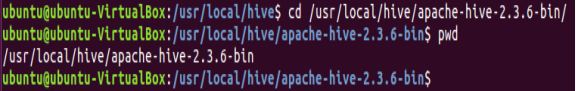

先查询Hive安装的根路径,操作命令如下:

配置Hive的环境变量,操作命令如下:

sudo vim /etc/bash.bashrc

![]()

添加以下代码:

export HIVE_HOME=/usr/local/hive/apache-hive-2.3.6-bin

export HCAT_HOME=$HIVE_HOME/hcatalog

export HIVE_CONF=$HIVE_HOME/conf

export PATH=$PATH:$HIVE_HOME/bin

保存,然后使Hive环境变量生效,操作命令如下:

source /etc/bash.bashrc

2.3 配置hive-site.xml

以下操作默认是再hive安装目录/usr/local/hive/apache-hive-2.3.6-bin下进行,操作命令如下:

进入Hive安装目录:

cd /usr/local/hive/apache-hive-2.3.6-bin/

复制hive-default.xml.template文件更名为hive-site.xml,操作命令如下:

cp ./conf/hive-default.xml.template ./conf/hive-site.xml

然后修改hive-site.xml中的部分内容,将对应的name修改成下面的value:

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/hive?characterEncoding=UTF-8&createDatabaseIfNotExist=true</value>

<description>

JDBC connect string for a JDBC metastore.

To use SSL to encrypt/authenticate the connection, provide database-specific SSL flag in the connection URL.

For example, jdbc:postgresql://myhost/db?ssl=true for postgres database.

</description>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

<description>Driver class name for a JDBC metastore</description>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>hive</value>

<description>Username to use against metastore database</description>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>hive</value>

<description>password to use against metastore database</description>

</property>

将hvie-site.xml中的system:java.io.tmpdir全部替换为/usr/local/hive/tmp,将system:java.io.tmpdir全部替换为/usr/local/hive/tmp,将{system:user.name}全部替换为${user.name}。

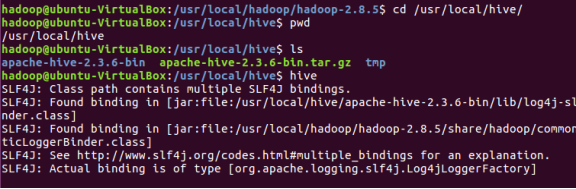

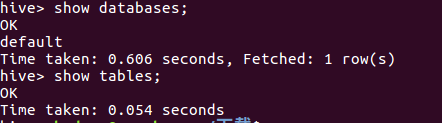

3、启动Hive

启动Hadoop的HDFS服务,操作命令如下:

cd /usr/local/hadoop/hadoop-2.8.5/

切换hadoop用户:

su hadoop

启动Hadoop的HDFS服务:./sbin/start-dfs.sh

![]()

然后进入Hive安装目录,启动Hive服务,操作命令如下:

可能会出现问题

出现此问题的原因是元数据库没有初始化,使用命令

schematool -dbType mysql -initSchema

后再使用命令 $ hive 即可成功进入

参考

本博客文章如无特殊声明,均为作者原创,欢迎转载,但必须在文章明显位置给出原文链接。

941

941

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?