目录

4.小demo:NettyServer & NettyClient

第一部分:原生NIO存在的问题

1. NIO 的类库和 API 繁杂,使用麻烦:

需要熟练掌握 Selector、ServerSocketChannel、SocketChannel、ByteBuffer等。

2. 需要具备其他的额外技能:

要熟悉 Java 多线程编程,因为 NIO 编程涉及到 Reactor 模式,你必须对多线程和网络编程非常熟悉,才能编写出高质量的 NIO 程序。

3. 开发工作量和难度都非常大:

例如客户端面临断连重连、网络闪断、半包读写、失败缓存、网络拥塞和异常流的处理等等。

4. JDK NIO 的 Bug:

臭名昭著的 Epoll Bug,它会导致 Selector 空轮询,最终导致 CPU 100%。直到JDK 1.7版本该问题仍旧存在,没有被根本解决。

在NIO中通过Selector的轮询当前是否有IO事件,根据JDK NIO api描述,Selector的select方

法会一直阻塞,直到IO事件达到或超时,但是在Linux平台上这里有时会出现问题,在某些场

景下select方法会直接返回,即使没有超时并且也没有IO事件到达,这就是著名的epoll bug,这是一个比较严重的bug,它会导致线程陷入死循环,会让CPU飙到100%,极大地影

响系统的可靠性,到目前为止,JDK都没有完全解决这个问题。

第二部分:Netty简介

1.了解netty的用处

1.Netty 是由 JBOSS 提供的一个 Java 开源框架。Netty 提供异步的、基于事件驱动的网络应用程序框架,用以快速开发高性能、高可靠性的网络 IO 程序。

2.Netty 是一个基于 NIO 的网络编程框架,使用Netty 可以帮助你快速、简单的开发出一 个网络应用,相当于简化和流程化了 NIO 的开发过程。

3.Netty作为当前最流行的 NIO 框架,Netty 在互联网领域、大数据分布式计算领域、游戏行业、 通信行业等获得了广泛的应用,知名的 Elasticsearch 、Dubbo 框架内部都采用了 Netty。

2.Netty的优点

1. 设计优雅,提供阻塞和非阻塞的 Socket;

提供灵活可拓展的事件模型;

提供高度可定制的线程模型;

2. 具备更高的性能和更大的吞吐量,使用零拷贝技术最小化不必要的内存复制,减少资源的消耗。

3. 提供安全传输特性。

4. 支持多种主流协议;预置多种编解码功能,支持用户开发私有协议。

Netty 的强大之处:

零拷贝、可拓展事件模型;

支持 TCP、UDP、HTTP、WebSocket 等协议;

提供安全传输、压缩、大文件传输、编解码支持等等。

第三部分:线程模式

一、线程模型基本介绍

1.了解多个线程模型

不同的线程模式,对程序的性能有很大影响,在学习Netty线程模式之前,我们首先来了解一夏各个线程模式, 最后看看 Netty 线程模型有什么优越性.

目前存在的线程模型有:

传统阻塞 I/O 服务模型

单 Reactor 单线程;

单 Reactor 多线程;

主从 Reactor 多线程。

2.传统阻塞 I/O 服务模型

3. Reactor 模型

根据 Reactor 的数量和处理资源池线程的数量不同,有 3 种典型的实现

单 Reactor 单线程;

单 Reactor 多线程;

主从 Reactor 多线程。

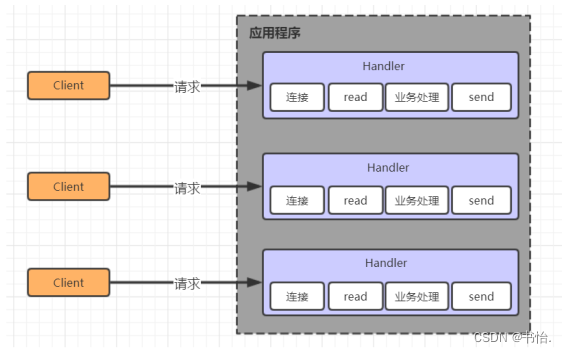

二、传统阻塞I/O服务模型

1.了解传统阻塞I/O服务模型

采用阻塞 IO 模式获取输入的数据, 每个连接都需要独立的线程完成数据的输入 , 业务处理和数据返回工作。

从图中我们可以看到,每一个Client对应一个Handle;意味着每一个请求都需要一个线程完成一套操作。

2.传统阻塞I/O服务模型存在的问题

1. 当并发数很大,就会创建大量的线程,占用很大系统资源;

2. 连接创建后,如果当前线程暂时没有数据可读,该线程会阻塞在 read 操作,造成线程资源浪费。

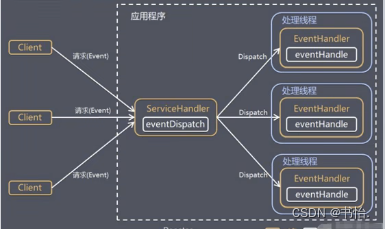

三、Reactor模型

1.了解Reactor模型

1.Reactor模型的介绍

1.Reactor 模式(反应器模式),通过一个或多个输入同时传递给服务处理器的模式 , 服务器端程序处理传入的多个请求,并将它们同步分派到相应的处理线程, 因此 Reactor 模式也叫 Dispatcher模式(分发者模式)。

2.Reactor 模式使用IO 复用监听事件, 收到事件后,分发给某个线程(进程), 这点就是网络服务器高并发处理关键.

2.Reactor的优点

我们可以发现Reactor模式其实是针对于传统阻塞I/O服务模型的做了一些改善:

1>.基于I/O复用模型:

多个连接共用一个阻塞对象,应用程序只需要在一个阻塞对象等待,无需阻塞等待所有的连接;

当某个连接有新的数据可以处理的时候,操作系统会通知应用程序,线程从阻塞状态返回,开始进行业务处理。

2>.基于线程池复用线程资源:

不必再为每个连接创建线程,将连接完成后的业务处理任务分配给线程进行处理,一个线程可以处理多个连接的业务。

3.Reactor整体设计模式

图例:黄色的框框代表对象;蓝色的框框代表线程;白色的框框代表方法(API).

1.Reactor模式,通过一个或者多个输入同时传递给服务处理器的模式(基于事件驱动);

2.服务器端程序处理传入的多个请求,并且将它们同步分派到相应的处理线程;

3.Reactor模式使用IO复用监听事件,收到事件之后,分发给某个线程。

4.Reactor模式中的核心组成

1>.Reactor:

Reactor在一个单独的线程中运行,负责监听和分发时间,分发给适当的处理程序来对IO事件做出反应。(举个例子理解一下下:它其实就像公司的电话接线员,它接听来自客户的电电话并且将线路转移到适当的联系人)

2>.Handlers:

处理程序执行的I/O事件要完成的实际事件,类似于客户想要与之交谈的公司中的实际官员。Reactor通过调度适当的处理程序来相应I/O事件,处理程序执行非阻塞操作。

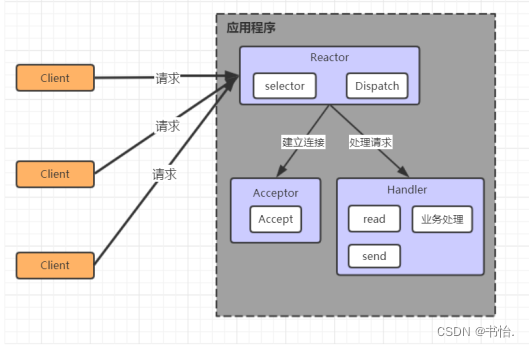

2.单 Reactor 单线程

1.单 Reactor 单线程介绍

可以对比上面一张图,我们就可以发现单Readctor模式比传统的I/O模式效率要高很多*~*

1.Selector是可以实现应用程序通过一个阻塞对象监听多路连接请求;

2.Reactor 对象通过 Selector监控客户端请求事件,收到事件后通过 Dispatch 进行分发;

3.如果是建立连接请求事件,则由 Acceptor 通过 Accept 处理连接请求,然后创建一个 Handler 对象处理连接完成后的后续业务处理;4.如果不是建立连接事件,Reactor会分发调用连接事假对应的Handler来响应;

5.Handler 会完成 Read→业务处理→Send 的完整业务流程 。【nio其实就是属于这种模型】

2.单 Reactor 单线程的优点

优点:模型简单,没有多线程、进程通信、竞争的问题,全部都在一个线程中完成

3.单 Reactor 单线程的缺点

1. 性能问题: 只有一个线程,无法完全发挥多核 CPU 的性能。Handler 在处理某个连接上的业务时,整个进程无法处理其他连接事件,很容易导致性能瓶颈;

2. 可靠性问题: 线程意外终止或者进入死循环,会导致整个系统通信模块不可用,不能接收和处

理外部消息,造成节点故障。

4.使用场景

客户端的数量有限,业务处理非常快速,eg:Redis在业务处理的时间复杂度O(1)的情况。

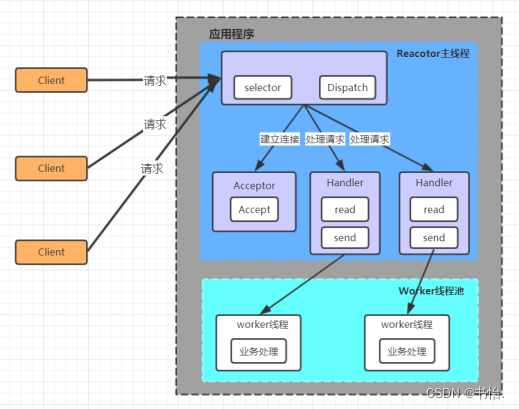

3.单 Reactor多线程

1.了解单 Reactor多线程

1.Reactor 对象通过 selector 监控客户端请求事件, 收到事件后,通过 dispatch 进行分发;

2.如果建立连接请求, 则右 Acceptor 通过accept 处理连接请求,然后创建一个Handler对象处理完成连接后的各种事件;

3.如果不是连接请求,则由 reactor 分发调用连接对应的 handler 来处理;

4.handler 只负责响应事件,不做具体的业务处理, 通过 read 读取数据后,会分发给后面的

worker 线程池的某个线程处理业务;

5.worker 线程池会分配独立线程完成真正的业务,并将结果返回给 handler;

6.handler 收到响应后,通过 send 将结果返回给 client。

我在这里又放了一张图(自我感觉更加清晰一点哈)

2.单 Reactor多线程的优点

可以充分的利用多核 cpu 的处理能力。

3.单 Reactor多线程的缺点

多线程数据共享和访问比较复杂; reactor 处理所有的事件的监听和响应,在单线程运行, 在

高并发场景容易出现性能瓶颈。

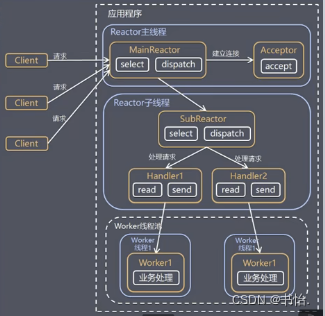

4.主从 Reactor 多线程

1.了解主从 Reactor 多线程

1.Reactor 主线程 MainReactor 对象通过 select 监听客户端连接事件,收到事件后,通过

Acceptor 处理客户端连接事件;

2.当 Acceptor 处理完客户端连接事件之后(与客户端建立好 Socket 连接),MainReactor 将连接分配给 SubReactor。(即:MainReactor 只负责监听客户端连接请求,和客户端建立连接之后将连接交由 SubReactor 监听后面的 IO 事件。)

3.SubReactor 将连接加入到自己的连接队列进行监听,并创建 Handler 对各种事件进行处理;

4.当连接上有新事件发生的时候,SubReactor 就会调用对应的 Handler 处理;

5.Handler 通过 read 从连接上读取请求数据,将请求数据分发给 Worker 线程池进行业务处理;

6.Worker 线程池会分配独立线程来完成真正的业务处理,并将处理结果返回给 Handler。

Handler 通过 send 向客户端发送响应数据;

7.一个 MainReactor 可以对应多个 SubReactor,即一个 MainReactor 线程可以对应多个

SubReactor 线程 。

图片上面的只显示了一个SubReactor,实际上有多个(这就是Reactor在多线程中运行)

2.主从 Reactor 多线程的优点

1. MainReactor 线程与 SubReactor 线程的数据交互简单职责明确,MainReactor 线程只需要

接收新连接,SubReactor 线程完成后续的业务处理;

2. MainReactor 线程与 SubReactor 线程的数据交互简单, MainReactor 线程只需要把新连接

传给 SubReactor 线程,SubReactor 线程无需返回数据;

3. 多个 SubReactor 线程能够应对更高的并发请求。

3.主从 Reactor 多线程的缺点

这种模式的缺点是编程复杂度较高。

但是由于其优点明显,在许多项目中被广泛使用,包括Nginx、Memcached、Netty 等。这种模式也被叫做服务器的 1+M+N 线程模式,即使用该模式开发的服务器包含一个(或多个,1 只是表示相对较少)连接建立线程+M 个 IO 线程+N 个业务处理线程。这是业界成熟的服务器程序设计模式。

5.Reactor模式小结一下

1. 3种模型的实例化理解

1>.单Reactor单线程,前台接待员和服务员是同一个人,全程为顾客服务;

2>.单Reactor多线程,一个前台接待员,多个服务员,接待员只负责接待;

3>.主从Reactor多线程,多个前台接待员,多个服务员。

2. Reactor模式的总体优点

1、响应快,不必为单个同步时间所阻塞,虽然Reactor本身依然是同步的;

2、可以最大程度的避免复杂的多线程以及同步问题,并且避免了多线程的切换开销;

3、扩展性好,可以方便的通过增加Reactor实例个数来充分利用cpu资源;

4、复用性好,Reactor模型本身与具体事件处理逻辑没有关系,具有很高的复用性。

四、Netty线程模式

Netty 的设计主要基于主从 Reactor 多线程模式,并做了一定的改进。

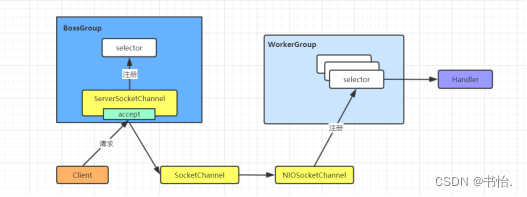

1.简单版Netty模型

1. BossGroup 线程维护 Selector,ServerSocketChannel 注册到这个 Selector 上,只关注连接建立请求事件(主 Reactor);

2.当接收到来自客户端的连接建立请求事件的时候,通过 ServerSocketChannel.accept 方法获得对应的 SocketChannel,并封装成 NioSocketChannel 注册到 WorkerGroup 线程中的

Selector,每个 Selector 运行在一个线程中(从 Reactor);

3.当 WorkerGroup 线程中的 Selector 监听到自己感兴趣的 IO 事件后,就调用 Handler 进行

处理。【handle已将加入到通道了】

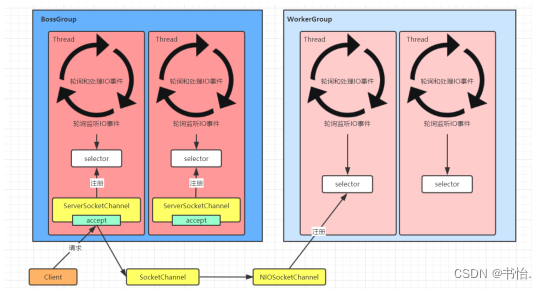

2. 进阶版Netty模型

1.有两组线程池:BossGroup 和 WorkerGroup,BossGroup 中的线程专门负责和客户端建立连接,WorkerGroup 中的线程专门负责处理连接上的读写;

2.BossGroup 和 WorkerGroup 含有多个不断循环的执行事件处理的线程,每个线程都包含一个 Selector,用于监听注册在其上的 Channel;

3.每个 BossGroup 中的线程循环执行以下三个步骤:

①轮训注册在其上的 ServerSocketChannel 的 accept 事件(OP_ACCEPT 事件);

②处理 accept 事件,与客户端建立连接,生成一个 NioSocketChannel,并将其注册 WorkerGroup 中某个线程上的 Selector 上;

③再去以此循环处理任务队列中的下一个事件。

4.每个 WorkerGroup 中的线程循环执行以下三个步骤:①轮训注册在其上的 NioSocketChannel 的 read/write 事件(OP_READ/OP_WRITE 事件);

②在对应的 NioSocketChannel 上处理 read/write 事件;

③再去以此循环处理任务队列中的下一个事件。

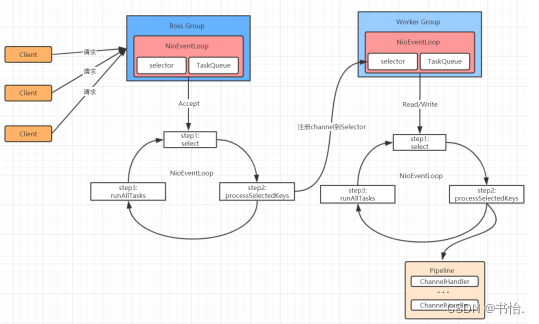

3. 详细版Netty模型

1.Netty 抽象出两组线程池:BossGroup 和 WorkerGroup,

也可以叫作BossNioEventLoopGroup 和 WorkerNioEventLoopGroup。

每个线程池中都有NioEventLoop 线程。

BossGroup 中的线程专门负责和客户端建立连接;

WorkerGroup 中的线程专门负责处理连接上的读写。

BossGroup 和 WorkerGroup 的类型都是NioEventLoopGroup;

2、NioEventLoopGroup 相当于一个事件循环组,这个组中含有多个事件循环,每个事件循环就是一个 NioEventLoop;

3、NioEventLoop 表示一个不断循环的执行事件处理任务的线程,每个 NioEventLoop 都包含一个Selector,用于监听注册在其上的 Socket 网络连接(Channel);

4、NioEventLoopGroup 可以含有多个线程,即可以含有多个 NioEventLoop,

每个 BossNioEventLoop 中循环执行以下三个步骤:

①select:轮训注册在其上的 ServerSocketChannel 的 accept 事件(OP_ACCEPT 事件);

②processSelectedKeys:处理 accept 事件,与客户端建立连接,生成一个 NioSocketChannel,并将其注册到某个 WorkerNioEventLoop 上的 Selector 上;

③runAllTasks:再去以此循环处理任务队列中的其他任务。

5、每个 WorkerNioEventLoop 中循环执行以下三个步骤:

①select:轮训注册在其上的 NioSocketChannel 的 read/write 事件

(OP_READ/OP_WRITE 事件);

②processSelectedKeys:在对应的 NioSocketChannel 上处理 read/write 事件;

③runAllTasks:再去以此循环处理任务队列中的其他任务。

6.在以上两个processSelectedKeys步骤中,会使用 Pipeline(管道),Pipeline 中引用了

Channel,即通过 Pipeline 可以获取到对应的 Channel,Pipeline 中维护了很多的处理器

(拦截处理器、过滤处理器、自定义处理器等)。

4.小demo:NettyServer & NettyClient

【NettyServer】

package java3netty.temp.temp1;

import io.netty.bootstrap.ServerBootstrap;

import io.netty.channel.ChannelFuture;

import io.netty.channel.ChannelInitializer;

import io.netty.channel.ChannelOption;

import io.netty.channel.nio.NioEventLoopGroup;

import io.netty.channel.socket.nio.NioServerSocketChannel;

import io.netty.channel.socket.SocketChannel;

import java.io.IOException;

public class NettyServer {

public static void main(String[] args) throws IOException ,InterruptedException{

//创建BossGroup和WorkGroup

//说明

//1.创建两个线程组bossGroup和workerGroup

//2.bossGroup只是处理连接请求,真正的和客户端业务处理,会交给workerGroup完成

//3.两个都是无限循环

NioEventLoopGroup bossGroup = new NioEventLoopGroup();

NioEventLoopGroup workerGroup = new NioEventLoopGroup();

try {

//创建服务器端启动的对象,配置参数

ServerBootstrap bootstrap = new ServerBootstrap();

//使用链式编程来进行设置

bootstrap.group(bossGroup, workerGroup) //设置两个线程组

.channel(NioServerSocketChannel.class) //使用NioSocketChannel作为服务器的通道实现

.option(ChannelOption.SO_BACKLOG, 128) //设置线程队列得到的连接数

.childOption(ChannelOption.SO_KEEPALIVE, true) //设置保持活动的连接状态

.childHandler(new ChannelInitializer<SocketChannel>() { //创建一个通道测试对象(匿名对象)

//给pipeline设置处理器

@Override

protected void initChannel(SocketChannel ch) throws Exception {

ch.pipeline().addLast(new NettyServerHandler());

}

}); //给workerGroup的EventLoop对应的管道设置处理器

System.out.println("服务器启动好了......");

//绑定一个端口并且同步,生成一个ChannelFuture对象

//启动服务器(并且绑定端口)

ChannelFuture cf = bootstrap.bind(6686).sync();

//对关闭通道进行监听

cf.channel().closeFuture().sync();

}finally{

bossGroup.shutdownGracefully();

workerGroup.shutdownGracefully();

}

}

}

【NettyServerHandler】

package java3netty.temp.temp1;

import io.netty.buffer.ByteBuf;

import io.netty.buffer.Unpooled;

import io.netty.channel.ChannelHandlerContext;

import io.netty.channel.ChannelInboundHandlerAdapter;

import io.netty.util.CharsetUtil;

import java.nio.charset.StandardCharsets;

/**

* 说明:

* 1.自定义一个handler,需要继承netty规定好的某个HandlerAdapter(适配器)

* 2.这个时候我们自定义的一个Handler,才能称为一个handler

*/

public class NettyServerHandler extends ChannelInboundHandlerAdapter {

//读取数据事件(可以读取客户端发送的消息)

//1.ChannelHandlerContext ctx :上下文对象,含有的信息有:管道pipeline,通道channel(主要是数据的读写),地址

//2. Object msg :客户端发送的数据,默认是object

@Override

public void channelRead(ChannelHandlerContext ctx, Object msg) throws Exception {

//super.channelRead(ctx, msg);

System.out.println("server ctx =" + ctx);

//将msg转成一个ByteBuf

//ByteBuf 是Netty提供的,不是Nio的ByteBuffer

ByteBuf buf =(ByteBuf) msg;

System.out.println("客户端发送的消息是:" + buf.toString(CharsetUtil.UTF_8));

System.out.println("客户端地址:" + ctx.channel().remoteAddress());

}

//数据读取完毕

@Override

public void channelReadComplete(ChannelHandlerContext ctx) throws Exception {

//writeAndFlush是write + flush

//将数据写入到缓存,并且刷新

//一般情况,要对发送的数据进行编码

ctx.writeAndFlush(Unpooled.copiedBuffer("hello,客户端".getBytes(StandardCharsets.UTF_8)));

}

//处理异常,一般是需要关闭通道

@Override

public void exceptionCaught(ChannelHandlerContext ctx, Throwable cause) throws Exception {

ctx.close();

}

}

【NettyClient】

package java3netty.temp.temp1;

import io.netty.bootstrap.Bootstrap;

import io.netty.channel.ChannelFuture;

import io.netty.channel.ChannelInitializer;

import io.netty.channel.nio.NioEventLoopGroup;

import io.netty.channel.socket.SocketChannel;

import io.netty.channel.socket.nio.NioSocketChannel;

public class NettyClient {

public static void main(String[] args) throws Exception{

//客户端需要一个事件循环组

NioEventLoopGroup group = new NioEventLoopGroup();

try {

//创建客户端启动对象

//注意客户端使用的不是ServerBootstrap,而是Bootstrap

Bootstrap bootstrap = new Bootstrap();

bootstrap.group(group) //设置线程组

.channel(NioSocketChannel.class) //设置客户端通道的实现类

.handler(new ChannelInitializer<SocketChannel>() {

@Override

protected void initChannel(SocketChannel ch) throws Exception {

ch.pipeline().addLast(new NettyClientHandler()); //加入自己的处理器

}

});

System.out.println("客户端 ok.....");

//启动客户端取连接服务端

//关于ChannelFuture需要分析:涉及netty的异步模型

ChannelFuture channelFuture = bootstrap.connect("127.0.0.1", 6686).sync();

//给关闭通道增加一个连接进行监听

channelFuture.channel().closeFuture().sync();

}finally{

group.shutdownGracefully();

}

}

}【NettyClientHandler】

package java3netty.temp.temp1;

import io.netty.buffer.ByteBuf;

import io.netty.buffer.Unpooled;

import io.netty.channel.ChannelHandlerContext;

import io.netty.channel.ChannelInboundHandler;

import io.netty.channel.ChannelInboundHandlerAdapter;

import io.netty.util.CharsetUtil;

import java.sql.SQLOutput;

public class NettyClientHandler extends ChannelInboundHandlerAdapter {

//当通道就绪的时候,就会触发该方法

@Override

public void channelActive(ChannelHandlerContext ctx) throws Exception {

System.out.println("client " + ctx);

ctx.writeAndFlush(Unpooled.copiedBuffer("hello,server:hahaha", CharsetUtil.UTF_8));

}

//当通道有读取事件时,就会触发

@Override

public void channelRead(ChannelHandlerContext ctx, Object msg) throws Exception {

ByteBuf buf =(ByteBuf) msg;

System.out.println("服务器回复的消息:" + buf.toString(CharsetUtil.UTF_8));

System.out.println("服务器的地址: " + ctx.channel().remoteAddress());

}

//异常处理

@Override

public void exceptionCaught(ChannelHandlerContext ctx, Throwable cause) throws Exception {

cause.printStackTrace(); //打印错误信息

ctx.close();

}

}

749

749

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?