前言 😋

大家早好、午好、晚好吖~

猫咪这种生物,你经常在广大平台上刷到,在同事、朋友那里看到~

这么可爱得东西,一下就激起了你的rua毛冲动,甚至还想自己养一只

那么今天我们就来采集一下猫咪数据并做个数据可视化~~

GOGOGO!!!出发~

环境介绍:

-

python 3.6

-

pycharm

模块

采集部分使用模块:

-

csv

-

requests >>> pip install requests

-

parsel

数据可视化使用模块:

-

pyecharts

-

pandas

如果安装python第三方模块:

-

win + R 输入 cmd 点击确定, 输入安装命令 pip install 模块名 (pip install requests) 回车

-

在pycharm中点击Terminal(终端) 输入安装命令

+python安装包 安装教程视频

+pycharm 社区版 专业版 及 激活码免费 找助理小姐姐 V : python10010免费领

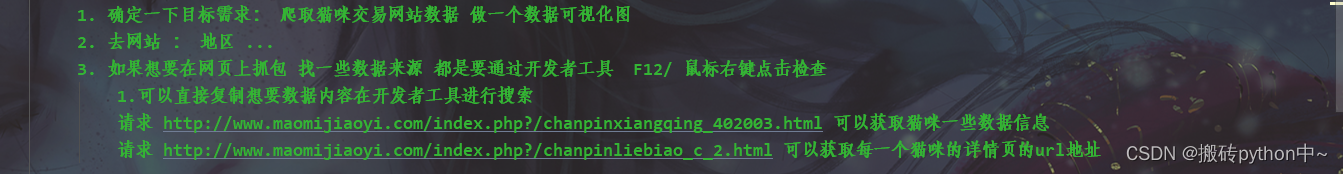

本次的案例流程思路:

一. 网站数据来源查询:

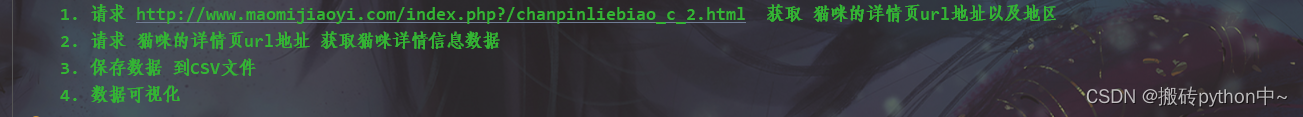

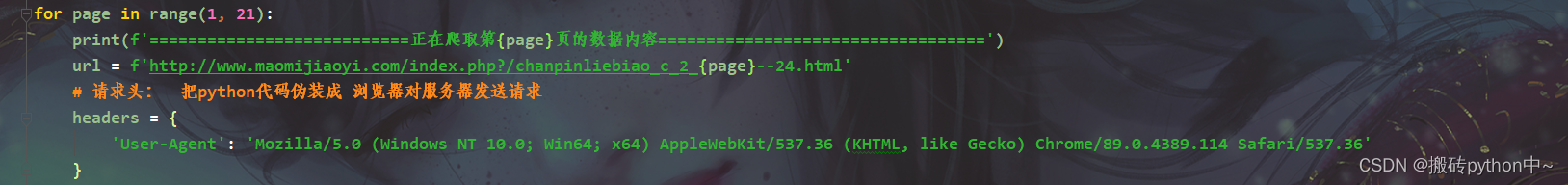

二. 代码实现步骤

采集代码

导入模块

import requests # 第三方模块 需要 pip install requests 发送请求

import parsel # 解析模块 pip install parsel

import csv # 内置模块 不需要大家安装

f = open('猫咪.csv', mode='a', encoding='utf-8', newline='')

csv_writer = csv.DictWriter(f, fieldnames=['地区', '店名', '标题', '价格', '浏览次数', '卖家承诺', '在售只数',

'年龄', '品种', '预防', '联系人', '联系方式', '异地运费', '是否纯种',

'猫咪性别', '驱虫情况', '能否视频', '详情页'])

# 写入表头

csv_writer.writeheader()

response = requests.get(url=url, headers=headers)

# 获取网页的文本数据 response.text json() 获取json字典数据

# print(response.text)

# 解析数据 获取 猫咪的详情页url地址以及地区

# 1. 要把 网页文本数据转换成 parsel 解析的 对象

selector = parsel.Selector(response.text)

# css选择器: 根据标签提取数据内容

href = selector.css('div.content:nth-child(1) a::attr(href)').getall()

# getall() 返回的是列表 get() 是返回的字符串

areas = selector.css('div.content:nth-child(1) .area .color_333::text').getall()

# 列表推导式

areas = [i.strip() for i in areas]

# get() 取一个 返回是字符串 strip() 字符串的方法

title = selector_1.css('.detail_text .title::text').get().strip() # 标题

shop = selector_1.css('.dinming::text').get().strip() # 店名

price = selector_1.css('.info1 div:nth-child(1) span.red.size_24::text').get() # 价格

views = selector_1.css('.info1 div:nth-child(1) span:nth-child(4)::text').get() # 浏览次数

# replace() 替换

promise = selector_1.css('.info1 div:nth-child(2) span::text').get().replace('卖家承诺: ', '') # 浏览次数

num = selector_1.css('.info2 div:nth-child(1) div.red::text').get() # 在售只数

age = selector_1.css('.info2 div:nth-child(2) div.red::text').get() # 年龄

kind = selector_1.css('.info2 div:nth-child(3) div.red::text').get() # 品种

prevention = selector_1.css('.info2 div:nth-child(4) div.red::text').get() # 预防

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

776

776

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?