优化和深度学习

对于深度学习问题,我们通常会先定义损失函数。一旦有了损失函数,就可以使用优化算法来尝试最小化损失。在优化中,损失函数通常被称为优化问题的目标函数。按照传统惯例,大多数优化算法都关注的是最小化。

优化的目标

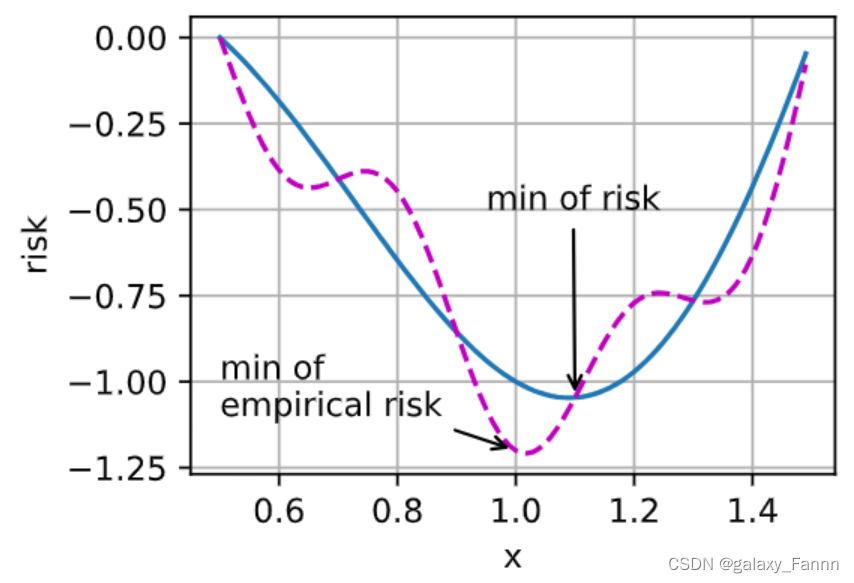

尽管优化提供了一种最大限度地减少深度学习损失函数的方法,但本质上,优化和深度学习的目标是根本不同的。前者主要关注的是最小化目标,后者则关注在给定有限数据量的情况下寻找合适的模型。例如,训练误差和泛化误差通常不同:由于优化算法的目标函数通常是基于训练数据集的损失函数,因此优化的目标是减少训练误差。但是,深度学习(或更广义地说,统计推断)的目标是减少泛化误差。为了实现后者,除了使用优化算法来减少训练误差之外,我们还需要注意过拟合。

%matplotlib inline

import numpy as np

import torch

from mpl_toolkits import mplot3d

from d2l import torch as d2l

为了说明上述不同的目标,引入两个概念风险和经验风险。经验风险是训练数据集的平均损失,而风险则是整个数据群的预期损失。下面我们定义了两个函数:风险函数f和经验风险函数g。假设我们只有有限的训练数据。因此,这里的g不如f平滑。

def f(x):

return x * torch.cos(np.pi * x)

def g(x):

return f(x) + 0.2 * torch.cos(5 * np.pi * x)

下图说明,训练数据集的最低经验风险可能与最低风险(泛化误差)不同。

def annotate(text, xy, xytext): #@save

d2l.plt.gca().annotate(text, xy=xy, xytext=xytext,

arrowprops=dict(arrowstyle='->'))

x = torch.arange(0.5, 1.5, 0.01)

d2l.set_figsize((4.5, 2.5))

d2l.plot(x, [f(x), g(x)], 'x', 'risk')

annotate('min of\nempirical risk', (1.0, -1.2), (0.5, -1.1))

annotate('min of risk', (1.1, -1.05), (0.95, -0.5))

深度学习中的优化挑战

本章将关注优化算法在最小化目标函数方面的性能,而不是模型的泛化误差。在 :numref:sec_linear_regression中,我们区分了优化问题中的解析解和数值解。在深度学习中,大多数目标函数都很复杂,没有解析解。相反,我们必须使用数值优化算法。本章中的优化算法都属于此类别。

深度学习优化存在许多挑战。其中最令人烦恼的是局部最小值、鞍点和梯度消失。

局部最小值

对于任何目标函数 f ( x ) f(x) f(x),如果在 x x x

文章探讨了深度学习中优化算法如何处理复杂目标函数,强调了区别于优化目标的深度学习目标是泛化误差而非训练误差。文章介绍了局部最小值、鞍点和梯度消失作为优化过程中的关键挑战,以及这些现象在高维空间中的表现和解决策略。

文章探讨了深度学习中优化算法如何处理复杂目标函数,强调了区别于优化目标的深度学习目标是泛化误差而非训练误差。文章介绍了局部最小值、鞍点和梯度消失作为优化过程中的关键挑战,以及这些现象在高维空间中的表现和解决策略。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1621

1621

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?