注:只是完成了网络模型的搭建

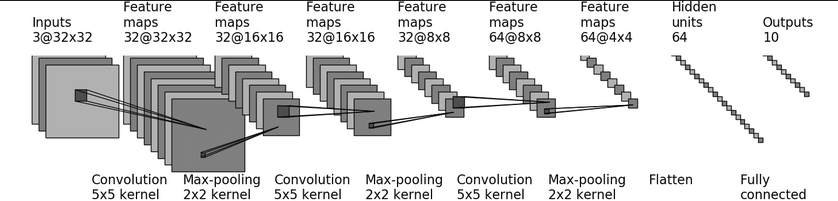

神经网络模型如下:

输入为为3通道,32*32尺寸的CIFA10数据集的图,最后输出为10,也就是完成10个分类

卷积层padding和stride的取值:

官方文档的计算公式如下

以第一层卷积为例:

法一:

根据第一个公式,已知Hout = 32, Hin = 32,dilation = 1, kernel_size = 5,取stride = 1,可以计算出padding = 2。

法二:

根据卷积的原理,大小为5的卷积核,怎么样改变原图的hw才能卷积出同样hw的输出图,其实就是要让卷积核的中心经过原输入图像矩阵的每一个数据,把卷积核的中心放到图像的边缘会发现h和w都高出2格,那么只要hw各填充2格就可以了

代码如下:

import torch

from torch import nn

from torch.nn import Conv2d, MaxPool2d, Flatten, Linear

from torch.utils.tensorboard import SummaryWriter

class model(nn.Module):

def __init__(self):

super().__init__()

self.model = nn.Sequential(

Conv2d(3, 32, 5, 1, 2),

MaxPool2d(2),

Conv2d(32, 32, 5, 1, 2),

MaxPool2d(2),

Conv2d(32, 64, 5, 1, 2),

MaxPool2d(2),

Flatten(),

Linear(1024, 64),

Linear(64, 10)

)

def forward(self, x):

x = self.model(x)

return x这样就完成了

model = model()

print(model)model(

(model): Sequential(

(0): Conv2d(3, 32, kernel_size=(5, 5), stride=(1, 1), padding=(2, 2))

(1): MaxPool2d(kernel_size=2, stride=2, padding=0, dilation=1, ceil_mode=False)

(2): Conv2d(32, 32, kernel_size=(5, 5), stride=(1, 1), padding=(2, 2))

(3): MaxPool2d(kernel_size=2, stride=2, padding=0, dilation=1, ceil_mode=False)

(4): Conv2d(32, 64, kernel_size=(5, 5), stride=(1, 1), padding=(2, 2))

(5): MaxPool2d(kernel_size=2, stride=2, padding=0, dilation=1, ceil_mode=False)

(6): Flatten(start_dim=1, end_dim=-1)

(7): Linear(in_features=1024, out_features=64, bias=True)

(8): Linear(in_features=64, out_features=10, bias=True)

)

)这就是模型的全部层

验证一下:

input = torch.ones(1, 3, 32, 32)

output = model(input)

print(output.shape)torch.Size([1, 10])可以看到3*32*32的输入的确变成了10(这里取batch-size为1为了简单验证而已)

另外我们在TensorBoard可以看到整个网络的图

writer = SummaryWriter("log")

writer.add_graph(model, input)

writer.close()add_graph第一个参数为模型对象,第二个为输入

进去之后看到就是这样

我们可以不断展开,看看里面的具体情况,你甚至可以看到具体的参数的传递

看看其中两层吧

2420

2420

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?