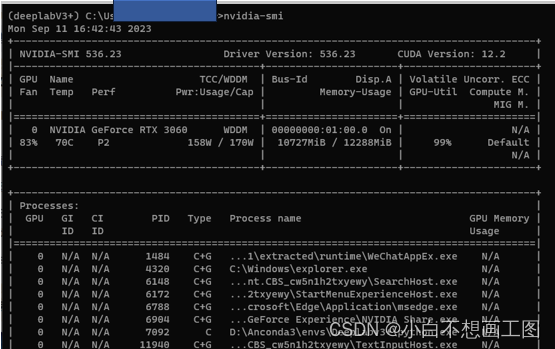

记录我的第一次爆显存

跑了个语义分割的数据集设置同样的batch_size,在Deeplabv3+上跑没问题;到unet网络上就显存不够了

对于UNet模型而言,它在一些情况下可能会占用较大的内存。UNet是一种用于图像分割任务的卷积神经网络架构,它具有多层的编码器-解码器结构和跳跃连接,以捕捉不同尺度的特征信息。由于其架构的复杂性,UNet模型可能需要更多的内存来存储网络参数和中间特征图。

此外,UNet在训练和推理过程中可能会生成大量的中间特征图,这也会占用更多的内存空间。特别是当输入图像的分辨率较大或批次大小较大时,内存占用可能会增加。

为了减少内存占用,可以考虑以下几个方法:

1.减小模型规模:可以通过减少网络层数或通道数来降低模型的内存占用。

2.降低输入图像分辨率:通过将输入图像缩小到较小的尺寸,可以减少模型所需的内存空间。

3.减小批次大小:如果内存不足以处理大批量的图像,可以尝试减小批次大小以减少内存占用。

深度学习任务需要处理大量的数据和计算时,可能会遇到显存不足的问题。以下是一些解决方法:

1. 减少批处理大小: 减少每个批次需要处理的数据量,可以减少显存的使用。但这也可能会降低模型的准确度和稳定性。

2. 减小模型规模:尝试减小模型的规模,减轻显存负担。可以使用一些剪枝技术或者使用模型压缩算法来减小模型规模。

3. 使用显存更大的GPU: 如果你的深度学习任务需要处理大量的数据和计算,那么考虑使用显存更大的GPU,例如 NVIDIA Tesla V100 或者 AMD Radeon VII。

4. 使用分布式训练:使用多台计算机和GPU进行分布式训练,可以将显存的负担分摊到多个节点上,提高训练效率。

5. 优化代码和模型: 对代码和模型进行优化,可以减小显存的使用。例如,使用低精度浮点数进行计算,或者将模型和数据存储在CPU和GPU之间进行交换,以减少GPU的负担。

总之,显存不足问题的解决方法取决于你的具体情况。需要根据实际情况,选择最合适的方法来解决问题。

对此,我把批处理batch_size调小了果然没问题了

503

503

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?