前言

实时读取本地文件和目录到HDFS的意义在于:

- 数据集中存储

HDFS提供高可用、分布式的文件系统,使得本地数据可以在集群中集中存储,方便管理。 - 提高处理效率

HDFS支持并行处理,通过将数据存储在HDFS上,可以加快数据处理速度。 - 满足实时性需求

对于需要实时分析的场景,如日志监控,实时上传数据到HDFS可确保及时响应。 - 数据备份与容灾

HDFS的副本策略和容错机制有助于保护数据的安全性和可靠性。 - 跨平台与扩展性

HDFS跨平台运行,并随着集群规模的扩大而自动调整。

实时读取本地文件到HDFS

创建配置文件: vi flume-hdfs.conf

# Name the components on this agent

a2.sources = r2

a2.sinks = k2

a2.channels = c2

# Describe/configure the source

a2.sources.r2.type = exec

a2.sources.r2.command = tail -F /usr/local/src/hadoop/logs/hadoop-root-datanode-master.log

a2.sources.r2.shell = /bin/bash -c

# Describe the sink

a2.sinks.k2.type = hdfs

a2.sinks.k2.hdfs.path = hdfs://master:8020/flume/%Y%m%d/%H

#上传文件的前缀

a2.sinks.k2.hdfs.filePrefix = logs-

#是否按照时间滚动文件夹

a2.sinks.k2.hdfs.round = true

#多少时间单位创建一个新的文件夹

a2.sinks.k2.hdfs.roundValue = 1

#重新定义时间单位

a2.sinks.k2.hdfs.roundUnit = hour

#是否使用本地时间戳

a2.sinks.k2.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a2.sinks.k2.hdfs.batchSize = 1000

#设置文件类型,可支持压缩

a2.sinks.k2.hdfs.fileType = DataStream

#多久生成一个新的文件

a2.sinks.k2.hdfs.rollInterval = 600

#设置每个文件的滚动大小

a2.sinks.k2.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a2.sinks.k2.hdfs.rollCount = 0

#最小冗余数

a2.sinks.k2.hdfs.minBlockReplicas = 1

# Use a channel which buffers events in memory

a2.channels.c2.type = memory

a2.channels.c2.capacity = 1000

a2.channels.c2.transactionCapacity = 1000

# Bind the source and sink to the channel

a2.sources.r2.channels = c2

a2.sinks.k2.channel = c2

启动flume配置文件

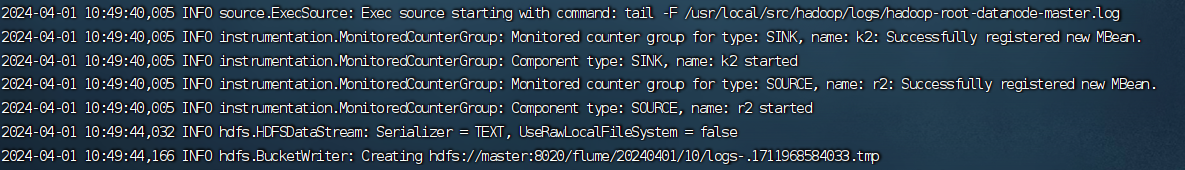

flume-ng agent -n a2 -f /usr/local/src/flume/conf/flume-hdfs.conf -Dflume.root.logger=INFO,console

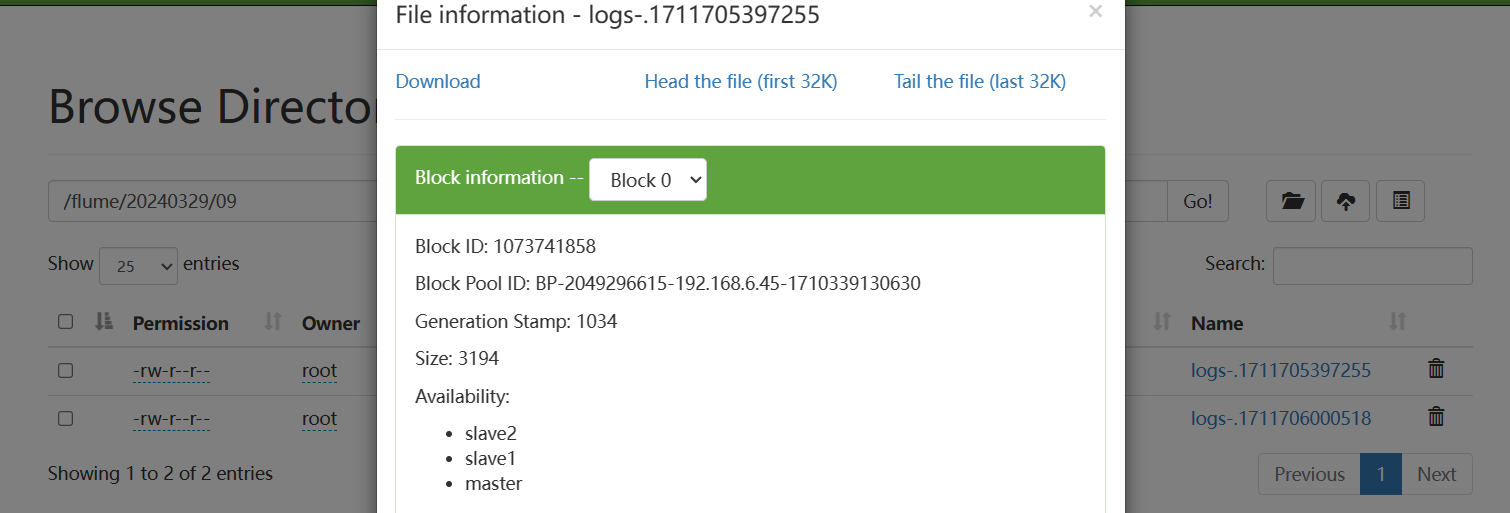

查看结果

实时读取本地目录到HDFS

创建配置文件: vi flume-n.conf

a2.sources = r2

a2.sinks = k2

a2.channels = c2

# Describe/configure the source

a2.sources.r2.type = spooldir

a2.sources.r2.spoolDir = /usr/local/upload

a2.sources.r2.fileSuffix = .COMPLETED

a2.sources.r2.fileHeader = true

#忽略所有以.tmp结尾的文件,不上传

a2.sources.r2.ignorePattern = ([^ ]*\.tmp)

# Describe the sink

a2.sinks.k2.type = hdfs

a2.sinks.k2.hdfs.path = hdfs://master:8020/flume/upload/%Y%m%d/%H

#上传文件的前缀

a2.sinks.k2.hdfs.filePrefix = upload-

#是否按照时间滚动文件夹

a2.sinks.k2.hdfs.round = true

#多少时间单位创建一个新的文件夹

a2.sinks.k2.hdfs.roundValue = 1

#重新定义时间单位

a2.sinks.k2.hdfs.roundUnit = hour

#是否使用本地时间戳

a2.sinks.k2.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a2.sinks.k2.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a2.sinks.k2.hdfs.fileType = DataStream

#多久生成一个新的文件

a2.sinks.k2.hdfs.rollInterval = 600

#设置每个文件的滚动大小大概是128M

a2.sinks.k2.hdfs.rollSize = 124217700

#文件的滚动与Event数量无关

a2.sinks.k2.hdfs.rollCount = 0

#最小冗余数

a2.sinks.k2.hdfs.minBlockReplicas = 1

# Use a channel which buffers events in memory

a2.channels.c2.type = memory

a2.channels.c2.capacity = 1000

a2.channels.c2.transactionCapacity = 1000

# Bind the source and sink to the channel

a2.sources.r2.channels = c2

a2.sinks.k2.channel = c2

启动flume配置文件

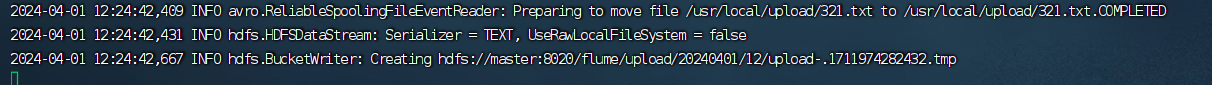

flume-ng agent -n a2 -f /usr/local/src/flume/conf/flume-n.conf -Dflume.root.logger=INFO,console

到HDFS中查看结果

总结

综上所述,实时读取本地数据到HDFS有助于实现数据的高效存储、处理、备份和跨平台扩展,对构建分布式数据处理系统具有重要意义。

1688

1688

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?