之前开发spark程序,一般会使用java作为开发语言,主要是由于惯性,对于java的那一套比较熟悉,不愿意去接触scala这一套东西,但是最近发现很多示例程序都是以scala写的,因此,未雨绸缪,早做些scala方面的了解。

先说些环境方面的准备及概念上理解的误区。

- 目前开发在mac平台上使用intellij idea的比较多。因此我也主要以idea为开发工具,其集成了maven,sbt,scala等接下来需要使用的插件,功能齐全。当然,专业版会比社区版本多很多功能,此处不在列举各插件的安装过程。

- 在了解scala时,注意到它和java能互相调用,非常方便,就产生了误区,两者没有区别都是字节码,可以随意编译执行。因此在我第一次打包产生scala-test.jar后,就愚蠢的去执行

java -cp scala-test.jar com.yuanye.Hello

这里就需要一个概念,scala执行使用的是scala的解释器,java执行使用的是java的解释器,虽然都是基于JVM,但是有所不同。因此,你只能这样执行scala -cp scala-test.jar com.yuanye.Hello,此时,Hello是Hello.scala文件中的Object Hello,其必须有主函数(静态)main。示例代码如下:

package com.yuanye

/**

* Created by yuanye8 on 2016/11/15.

*/

object Hello {

def main(args: Array[String]): Unit = {

println("hello,world.")

}

}若在java中调用了scala的类,才可以使用java -cp scala-test.jar com.yuanye.Hello,此时,Hello是Hello.java中的public类,其内包含入口函数main。java和scala代码分别如下:

scala代码

package com.yuanye.scala

/**

* Created by yuanye8 on 2016/11/15.

*/

class Hello {

def say(): Unit = {

println("hello,world.")

}

}java代码

import com.yuanye.Hello;

/**

* Created by yuanye8 on 2016/11/15.

*/

public class Entry {

public static void main(String[] args) {

Hello h = new Hello();

h.say();

}

}若非要使用java命令执行纯scala语言编写编译的jar包(即相当于直接执行.scala文件编译后的.class文件),需要添加scala-library.lib才可以实现。

java -cp scala-test.jar:.:/usr/local/share/scala/lib/scala-library.jar com.yuanye.Hello

由此再一次确定,java命令是无法直接执行.scala文件编译后产生的.class文件的,必须有scala对应的lib包进行辅助才可以实现,scalac编译后的.class文件和javac编译后的.class文件是有差异的,scala -cp scala-test.jar com.yuanye.Hello能够执行成功,也应该是利用了scala-library.jar实现的。此处涉及到很多JVM的知识,暂且不去深究。

因此,scala有自己的一套打包机制,不能简单的像java项目一样进行打包。主流有两种完善的打包、包依赖管理工具:

1.使用maven进行处理编译打包,需要在build组件中添加scala编译相关插件。如下:

<plugins>

<plugin>

<groupId>org.scala-tools</groupId>

<artifactId>maven-scala-plugin</artifactId>

<version>2.15.2</version>

<executions>

<execution>

<goals>

<goal>compile</goal>

<goal>testCompile</goal>

</goals>

<configuration>

<args>

<arg>-dependencyfile</arg>

<arg>${project.build.directory}/.scala_dependencies</arg>

</args>

</configuration>

</execution>

</executions>

</plugin>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-surefire-plugin</artifactId>

<version>2.10</version>

<configuration>

<useFile>false</useFile>

<disableXmlReport>true</disableXmlReport>

<!-- If you have classpath issue like NoDefClassError,... -->

<!-- useManifestOnlyJar>false</useManifestOnlyJar -->

<includes>

<include>**/*Test.*</include>

<include>**/*Suite.*</include>

</includes>

</configuration>

</plugin>

</plugins>2.使用sbt进行打包,需要先安装sbt工具,mac可以用brew install sbt进行安装,安装完成后,在idea中利用sbt插件可以直接创建sbt项目,之后使用sbt的compile, package命令可以编译打包。

了解了上述知识后,采用scala语言编写spark应用程序WordCount,并分别用maven和sbt工具进行编译打包,流程如下。

一、 使用maven进行打包

1.创建maven项目,配置pom.xml文件如下:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.yuanye</groupId>

<artifactId>spark-scala-hello</artifactId>

<version>1.0-SNAPSHOT</version>

<properties>

<encoding>UTF-8</encoding>

<scala.version>2.10.3</scala.version>

</properties>

<dependencies>

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>${scala.version}</version>

<scope>provided</scope>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.10</artifactId>

<version>1.5.1</version>

<scope>provided</scope>

</dependency>

</dependencies>

<build>

<sourceDirectory>src/main/scala</sourceDirectory>

<testSourceDirectory>src/test/scala</testSourceDirectory>

<plugins>

<plugin>

<groupId>org.scala-tools</groupId>

<artifactId>maven-scala-plugin</artifactId>

<version>2.15.2</version>

<executions>

<execution>

<goals>

<goal>compile</goal>

<goal>testCompile</goal>

</goals>

<configuration>

<args>

<arg>-dependencyfile</arg>

<arg>${project.build.directory}/.scala_dependencies</arg>

</args>

</configuration>

</execution>

</executions>

</plugin>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-surefire-plugin</artifactId>

<version>2.10</version>

<configuration>

<useFile>false</useFile>

<disableXmlReport>true</disableXmlReport>

<!-- If you have classpath issue like NoDefClassError,... -->

<!-- useManifestOnlyJar>false</useManifestOnlyJar -->

<includes>

<include>**/*Test.*</include>

<include>**/*Suite.*</include>

</includes>

</configuration>

</plugin>

</plugins>

</build>

</project>2.创建项目项目结构,如下图。并设置好jdk,scala-sdk等依赖包。

3.编写scala代码

package com.yuanye

import org.apache.spark.{SparkConf, SparkContext}

/**

* Created by yuanye8 on 2016/11/15.

*/

object WordCount {

def main(args: Array[String]): Unit = {

if (args.length < 1) {

System.err.println("Usage: <file>")

System.exit(-1)

}

val conf = new SparkConf()

val sc = new SparkContext(conf)

val line = sc.textFile(args(0))

line.flatMap(_.split(" ")).map((_, 1)).reduceByKey(_ + _).collect().foreach(println)

sc.stop()

}

}4.使用mvn package命令,编译打包。上传jar包至集群,使用命令运行:

#!/bin/bash

set -x

input=/user/yuanye8/test/boy

/data0/spark-1.5.1/bin/spark-submit --class com.yuanye.WordCount \

--master yarn-cluster \

--num-executors 1 --driver-memory 2g --executor-memory 4g \

--name ScalaMavenCompile \

./spark-scala-maven-test.jar $input二、使用SBT进行打包

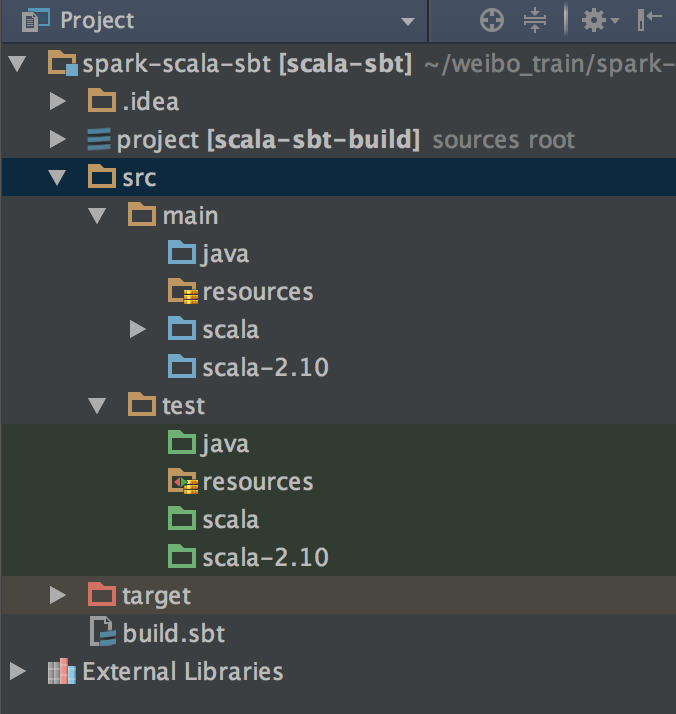

1.使用idea的sbt插件进行sbt项目创建,创建后项目结构如下图(可能需要等待sbt插件自动下载依赖)。

2.编写build.sbt文件,添加spark包。

name := "scala-sbt"

version := "1.0"

scalaVersion := "2.10.3"

resolvers ++= Seq (

"maven Repository" at "https://repository.cloudera.com/artifactory/cloudera-repos/"

)

libraryDependencies ++= Seq {

"org.apache.spark" % "spark-core_2.10" % "1.5.1"

}3.编写scala代码,同maven,此处略去。

4.登入idea terminal,使用sbt工具,命令如下:

sbt

compile

package

5.等待编译完成,拷贝target下的jar包至集群,使用shell进行运行,同maven,此处略去。

5450

5450

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?