论文地址:InfoGAN: Interpretable Representation Learning by Information Maximizing Generative Adversarial Nets

GAN,Generative Adversarial Network是目前非常火也是非常有潜力的一个发展方向,原始的GAN模型存在着无约束、不可控、噪声信号z很难解释等问题,近年来,在原始GAN模型的基础上衍生出了很多种模型,如:条件——CGAN、卷积——DCGAN等等,在本博客的前几篇博文里均进行了大致的解读,本篇博文将提到的InfoGAN也是GAN的一种改进成果,甚至被OPENAI称为去年的五大突破之一。今天我们就来看看,InfoGAN到底做出了什么样的改进,能达到一个什么样的效果呢。

2014年,Ian J. Goodfellow提出了生成对抗网络:Generative Adversarial Networks,通过generator和discriminator的对抗学习,最终可以得到一个与real data分布一致的fake data,但是由于generator的输入z是一个连续的噪声信号,并且没有任何约束,导致GAN无法利用这个z,并将z的具体维度与数据的语义特征对应起来,并不是一个Interpretable(可解释) Representation,而这正好是InfoGAN的出发点,它试图利用z,寻找一个可解释的表达,于是它将z进行了拆解,一是不可压缩的噪声z,二是可解释的 隐变量c,称作为latent code,而我们希望通过约束c与生成数据之间的关系,可以使得c里面包含有对数据的可解释的信息,如对MNIST数据,c可以分为categorical latent code代 来表数字种类信息(0~9),以及continuous latent code来表示倾斜度、笔画粗细等等。

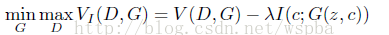

为了引入c,作者利用互信息来对c进行约束,这是因为如果c对于生成数据G(z,c)具有可解释性,那么c和G(z,c)应该具有高度相关性,即互信息大,而如果是无约束的话,那么它们之间没有特定的关系,即互信息接近于0。因此我们希望c与G(z,c)的互信息I(c;G(z,c))越大越好,因此,模型的目标函数也变为:

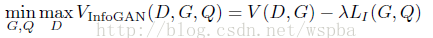

但是在I(c;G(z,c))的计算中,真实的P(c|x)并不清楚,因此在具体的优化过程中,作者采用了变分推断的思想,引入了变分分布Q(c|x)来逼近P(c|x),它是基于最优互信息下界的轮流迭代实现最终的求解,于是InfoGAN的目标函数变为:

在具体的实现中,Q和D共用了所有的卷积层,并只在最后增加了一个全连接层来输出Q(c|x),因此InfoGAN并没有在原始的GAN上增加多少的计算量。

对于c,如果是categorical latent code,可以使用softmax的非线性输出来代表Q(c|x);如果是continuous late

本文探讨了InfoGAN(信息最大化生成对抗网络)的改进原理,旨在通过互信息最大化创建可解释的隐变量c。InfoGAN解决了原始GAN中噪声信号z的不可解释性问题,将z分解为不可压缩的噪声和可解释的隐变量。通过约束c与生成数据的相关性,InfoGAN能够在MNIST等数据集上学习到数字种类、倾斜度等可解释信息。文章还详细解析了InfoGAN的源码实现,包括连续和离散隐变量的生成以及互信息的计算过程。

本文探讨了InfoGAN(信息最大化生成对抗网络)的改进原理,旨在通过互信息最大化创建可解释的隐变量c。InfoGAN解决了原始GAN中噪声信号z的不可解释性问题,将z分解为不可压缩的噪声和可解释的隐变量。通过约束c与生成数据的相关性,InfoGAN能够在MNIST等数据集上学习到数字种类、倾斜度等可解释信息。文章还详细解析了InfoGAN的源码实现,包括连续和离散隐变量的生成以及互信息的计算过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3195

3195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?