学习spark第一天

本人在做本科毕业设计时候接触过Hadoop的MapReduce框架,当时是在Hadoop上安装了Mahout插件,来跑聚类算法,处理了一些业务数据,有幸通过实验室项目了解到还有比Hadoop对数据的存取处理效率更快的基于农村计算的spark框架,最近闲下来的时候研究了一下这个东西,打算把所学的东西记录下来,以备不时之需:

- Spark分布式执行所需的组件

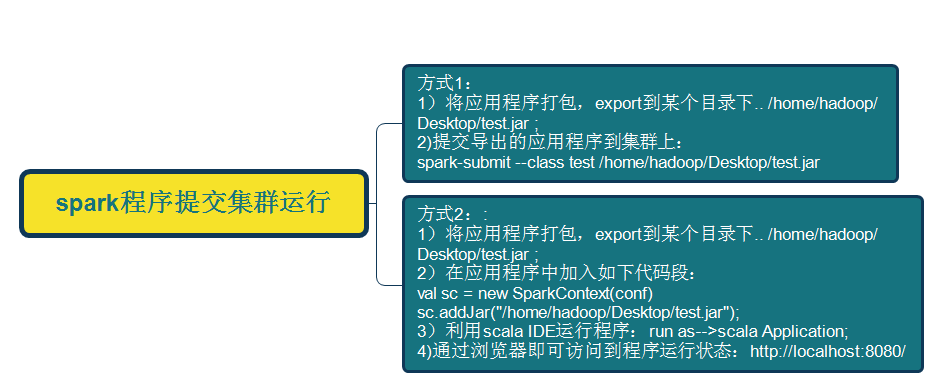

- scala程序打包发送给spark集群运行两种方式

- 第一个spark程序

Spark分布式执行所需的组件

可以渲染序列图:

scala程序打包发送给spark集群运行两种方式

第一个spark程序

import org.apache.spark.SparkConf

import org.apache.spark.SparkContext

import org.apache.spark.SparkContext._

object test {

def main(args : Array[String]){

println("hello spark!")

val conf = new SparkConf().setMaster("spark://127.0.0.1:7077").setAppName("ConSparkAPP")

val sc = new SparkContext(conf)

sc.addJar("/home/hadoop/Desktop/test.jar");

var lines = sc.textFile("/home/hadoop/Desktop/error")

var nginxLine = lines.filter(line => line.contains("nginx"))

println("nginx occure first at: "+nginxLine.first())

sc.stop();

}

}

1141

1141

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?