1、题目

在线抑制负迁移

无缝迁移进化

2、摘要

目的

在搜索开始之前没有先验知识可以使用,限制了离线问题之间的协同作用,为了解决这一问题。

方法

设计了一个新的算法框架,在线学习和利用优化问题之间的相似性。

创新

所提出的算法解释了潜在的相似性,并进行理论分析。

结果与结论

所提出的框架在离散,连续,单目标和多目标问题上验证了有效性。

3、引言

现有研究不足

(1)原有的知识重用方法有两种:(1)存储从各种源问题获得的高质量解/学习模型的池,注入目标优化任务;(2)学习迭代映射,将存储的解从先前优化问题转化为正在优化问题的目标解。这两种方法需要大型数据库去存储知识,随着数据库规模的增长,搜索最优解时间成本也增加。

(2)优化前缺乏关于任务相似性的知识,加剧了负迁移。

本研究创新

(1)提出一个基于模型的迁移EA,能够在线学习和利用黑盒优化问题的相似性,最大程度减少负迁移;

(2)对该方法进行理论分析,并证明了收敛性;

4、图表分析

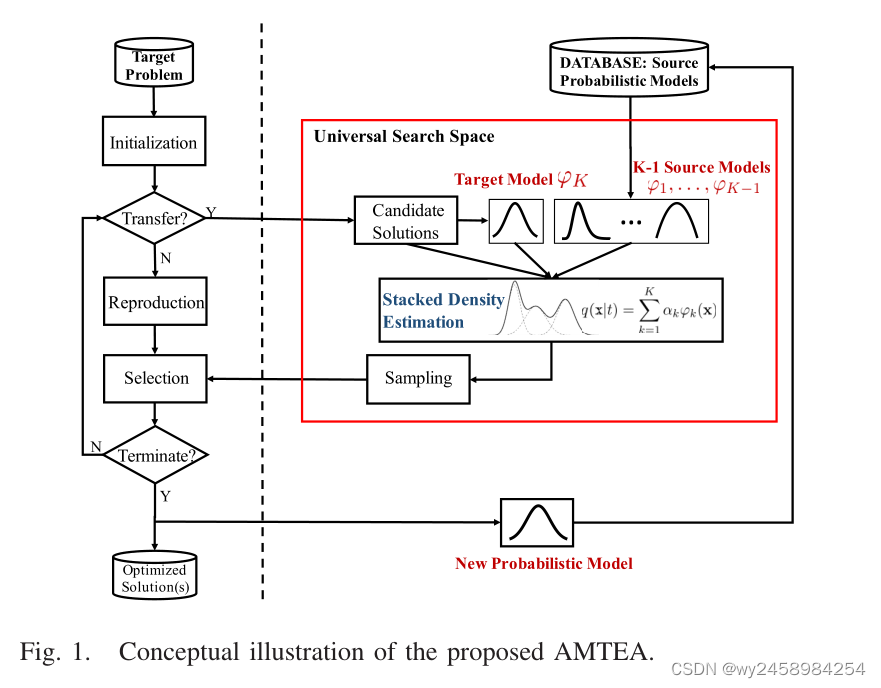

图1:AMTEA算法的概念性解释。

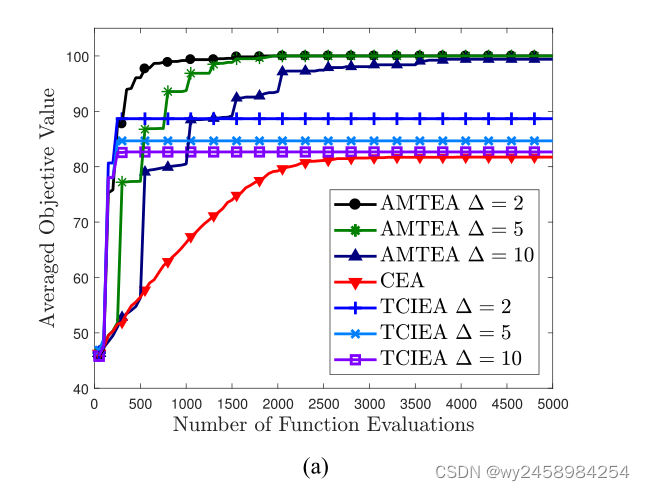

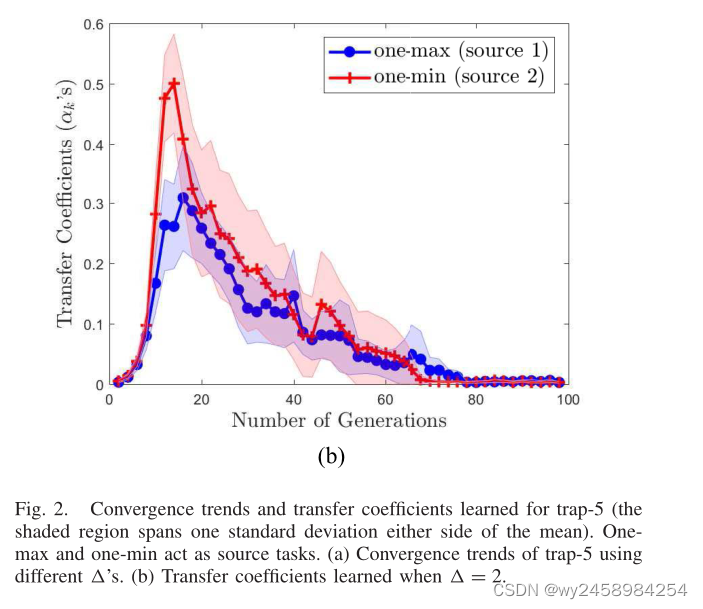

图2:(a)不同传输间隔的trap-5的收敛趋势;(b)当传输间隔为2时,源任务学习的迁移系数α。

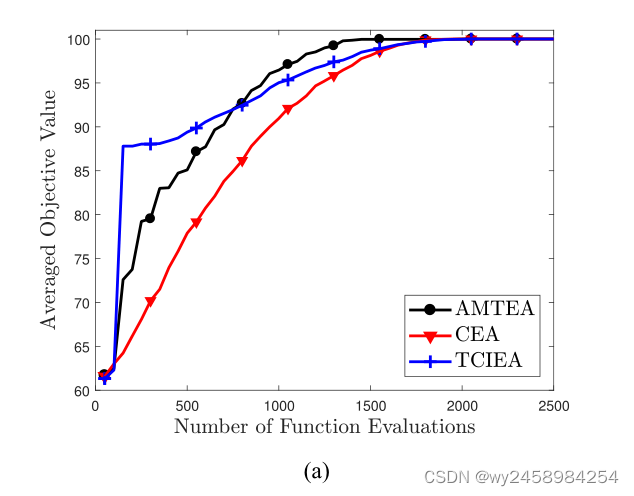

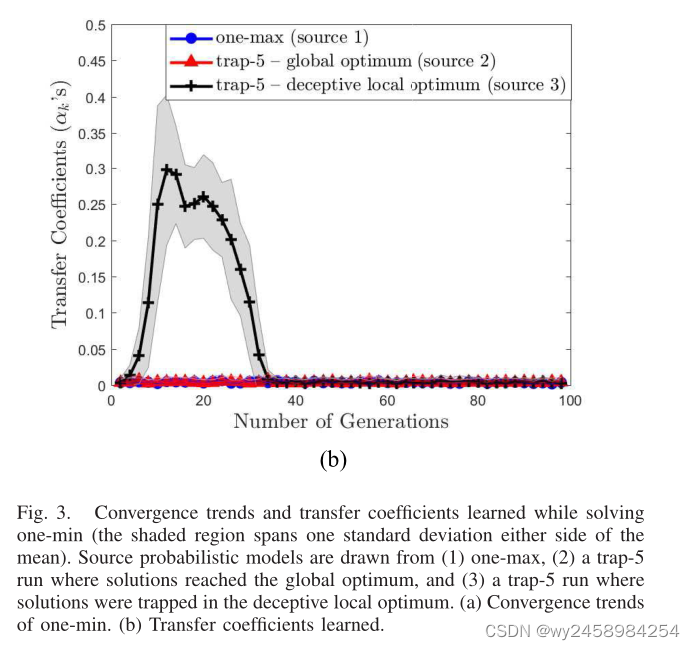

图3:(a)one-min的收敛趋势;(b)one-min学习的迁移参数α。

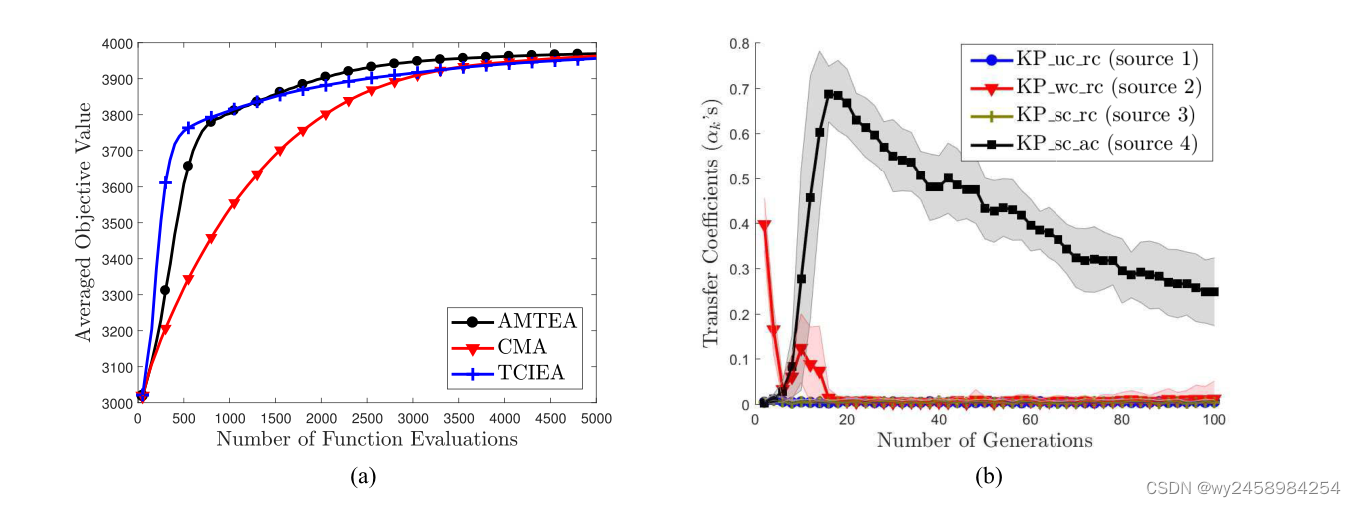

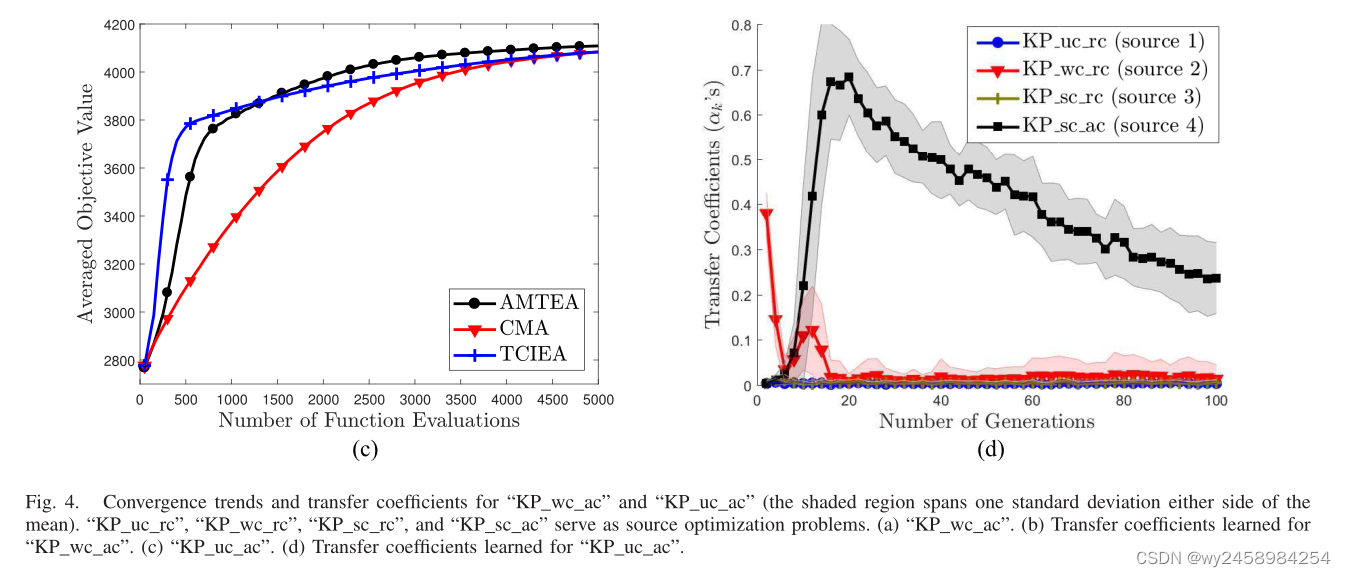

图4:

kp_wc_ac(a)收敛趋势;(b)学习的迁移参数α;

kp_uc_ac(c)收敛趋势;(d)学习的迁移参数α。

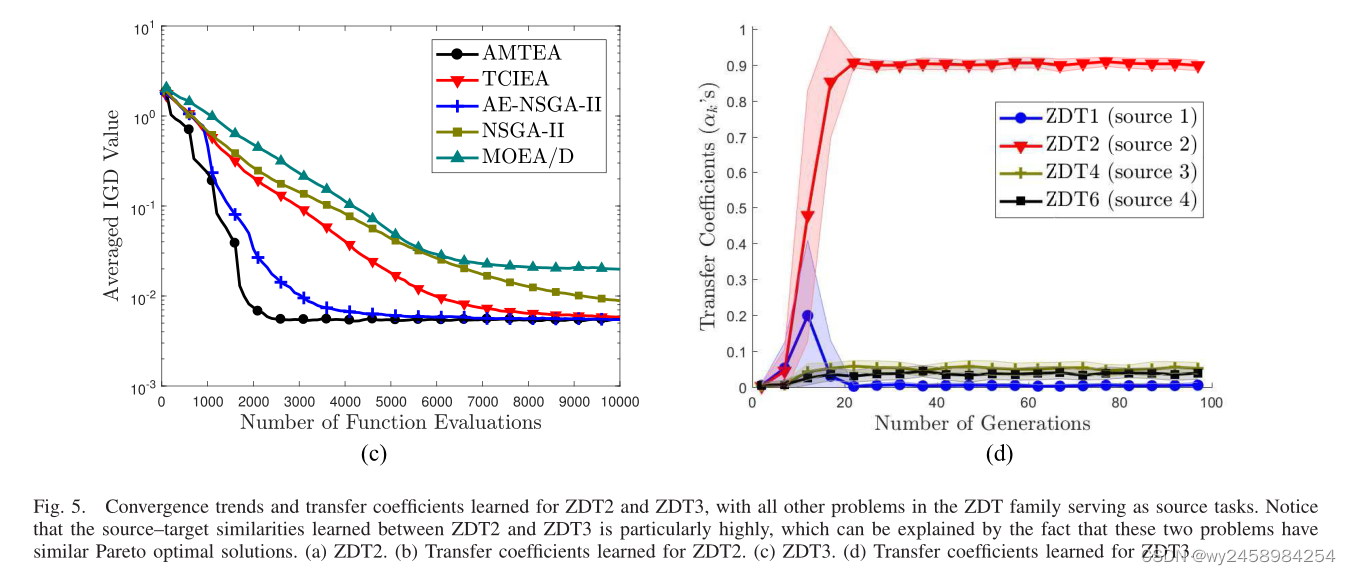

图5:

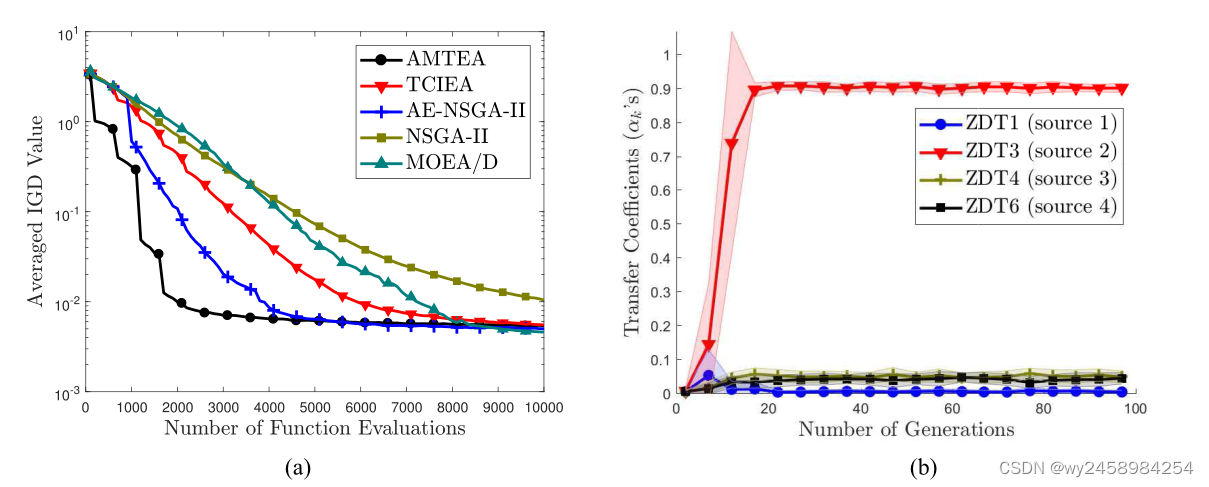

ZDT2(a)IGD值变化趋势;(b)学习的迁移参数α;

ZDT3(c)IGD值变化趋势;(d)学习的迁移参数α。

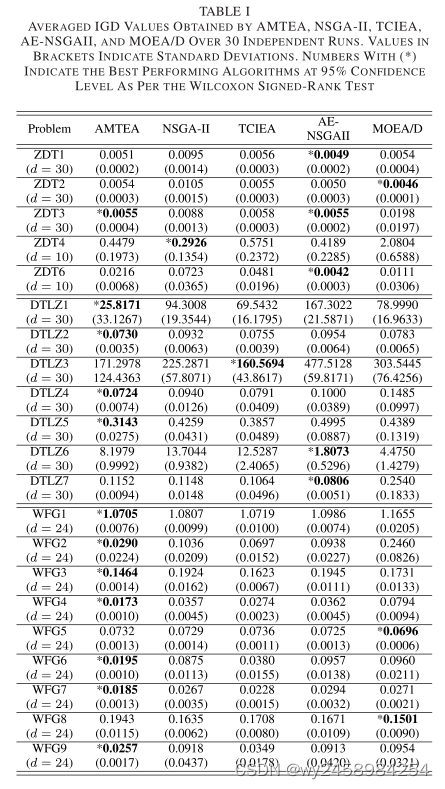

表1:多目标测试问题的IGD值结果。解决三个测试集ZDT,DTLZ,WFG中的任何一个问题时,该测试集中的所有其他问题都充当源任务,为转移提供源概率模型。

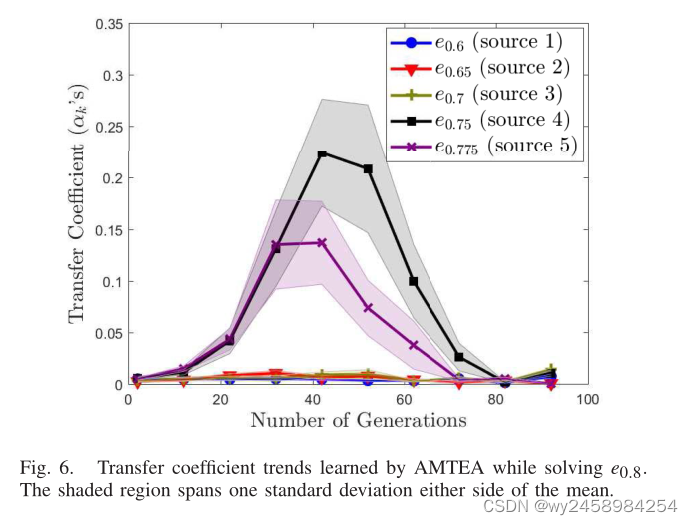

图6:实际问题的学习迁移参数。

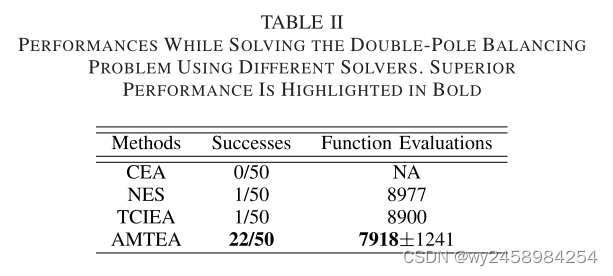

表2:实际问题的性能。

5、框架总结

目的

提出新的迁移进化方式,抑制负迁移。

方法

以混合概率模型学习任务之间的相似性

实验

离散优化实验;

多目标优化实验;

实际问题优化实验。

评价指标

收敛性:IGD;

迁移系数:α值变化趋势。

6、本研究不足与未来工作

本研究不足

未来工作

推广至更多实际优化问题;

将考虑系统级实现,以评估算法在大规模物联网/基于云的应用程序中潜在部署的可伸缩性。

本文引自B. Da, A. Gupta和Y.-S. Ong, 《Curbing Negative Influences Online for Seamless Transfer Evolutionary Optimization》, IEEE Trans. Cybern., 卷 49, 期 12, 页 4365–4378, 12月 2019, doi: 10.1109/TCYB.2018.2864345.

790

790

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?