初读:2021年1月23日至2021年1月24日

在过去的两个月里,大概以一周一节的龟啃这本MindSpore圣经,终于啃完了前三章。只因基础既差,天资又愚钝,一路下来都是硌得牙齿生疼的感觉。端坐书桌之时也会痛骂自己立什么FLAG。不过值得欣慰的是,相比于两个月之前,我多多少少还是有了些长进。

今天开始第4章 “深度神经网络的训练”。这一章从学习系统面临的主要挑战出发,延伸到深度神经网络训练相关的基础知识和使用MindSpore实现深度神经网络的样例。

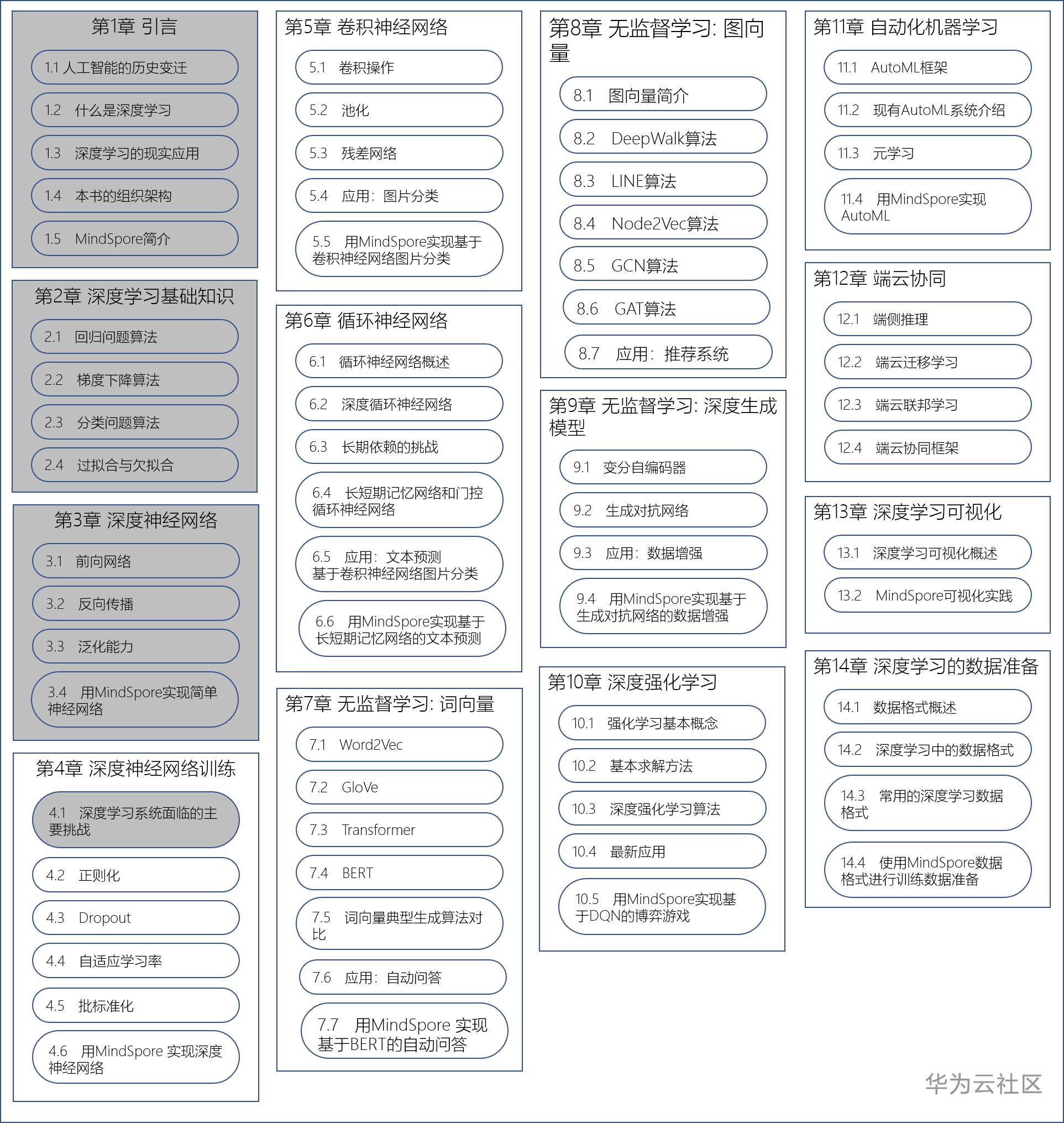

啃书进度会在目录中标出来。本次目标是完成第4章 4.1节 深度学习系统面昨的主要挑战(P37-P39)。

纯文本内容,读起来就是快。深度学习系统面临的主要挑战如下:

4.1.1 大数据集需求

在某种程度上,深度学习系统的效果经常爱限于数据集的大小和质量。数据越多,深度学习模型就会变得更强大。书里还给了一个例子:在语音识别领域中,为了学习一种(自然)语言,模型往往需要大量的各种口音、各种时长的语音数据。所以研究人员要有非常强的数据处理能力。而且数据预处理是非常耗时的工作,有一种说法,一个数据项目80%以上的时间用在了数据处理上。

好巧不巧,刚听到了这样一句话:数据和特征决定了机器学习的上限,而模型和算法只是逼近这个上限而已。说的都是回事,可是话这么说就觉得很高级。

4.1.2 硬件需求

这个问题涉及两类截然不同的场景。一个是高速处理数据的场景 ,数据科学家需要使用多核 高性能的硬件设备以便更快速地完成工作。通常这些设备休息昂贵,而且运算过程会消耗大是的电力 。另一类是移动场景 ,像无人机、机器人等小型设备搭载深度网络。

4.1.3 过拟合

在深度学习系统中,模型往往根据采集(训练)数据做判断,而训练数据与未知数据存在明显的差异,这就导致训练时杠性能很高,但在实际应用中性能很差。在实际应用中,模型的能力应当是通过那些未知的,看不见的数据来判断,而不是只记住了训练数据集的样例。没有学会推广到新的情况和样例,就是深度学习系统的过拟合 现象。看到这,我产生了点联想,也许这一点可以解释为什么机器学习在人脸识别和下棋这一类的应用中表现好——棋盘和走棋的规则是固定的,改变的只是走棋组合关系。人的长相各有千秋,但脸上五官的相对位置都一样。这两类应用场景当中,未知数据和训练数据之间不会存在过大的差别。

其实2.4节已经在技术上讲述了过拟合问题,有需要可以回看。

4.1.4 超参数优化

超参数是在模型学习开始前定义 的参数。实际运行中,超参数设置极大影响模型的性能表现。对模型中超参数的微小调整,可能导致模型性能发生较大变化 。如果 不优化超参数,而是简单依赖某些模型中对超参数的默认设置,可能并不能使模型达到预期的性能。

不幸的是,超参数的设置或调节往往都是依靠研究人员经验或根据模型最终的训练结果。一个在相关领域没有经验积累的人员想要得到一组好的超参数,可能 只能依靠不断地训练那些费时费力的模型。

4.1.5 不透明性

将已知数据提供给深度学习模型进行训练,从数百万计的数据点中,深度学习算法查找并筛选一些不容易被人类注意到的模式和相关性。然而,人类通常并不理解这些模型是如何推断出结论的。

深度学习模型在本质上是黑箱算法,给定输入后,往往只能观测其输出,它内部学习和操作在很大程度 上对我们是不可见的。这使得我们在抽象层次上对深度学习的高级认知变得十分困难,所以在诸如决定被告的命运或确定患者的病情这类场合,深度学习并不适用。说白了,深度学习出来的结果,还是需要人做最终的判断。

4.1.6 缺少灵活性

简单讲,就是目前大多数深度学习系统都是专门 为某个特定的主题设计的,也只能用于原本的主题,通常不能直接应用于解决新问题。

我觉得要求深度学习灵活地适应所有的工作过于吹毛求疵了,就算是人也做不到样样精通,高考还分文理呢,更不用说现在细到毫微的职业分工。既然人要有专业和方向,为什么要求一个模型就包打天下呢?

转自文章链接:https://bbs.huaweicloud.com/forum/forum.php?mod=viewthread&tid=103467

感谢作者的努力与分享,侵权立删!

195

195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?