1 INTRODUCTION

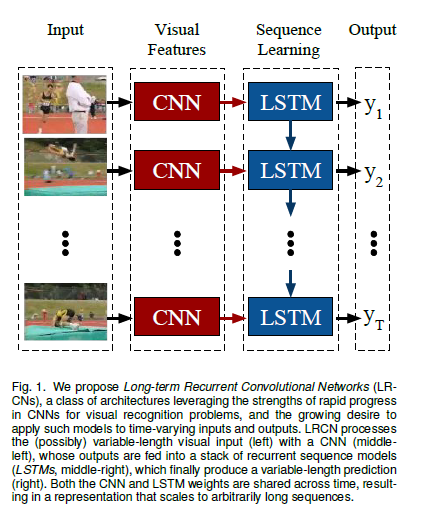

图像和视频的识别和描述是计算机视觉的根本挑战。近年来,针对图像识别任务的监督卷积神经网络(CNN)模型已经取得了显着的进步,并且最近提出了一些对视频处理的扩展。理想情况下,视频模型应该允许对可变长度的输入序列进行处理,并且还提供可变长度的输出,包括生成 超出常规一对一预测任务 的全长句子描述。在本文中,我们提出了Long-term Recurrent Convolutional Networks(LRCN),一种用于视觉识别和描述的架构,其结合卷积层和long-range temporal recursion,并且是端对端可训练的(图1)。

我们实例化我们的架构,用于特定的视频活动识别,图像字幕生成和视频描述任务,如下所述。

对CNN视频处理模型的研究已经考虑了在原始序列数据[1],[2]上学习3D时空滤波器,并学习了帧到帧表示,其将瞬时光流或基于轨迹的模型集成在固定窗口或视频拍摄片段[3],[4]。这些模

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1041

1041

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?