工作需要zai三台linux CentOS release 6.2上搭建一个hadoop集群,在网上找到了一哥们的blog,讲的非常详细,几乎把每条命令都贴出来的,不过他的是ubuntu10.10环境,而我的是CentOS,有些命令还是不一样的 ,下面是这个大哥的blog地址

单节点搭建 http://vampire1126.iteye.com/blog/891693

集群搭建 http://vampire1126.iteye.com/blog/891735

虽然这位大哥已经写的很详细了 但是我自己动手过程中还是遇到了很多问题,现在就总结在这里,希望能帮到大家。

如果根据上面的博客来搭建 ,特别要注意的几点:

- 启动hadoop时应该在hadoop用户下。

- 搭建集群的机器要做时间同步。

- 如果不小心在root下启动hadoop需要把相关的文件删掉,把相关进程杀死。

- 遇到问题第一时间应该看hadoop日志 /hadoop/logs

下面是ubuntu10.10和CentOS之间可能存在的差异

1.在CentOS环境下root 权限添加用户组/用户

groupadd hadoop 添加用户组

adduser -g hadoop hadoop 把用户添加到用户组

2.彻底修改主机名称

如主机名 localhost 改为 master

- 在/etc/hosts 中把localhost替换为master

- 在/etc/sysconfig/network 中把主机名改为master

- 重启网络 /etc/rc.d/init.d/network restart

- 执行 hostname master

3.添加ssh信任列表(以hadoop为例)

- yum install openssh-server 下载SHH服务

- ssh-keygen -t rsa --P 生成密钥

- cat /home/hadoop/.ssh/id_rsa.pub >> /home/hadoop/.ssh/authorized_keys 将密钥添加到信任列表

- chmod 700 ~/.ssh 赋权限

- chmod 600 ~/.ssh/authorized_keys 赋权限

4.更改文件hdfs下每个文件的所有者和/或所属组

chown -R user:group hdfs/

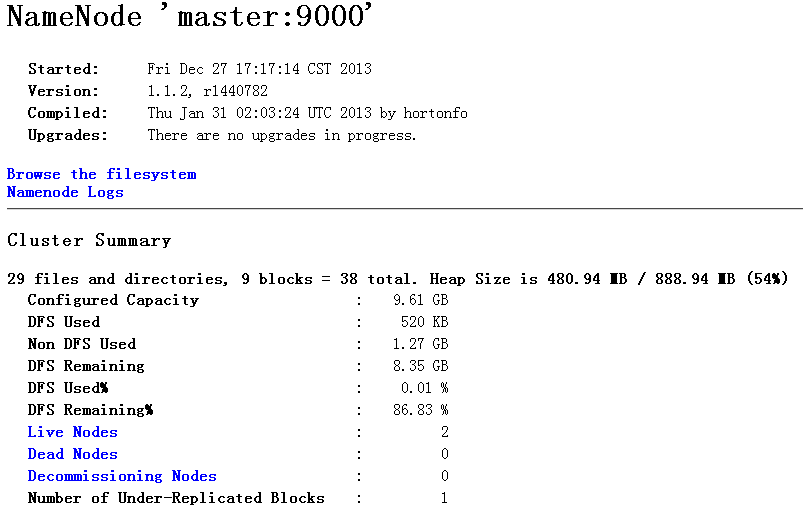

一切OK以后可以在http://master:50070 查看主节点详细信息。

5053

5053

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?