线性判别分析 (LDA)(有监督)

用途:数据预处理中的降维,分类任务

目标:将特征空间投影到一个维度更小的K维子空间中。同时保持区分类别信息。

关心的是怎么让数据更加区分开。

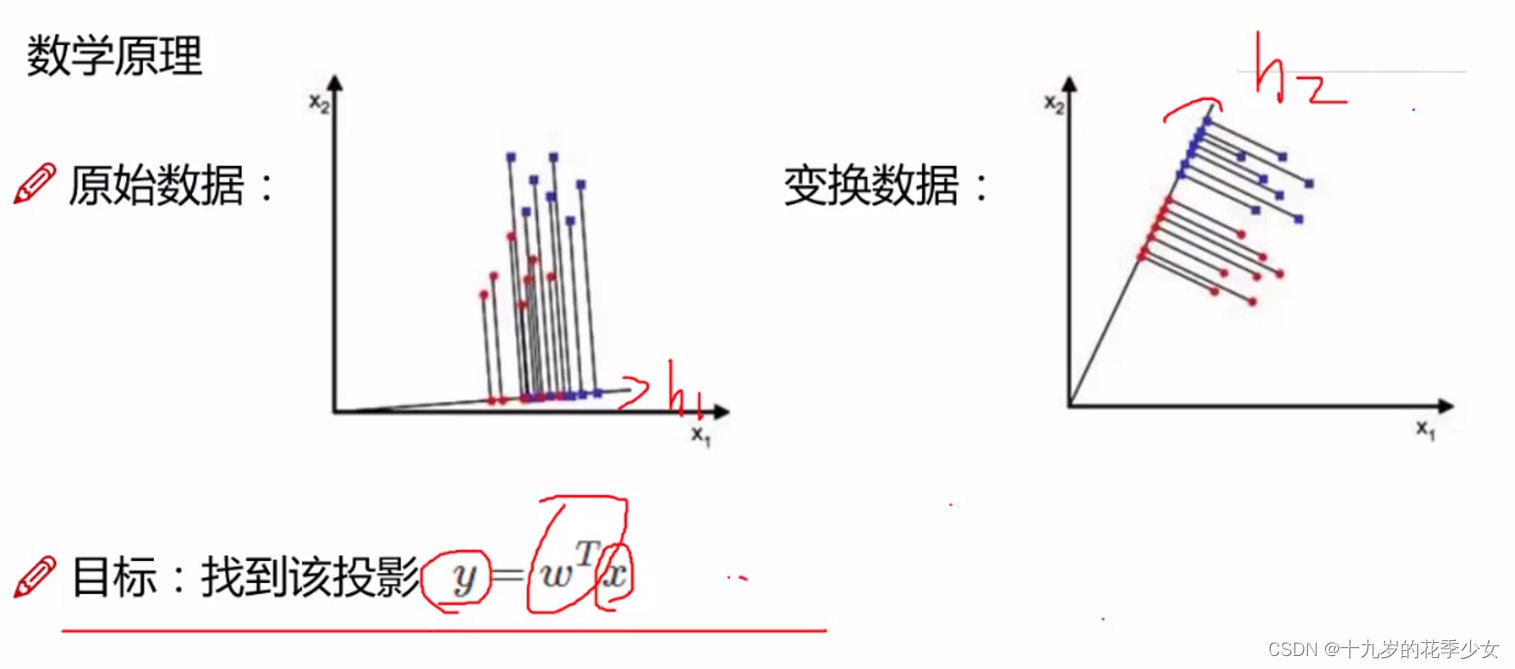

核心点在于,w如何求解,就是如何投影。

分为 类别间和类别中的要求。

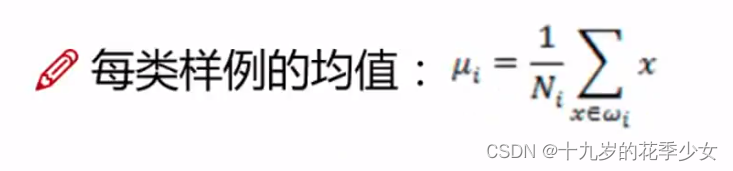

计算每类样例的均值

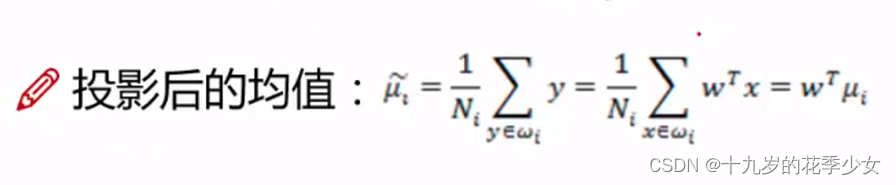

求投影后的均值。对每一个数据进行投影后求均值就相当于对之前的均值投影。

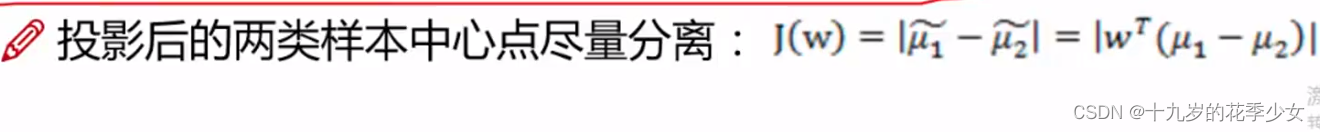

优化目标:J(w)越大越好

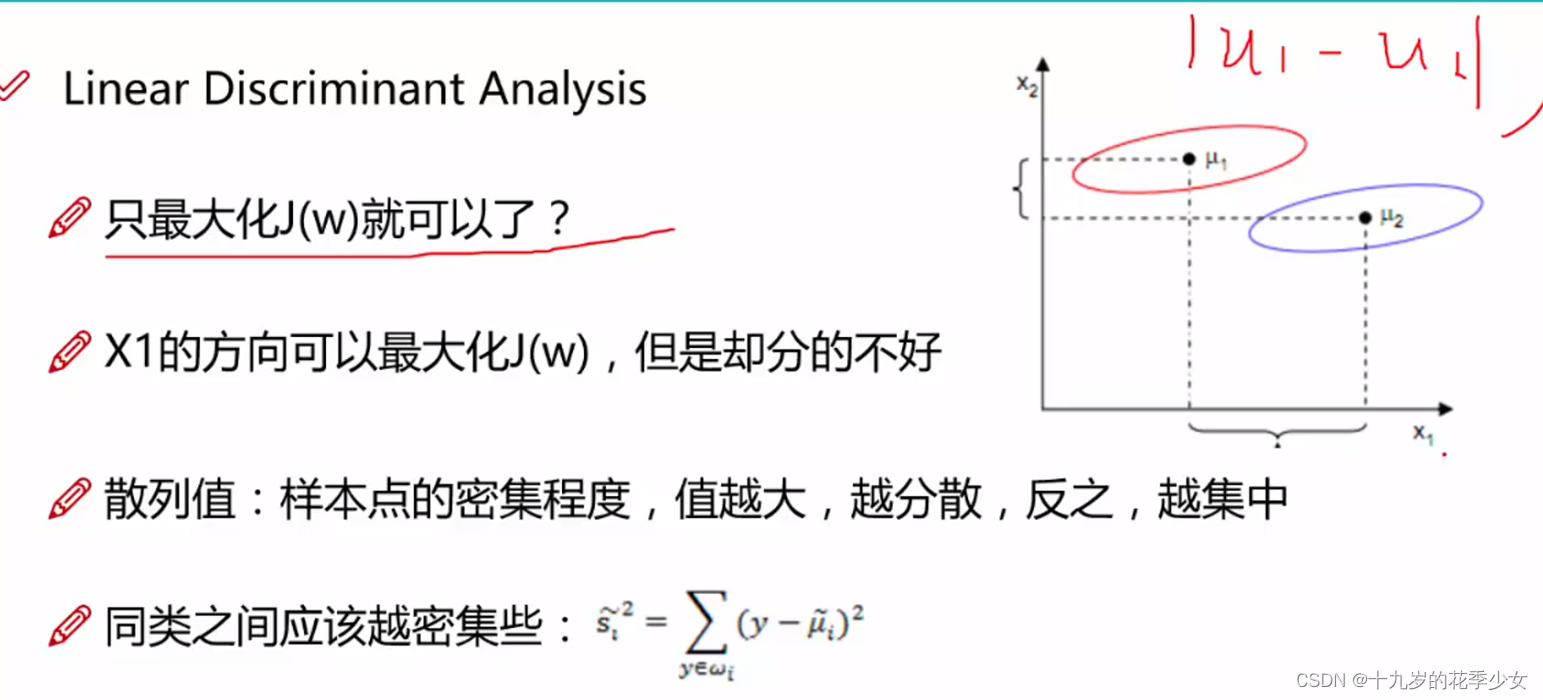

想要最大化J(w),投影到x轴会比投影到y轴更大,到那时投影到x轴分类效果不好。所以提出了一个概念:散列值。希望散列值在样本映射后最小。考虑因素变成了,J(w)越大越好,S越小越好。

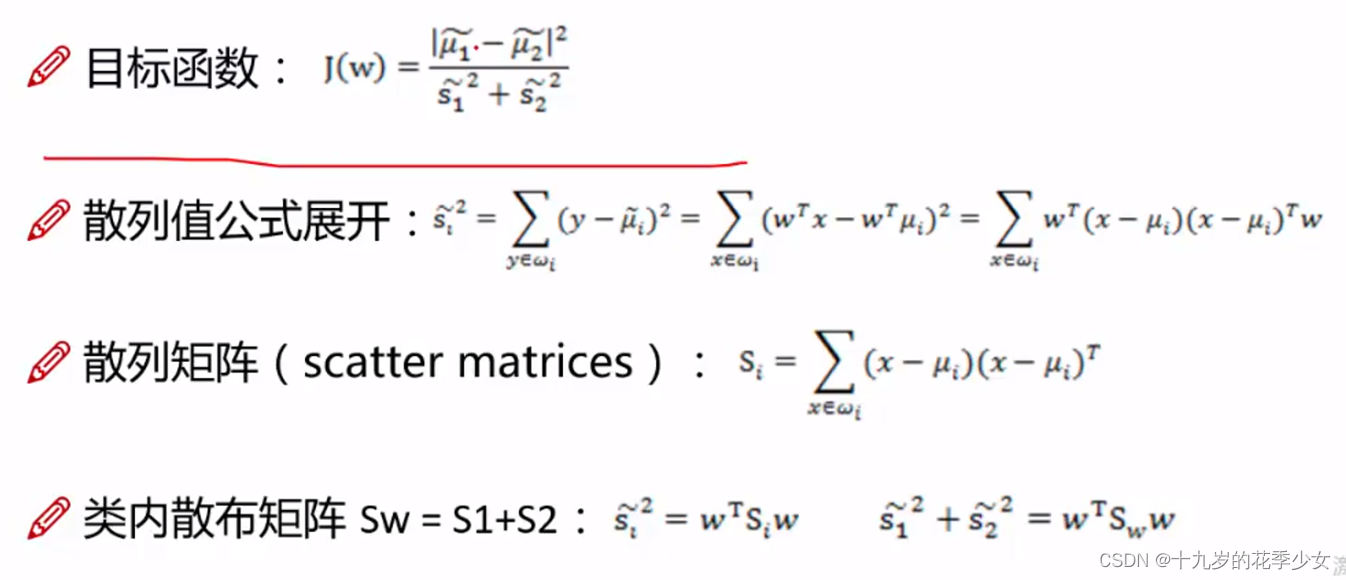

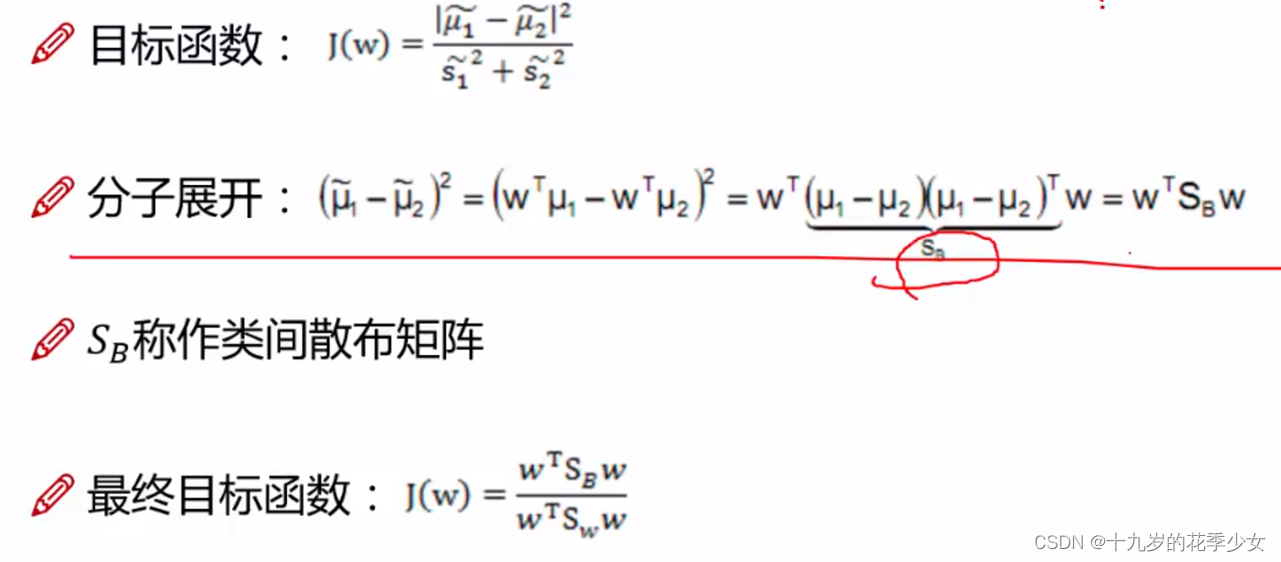

将上面的两个考虑因素综合成目标函数。获得类内散布矩阵。

类间散布矩阵。得到最终目标函数。

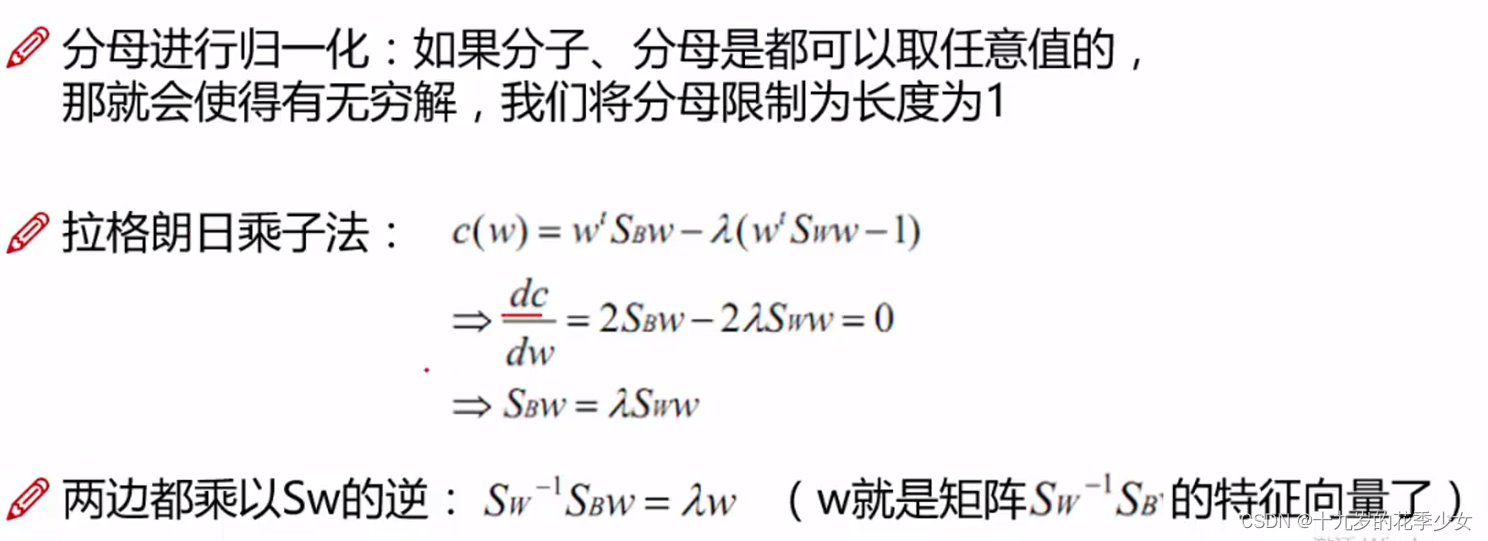

求解。将SwiSB看作是A,即Aw=λw,w为特征向量。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?