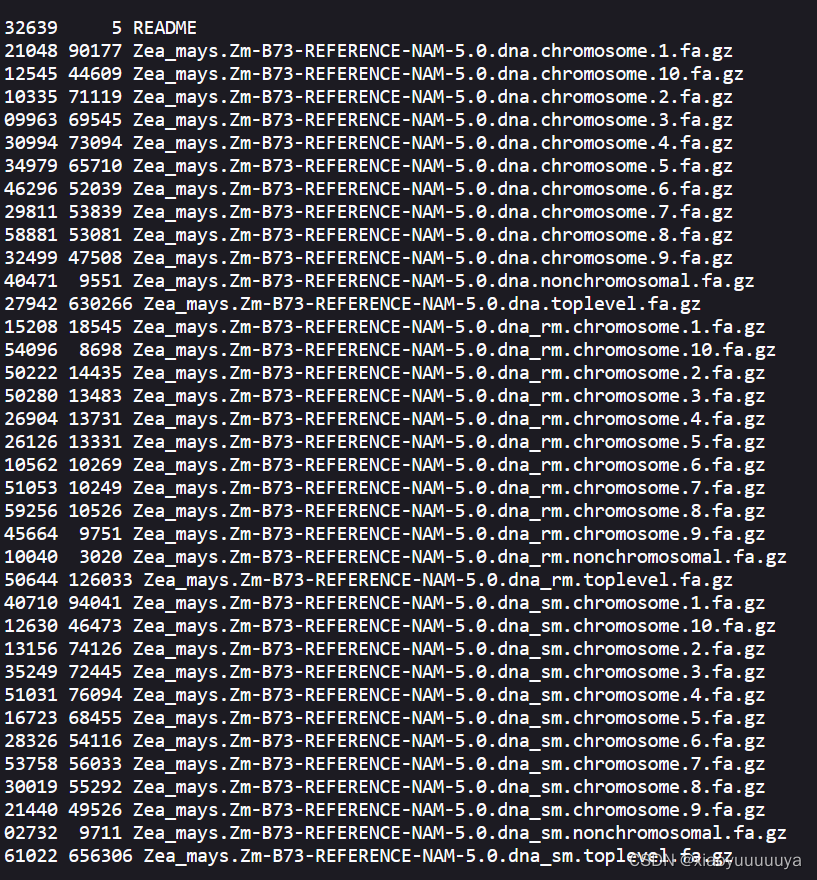

对于Index of /release-66/fasta/zea_mays/dna网页,想要提取当前页中所有压缩文件,可以打开CHECKSUMS文件,对其进行处理

首先:创建新文件all.txt

#将一个网址上的多个文件用wget下载出来

touch all.txt

将网站上的文件名复制下来,保存到all.txt里,对其进行处理:

vim all.txt

#复制内容,保存退出vim

awk -F '{print $2}' all.txt >> a.txt #取最后一列,重定向为新文件

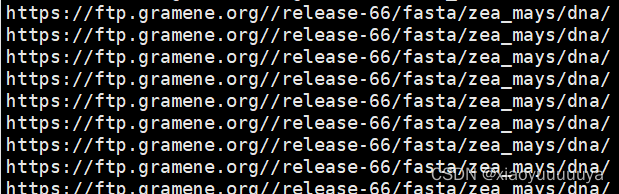

sed -i 's/^/https:\/\/ftp.gramene.org\/\/release-66\/fasta\/zea_mays\/dna\//g' a.txt#每一行最前面加上网址

新生成的a.txt如图

下载:

wget -i a.txt #下载全部压缩文件

成功~~

5330

5330

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?