前言

很多朋友在初次接触想了解学习AI视觉设计的时候都会遇到同一个问题:

Stable diffusion和Midjourney,选那个?

两者都是时下主流的AI图像生成软件,在绘画、设计领域都备受欢迎,可以驾驭各种风格。

Midjourney生成的不同风格作品

Stable diffusion生成的不同风格作品

都是AI绘画软件

它们有什么不一样?

除了Midjourney订阅收费、Stable diffusion开源免费之外,它们俩之间还有其他差别,简单比较一下:

Midjourney

➥ Midjourney是一个基于CLIP模型的生成模型,工作原理是将输入图像与描述性的文本描述进行比较,然后生成与文本描述一致的图像。生成的过程较短,花费时间和资源较少。

➥ 付费使用,只要有网络就可以使用,对硬件没有要求。

➥ 在生成抽象化和风格化的插画、漫画等形式作品时有较大优势。

安装包我已经帮大家整理好了请扫描免费获取哦~

Stable diffusion

➥ Stable diffusion是一个基于diffusion模型的生成模型,工作原理是从噪声图像开始,然后逐渐添加细节,直到生成与目标图像相似的图像。整个过程花费的时间较长,并且需要较多的计算资源。

➥ 也正是消耗了更多资源与时间,其生成的作品会更细致并且更“逼真”。在人物、场景、动物、植物等方面的图像内容生成有较大优势。

➥ 需要自行部署,所有需要一定的硬件支持。

我们在学习使用AI软件的之前,最先考虑的是自己的需求,然后再做选择。当然你要是秉承着“成年人法则”——我全都要!也不是不可以,但一般情况下先学一个就够用了。

同时Stable diffusion的软件界面还和传统的设计软件界面相似,用起来更熟悉,不会像Midjourney那样给人完全不一样的感受。

如果大家想在用AI进行创作是更精准把控风格、构图等内容,生成质量更高的场景、人物、动物等图像,数艺君建议大家用Stable diffusion。

图源:LEOSAM

图源:PromptGeek

图源:Y5targazer

Stable diffusion

搞定场景定制化

今天数艺君给大家分享一个案例,介绍使用Stable diffusion进行设计工作的流程和实操技巧。

第一步我们要做的是准备关键词和线稿草图——线稿决定了最终作品的构图和元素布局。

关键词

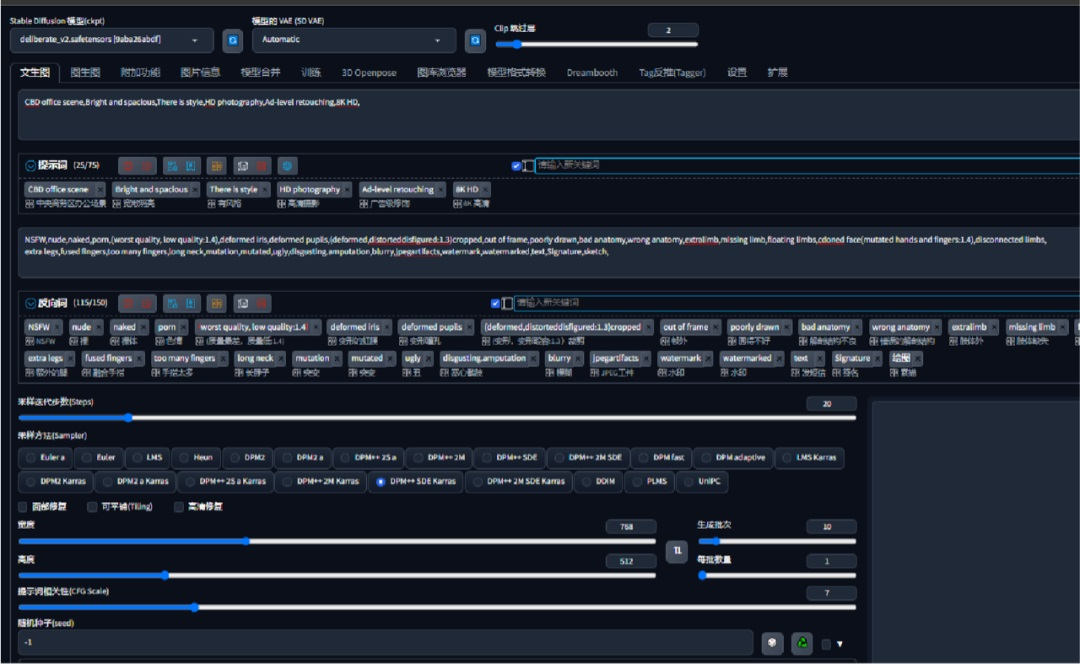

➥ 正向关键词

CBD 办公场景,宽敞明亮,有格调,高清摄影,广告级修图,8K 高清,CBD office scene,Bright and spacious,There is style,HD photography,Ad-level retouching,8K HD,

➥ 反向关键词

NSFW,nude,naked,porn,(worst quality, low quality:1.4),deformed iris,deformed pupils,(deformed,distorteddisfigured:1.3)cropped,out of frame,

poorlydrawn,badanatomy,wronganatomy,extralimb,missinglimb,floatinglimbs,cdonedface(mutatedhandsandfingers:1.4),

disconnectedlimbs,extralegs,fusedfingers,toomanyfingers,longneck,mutation,mutated,ugly,

disgusting.amputation,blurry,jpegartifacts,watermark,watermarked,text,Signature,sketch,

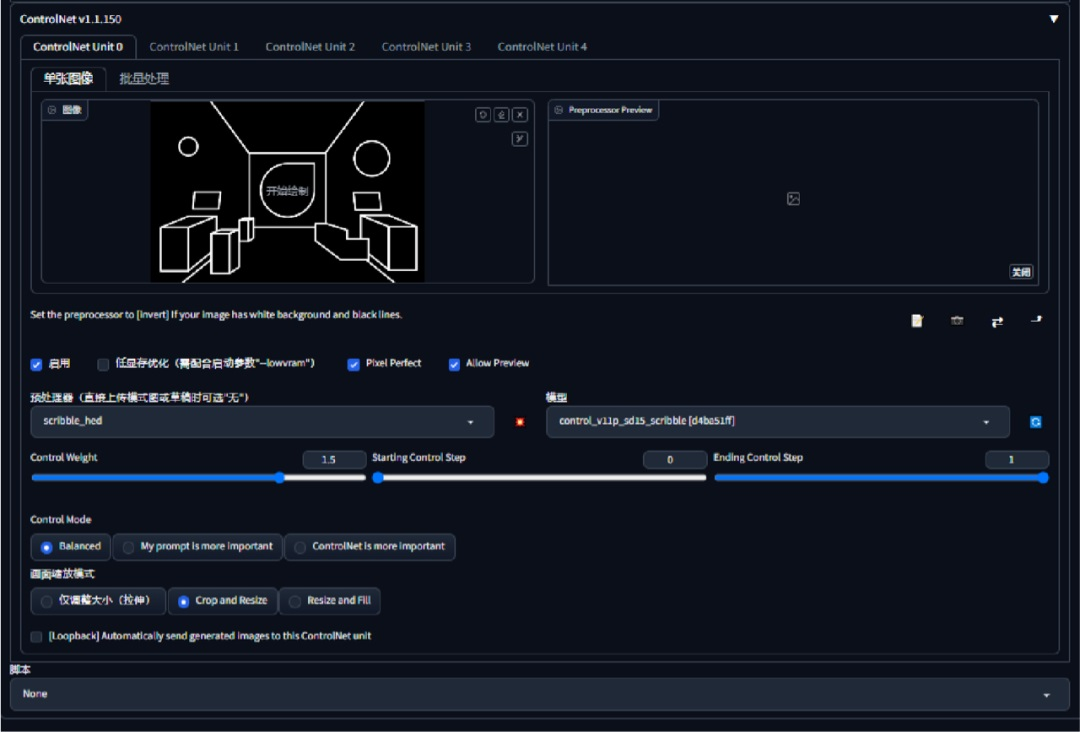

将绘制好的草图上传至control net插件中,选择 scribble模型。

之后可以得到第一张生成的图,看着还不错。

既然是场景定制化,那么我们需要可以随意更换其中的家具、材质等元素。

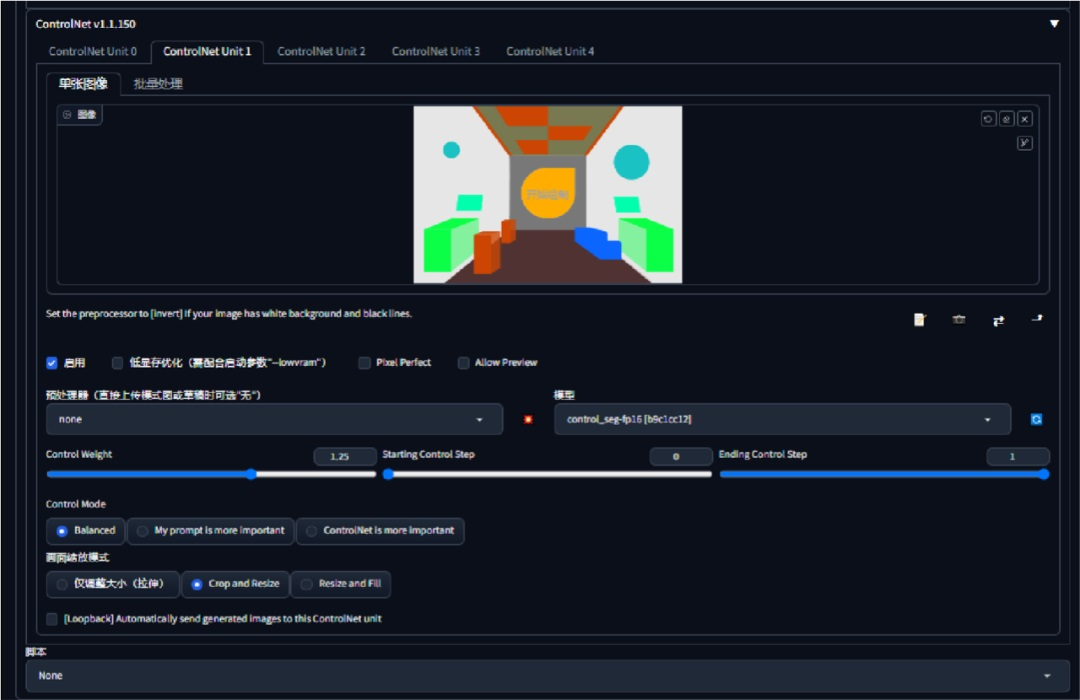

第二步生成SEG色值。

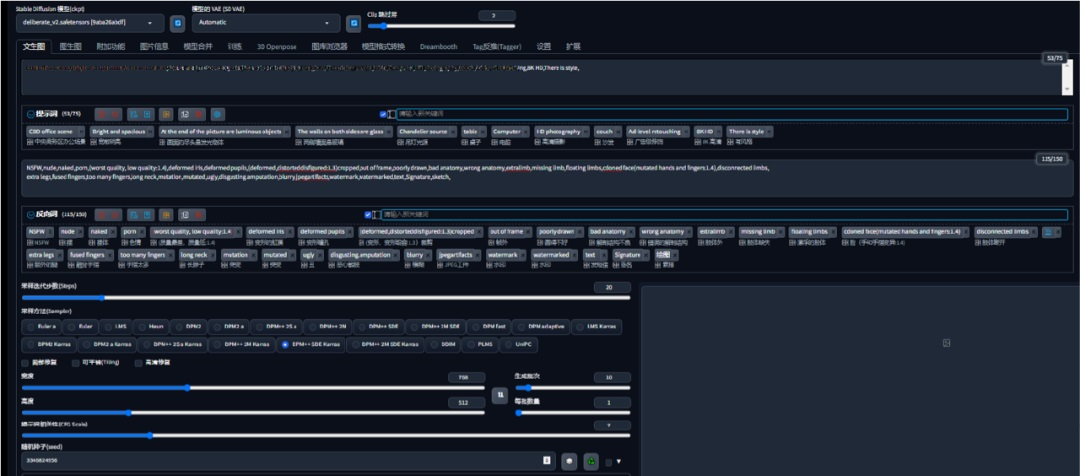

修改指定材质关键词后,借助control net插件里的seg模型配合第一步的操作双开control net模型设置SEG权重,然后就可以得到新的图像。

模型设置

生成结果

可以看到新生成的图像在布局和结构上与最开始的完全一致,完美符合我们的创作需求。

接下来是放大细节。

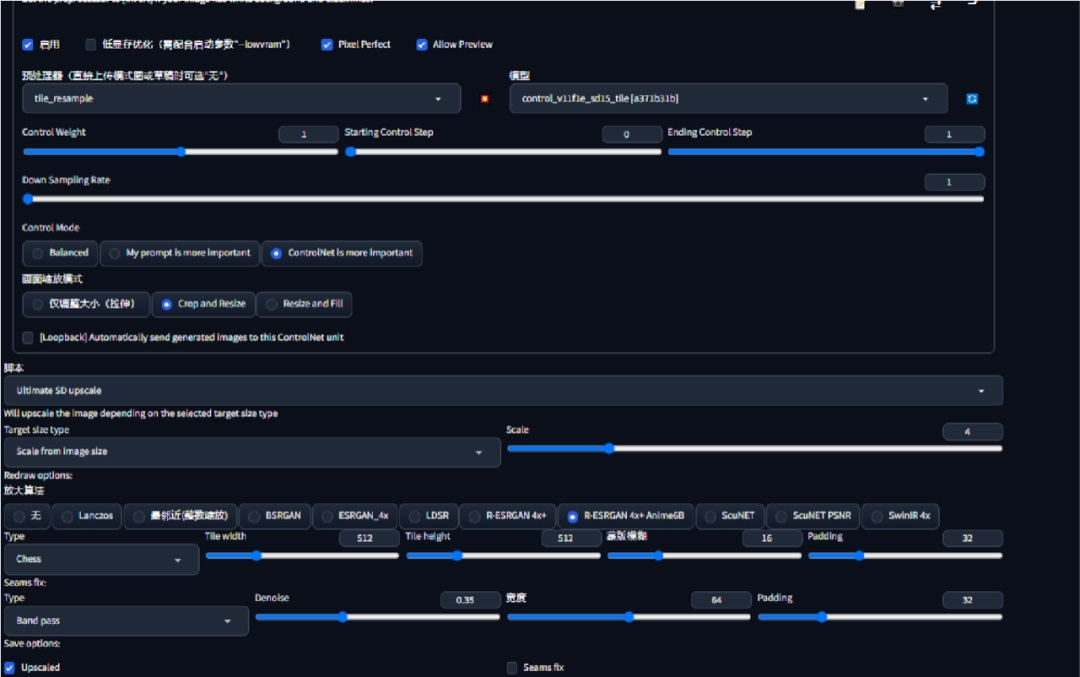

选择一张自己心仪的图片然后转到图生图模式,将图片结合control net插件中的tile_resample进行细节丰富,同时使用脚本中的UItemate SD upscale模型将其放大至自己想要的图片大小。

放大细节后的图像

至此我们用Stable diffusion进行场景的定制化工作就做好了,后续想要什么场景,就可以直接出图,不用从头开始做,大大节省创作成本。

使用相同方法生成的不同场景

相比传统的设计工作,Stable diffusion的加入使最终作品的质量与数量都有极大的提升,可谓神器。

掌握神器Stable diffusion

让设计工作效率成倍增加

AI工具的迭代用“日新月异”来形容毫不夸张,但学习成本其实并不高,并且对我们的绘画技能要求还降低了许多。

所以拥抱AI,拥抱Stable diffusion,解放自己的双手提升生产力,现在就可以开始!

这里直接将该软件分享出来给大家吧~

1.stable diffusion安装包

随着技术的迭代,目前 Stable Diffusion 已经能够生成非常艺术化的图片了,完全有赶超人类的架势,已经有不少工作被这类服务替代,比如制作一个 logo 图片,画一张虚拟老婆照片,画质堪比相机。

最新 Stable Diffusion 除了有win多个版本,就算说底端的显卡也能玩了哦!此外还带来了Mac版本,仅支持macOS 12.3或更高版本。

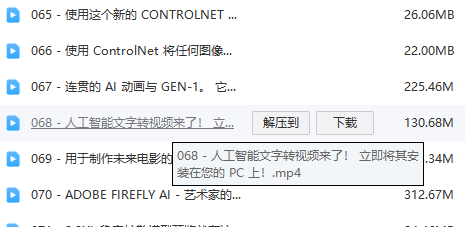

2.stable diffusion视频合集

我们在学习的时候,往往书籍源码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,一步步带你入坑stable diffusion,科学有趣才能更方便的学习下去。

3.stable diffusion模型下载

stable diffusion往往一开始使用时图片等无法达到理想的生成效果,这时则需要通过使用大量训练数据,调整模型的超参数(如学习率、训练轮数、模型大小等),可以使得模型更好地适应数据集,并生成更加真实、准确、高质量的图像。

4.stable diffusion提示词

提示词是构建由文本到图像模型解释和理解的单词的过程。可以把它理解为你告诉 AI 模型要画什么而需要说的语言,整个SD学习过程中都离不开这本提示词手册。

5.SD从0到落地实战演练

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名SD大神的正确特征了。

这份完整版的stable diffusion资料我已经打包好,需要的点击下方插件,即可前往免费领取!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?