标题caffe入门学习

原文地址:http://blog.csdn.net/hjimce/article/details/48933813

作者:hjimce

转载并增加笔记

本文主要讲解caffe的整个使用流程,适用于初级入门caffe,通过学习本篇博文,理清项目训练、测试流程。初级教程,高手请绕道。

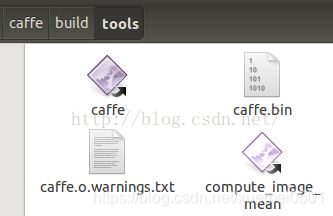

我们知道,在caffe编译完后,在caffe目录下会生成一个build目录,在build目录下有个tools,这个里面有个可执行文件caffe,如下图所示:

有了这个可执行文件我们就可以进行模型的训练,只需要学会调用这个可执行文件就可以了,这便是最简单的caffe学习,不需要对caffe底层的东西懂太多,只需要会调参数,就可以构建自己的网络,然后调用这个可执行文件就可以进行训练,当然如果你不仅仅是调参数,而且想要更改相关的算法,那就要深入学习caffe的底层函数调用了,这个以后再讲。本篇博文仅适合于刚入门学习caffe,高手请绕道。废话不多说,回归正题:

一、总流程

完成一个简单的自己的网络模型训练预测,主要包含几个步骤:

1、数据格式处理,也就是把我们的图片.jpg,.png等图片以及标注标签,打包在一起,搞成caffe可以直接方便调用的文件。后面我将具体讲解如何打包自己的数据,让caffe进行调用。

2、编写网络结构文件,这个文件的后缀格式是.prototxt。就是编写你的网络有多少层,每一层有多少个特征图,输入、输出……。看个例子,看一下caffe-》example-》mnist-》lenet_train_test.prototxt。这个便是手写字体网络结构文件了,我们需要根据自己的需要学会修改这个文件:

name: "LeNet"

layer {

name: "mnist" # 名字可随意

type: "Data" # data层只有输出

top: "data" # 一般用bottom表示输入,top表示输出,多个top代表多个输出

top: "label"

include {

phase: TRAIN # 训练阶段,若没写则表示即在测试中,又在训练中

}

transform_param {

mean_file:"examples/minist/mean.binaryproto" # 用一个配置文件来进行均值的操作

scale: 0.00390625 # 对所有的图片归一化到0~1之间,即对输入数据全部乘以scale,0.0039= 1/255

mirror:1 # 1表示开启镜像,0表示关闭,也可用true和false来表示

# 数据增强,裁剪一个227*227的图块,在训练阶段随机裁剪,在测试阶段从中间裁剪

crop_size:227

}

data_param {

source: "examples/mnist/mnist_train_lmdb" # 训练数据图片路径

batch_size: 64 # 每次训练采用的图片64张,min-batch

backend: LMDB # 选用数据的名称

}

}

### 使用LMDB源,一般做分类用

layer {

name: "mnist"

type: "Data"

top: "data"

top: "label"

include {

phase: TEST //测试

}

transform_param {

scale: 0.00390625

}

data_param {

source: "examples/mnist/mnist_test_lmdb" //测试数据图片路径

batch_size: 100

backend: LMDB

}

}

### 使用HDFS数据源,一般做回归用

layer {

name: "data"

type: "HDFSData"

top: "data"

top: "label"

hdfs_data_param {

source:"examples/hdfs_classification/data/train.txt"

batch_size:10

}

}

#### 卷积层

layer {

name: "conv1" //卷积神经网络的第一层,卷积层

type: "Convolution" //这层操作为卷积

bottom: "data" //这一层的前一层是data层

top: "conv1"

param {

lr_mult: 1 # w权值学习率,最终的学习率是这个数乘以solver.prototxt配置文件中的base_lr,通过设置lr_mult的值让该层是否进行更新

}

param {

lr_mult: 2 # b(偏置)的学习率,一般是权重学习率的两倍

}

convolution_param { # 卷积参数

num_output: 20 # 卷积核个数

kernel_size: 5 # 卷积核大小5*5*d

stride: 1 # 卷积核的步长

pad:0 # 扩充边缘,默认为0,不扩充

weight_filler {

type: "xavier" # 权值初始化,默认为“constant”,值全为0,很多时候用xavier算法来进行初始化,也可设置为“gaussian”

}

bias_filler {

type: "constant" # 偏置初始化,一般设置为“constant”,值全为0

}

}

}

#### 池化层

layer {

name: "pool1"

type: "Pooling" //池化层,这一层的操作为池化

bottom: "conv1" //这一层的前面一层名字为:conv1

top: "pool1"

pooling_param {

pool: MAX //最大池化,还有平均池化AVE

kernel_size: 2 # 池化的核大小

stride: 2 # 池化步长

}

}

layer {

name: "conv2"

type: "Convolution"

bottom: "pool1"

top: "conv2"

param {

lr_mult: 1

}

param {

lr_mult: 2

}

convolution_param {

num_output: 50

kernel_size: 5

stride: 1

weight_filler {

type: "xavier"

}

bias_filler {

type: "constant"

}

}

}

layer {

name: "pool2"

type: "Pooling"

bottom: "conv2"

top: "pool2"

pooling_param {

pool: MAX

kernel_size: 2

stride: 2

}

}

layer {

name: "ip1"

type: "InnerProduct"

bottom: "pool2"

top: "ip1"

param {

lr_mult: 1

}

param {

lr_mult: 2

}

inner_product_param {

num_output: 500

weight_filler {

type: "xavier"

}

bias_filler {

type: "constant"

}

}

}

## 激活函数relu

layer {

name: "relu1"

type: "ReLU"

bottom: "ip1"

top: "ip1"

}

## 全连接层,输出的是一个简单向量,参数跟卷积层一样

layer {

name: "ip2"

type: "InnerProduct"

bottom: "ip1"

top: "ip2"

param {

lr_mult: 1

}

param {

lr_mult: 2

}

inner_product_param {

num_output: 10 # 输出

weight_filler {

type: "xavier"

}

bias_filler {

type: "constant"

}

}

}

### Dropout是一个防止过拟合的层

layer {

name:"drop7"

type:"Dropout"

bottom:"fc7-conv"

top:"fc7-conv"

dropou_param {

dropout_ratio:0.5 # 只需要设置一个dropout_ratio

}

}

## 测试时的输入准确率

layer {

name: "accuracy"

type: "Accuracy"

bottom: "ip2" # 全连接层的分类结果

bottom: "label" # 全连接层的标签结果

top: "accuracy"

include {

phase: TEST

}

}

### 在不改变数据的情况下,改变输入的维度,如将32*3*28*28变为32*3*14*56

layer {

name:"reshape"

type:"Reshape"

bottom:"input"

top:"output"

reshape_param{

shape{

dim:0 #表示维度不变,即输入和输出是相同的维度

dim:0

dim:14 # 将原来的维度变为14

dim:-1 # 系统自动计算维度,数据总量不变,所以可得出维度变为56

}

}

}

## softmax-loss layer:输出loss值

layer {

name: "loss"

type: "SoftmaxWithLoss"

bottom: "ip2"

bottom: "label"

top: "loss"

}

上面的网络结构,定义的data层,就是定义我们输入的训练数据的路径、图片变换等。

3、网络求解文件,这个文件我们喜欢把它取名为:solver.prototxt,这个文件的后缀格式也是.prototxt。这个文件主要包含了一些求解网络,梯度下降参数、迭代次数等参数……,看下手写字体的solver.prototxt文件:

# caffe提供了六种优化算法来求解最优参数,在solver配置文件中,通过设置type类型来选择,如SGD/AdaDelta/AdaGrad/Adam/Nesterov/RMSProp

<span style="font-size:18px;">

net: "examples/mnist/lenet_train_test.prototxt" # 定义网络结构文件,也就是我们上一步编写的文件如卷积层、池化层等

test_iter: 100 # 迭代了多少个测试样本,样本总数=batch*test_iter

test_interval: 500 # 测试间隔,也就是每训练500次,才进行一次测试

base_lr: 0.01 # 基础学习率

momentum: 0.9 # 动量参数,一般都是0.9不用改变

type: SGD

weight_decay: 0.0005 # 权重衰减系数

lr_policy: "inv" # 学习率调整的策略(如还可变为-fixed:保持base_lr不变)

gamma: 0.0001

power: 0.75

display: 100 # 每训练100次,在屏幕上显示一次,如果设置为0,则不显示

max_iter: 10000 # 最大迭代次数,1万次就停止了

snapshot: 5000 # 每迭代5000次,保存一次结果

snapshot_prefix: "examples/mnist/lenet" # 保存结果路径

solver_mode: GPU # 默认是CPU的,训练硬件设备选择GPU还是CPU

这个文件的输入就是我们前面一步定义的网络结构。

4、训练,编写网络求解文件后,我们可以说已经完成了CNN网络的编写。接着我们需要把这个文件,作为caffe的输入参数,调用caffe可执行文件,进行训练就可以了。具体的命令如下:

## caffe的安装目录 train --solver=

./build/tools/caffe train --solver=examples/mnist/lenet_solver.prototxt

这样就完事了,程序就开始训练了。上面的第一个参数caffe,就是我们在编译caffe,生成的可执行文件:

然后solver就是我们在步骤3编写的solver文件了,只要在ubuntu终端输入上面的命令,就可以开始训练了。

回想一下文件调用过程:首先caffe可执行文件,调用了solver.prototxt文件,而这个文件又调用了网络结构文件lenet_train_test.prototxt,然后lenet_train_test.prototxt文件里面又会调用输入的训练图片数据等。因此我们如果要训练自己的模型,需要备好3个文件:数据文件lmdb(该文件包含寻数据)、网络结构lenet_train_test.prototxt、求解文件solver.prototxt,这几个文件名随便,但是文件后缀格式不要随便乱改。把这三个文件放在同一个目录下,然后在终端输入命令,调用caffe就可以开始训练了。

二、相关细节

1、lmdb数据格式生成

caffe输入训练图片数据我比较喜欢用lmdb格式,好像还有另外一种格式leveldb,这个具体没用过,这里主要讲解lmdb格式数据的制作。其实在caffe-》example-》imagenet文件夹下面的一些脚本文件可以帮助我们快速生产相关的caffe所需的数据。

create_imagenet.sh这个文件可以帮我们快速的生成lmdb的数据格式文件,因此我们只需要把这个脚本文件复制出来,稍作修改,就可以对我们的训练图片、标注文件进行打包为lmdb格式文件了。制作图片的脚本文件如下:

#!/usr/bin/env sh

# Create the imagenet lmdb inputs

# N.B. set the path to the imagenet train + val data dirs

EXAMPLE=. # 生成模型训练数据文化夹,即存放所有文件的目录

DATA=. # python脚步处理后数据路径

TOOLS=../../build/tools # caffe的工具库,不用变,caffe安装路径下的tools

TRAIN_DATA_ROOT=train/ #待处理的训练数据图片路径

VAL_DATA_ROOT=val/ # 带处理的验证数据图片路径

# Set RESIZE=true to resize the images to 256x256. Leave as false if images have

# already been resized using another tool.

RESIZE=true #图片缩放

if $RESIZE; then

RESIZE_HEIGHT=256 # reshape

RESIZE_WIDTH=256

else

RESIZE_HEIGHT=0

RESIZE_WIDTH=0

fi

if [ ! -d "$TRAIN_DATA_ROOT" ]; then

echo "Error: TRAIN_DATA_ROOT is not a path to a directory: $TRAIN_DATA_ROOT"

echo "Set the TRAIN_DATA_ROOT variable in create_imagenet.sh to the path" \

"where the ImageNet training data is stored."

exit 1

fi

if [ ! -d "$VAL_DATA_ROOT" ]; then

echo "Error: VAL_DATA_ROOT is not a path to a directory: $VAL_DATA_ROOT"

echo "Set the VAL_DATA_ROOT variable in create_imagenet.sh to the path" \

"where the ImageNet validation data is stored."

exit 1

fi

echo "Creating train lmdb..."

GLOG_logtostderr=1 $TOOLS/convert_imageset \

--resize_height=$RESIZE_HEIGHT \

--resize_width=$RESIZE_WIDTH \

--shuffle \

$TRAIN_DATA_ROOT \

$DATA/train.txt \ #标签训练数据文件

$EXAMPLE/train_lmdb

echo "Creating val lmdb..."

GLOG_logtostderr=1 $TOOLS/convert_imageset \

--resize_height=$RESIZE_HEIGHT \

--resize_width=$RESIZE_WIDTH \

--shuffle \

$VAL_DATA_ROOT \

$DATA/val.txt \ #验证集标签数据

$EXAMPLE/val_lmdb

echo "Done."

同时我们需要制作如下四个文件:

1、文件夹train,用于存放训练图片

2、文件夹val,用于存放验证图片

3、文件train.txt,里面包含这每张图片的名称,及其对应的标签。

first_batch/train_female/992.jpg 1

first_batch/train_female/993.jpg 1

first_batch/train_female/994.jpg 1

first_batch/train_female/995.jpg 1

first_batch/train_female/996.jpg 1

first_batch/train_female/997.jpg 1

first_batch/train_female/998.jpg 1

first_batch/train_female/999.jpg 1

first_batch/train_male/1000.jpg 0

first_batch/train_male/1001.jpg 0

first_batch/train_male/1002.jpg 0

first_batch/train_male/1003.jpg 0

first_batch/train_male/1004.jpg 0

first_batch/train_male/1005.jpg 0

first_batch/train_male/1006.jpg 0

first_batch/train_male/1007.jpg 0

first_batch/train_male/1008.jpg 0

上面的标签编号:1,表示女。标签:0,表示男。

4、文件val.txt,同样这个文件也是保存图片名称及其对应的标签。这四个文件在上面的脚本文件中,都需要调用到。制作玩后,跑一下上面的脚本文件,就ok了,跑完后,即将生成下面两个文件夹:

文件夹下面有两个对应的文件:

制作完后,要看看文件的大小,有没有问题,如果就几k,那么正常是每做好训练数据,除非你的训练图片就几张。

二、训练

1、直接训练法

#!/usr/bin/env sh

TOOLS=../cafferead/build/tools

$TOOLS/caffe train --solver=gender_solver.prorotxt -gpu all #加入 -gpu 选项

-gpu 可以选择gpu的id号,如果是 -gpu all表示启用所有的GPU进行训练。

2、采用funing-tuning 训练法

$TOOLS/caffe train --solver=gender_solver.prorotxt -weights gender_net.caffemodel #加入-weights

加入-weights,这个功能很好用,也经常会用到,因为现在的CNN相关的文献,很多都是在已有的模型基础上,进行fine-tuning,因为我们大部分人都缺少训练数据,不像谷歌、百度这些土豪公司,有很多人专门做数据标注,对于小公司而言,往往缺少标注好的训练数据。因此我们一般使用fine-tuning的方法,在少量数据的情况下,尽可能的提高精度。我们可以使用:-weights 选项,利用已有的模型训练好的参数,作为初始值,进行继续训练。

三、调用python接口

训练完毕后,我们就可以得到caffe的训练模型了,接着我们的目标就预测,看看结果了。caffe为我们提供了方便调用的python接口函数,这些都在模块pycaffe里面。因此我们还需要知道如何使用pycaffe,进行测试,查看结果。下面是pycaffe的预测调用使用示例:

# coding=utf-8

import os

import numpy as np

from matplotlib import pyplot as plt

import cv2

import shutil

import time

#因为RGB和BGR需要调换一下才能显示

def showimage(im):

if im.ndim == 3:

im = im[:, :, ::-1]

plt.set_cmap('jet')

plt.imshow(im)

plt.show()

#特征可视化显示,padval用于调整亮度

def vis_square(data, padsize=1, padval=0):

data -= data.min()

data /= data.max()

#因为我们要把某一层的特征图都显示到一个figure上,因此需要计算每个图片占用figure多少比例,以及绘制的位置

n = int(np.ceil(np.sqrt(data.shape[0])))

padding = ((0, n ** 2 - data.shape[0]), (0, padsize), (0, padsize)) + ((0, 0),) * (data.ndim - 3)

data = np.pad(data, padding, mode='constant', constant_values=(padval, padval))

# tile the filters into an image

data = data.reshape((n, n) + data.shape[1:]).transpose((0, 2, 1, 3) + tuple(range(4, data.ndim + 1)))

data = data.reshape((n * data.shape[1], n * data.shape[3]) + data.shape[4:])

showimage(data)

#设置caffe源码所在的路径

caffe_root = '../../../caffe/'

import sys

sys.path.insert(0, caffe_root + 'python')

import caffe

#加载均值文件

mean_filename='./imagenet_mean.binaryproto'

proto_data = open(mean_filename, "rb").read()

a = caffe.io.caffe_pb2.BlobProto.FromString(proto_data)

mean = caffe.io.blobproto_to_array(a)[0]

#创建网络,并加载已经训练好的模型文件

gender_net_pretrained='./caffenet_train_iter_1500.caffemodel'

gender_net_model_file='./deploy_gender.prototxt'

gender_net = caffe.Classifier(gender_net_model_file, gender_net_pretrained,mean=mean,

channel_swap=(2,1,0),#RGB通道与BGR

raw_scale=255,#把图片归一化到0~1之间

image_dims=(256, 256))#设置输入图片的大小

#预测分类及其可特征视化

gender_list=['Male','Female']

input_image = caffe.io.load_image('1.jpg')#读取图片

prediction_gender=gender_net.predict([input_image])#预测图片性别

#打印我们训练每一层的参数形状

print 'params:'

for k, v in gender_net.params.items():

print 'weight:'

print (k, v[0].data.shape)#在每一层的参数blob中,caffe用vector存储了两个blob变量,用v[0]表示weight

print 'b:'

print (k, v[1].data.shape)#用v[1]表示偏置参数

#conv1滤波器可视化

filters = gender_net.params['conv1'][0].data

vis_square(filters.transpose(0, 2, 3, 1))

#conv2滤波器可视化

'''filters = gender_net.params['conv2'][0].data

vis_square(filters[:48].reshape(48**2, 5, 5))'''

#特征图

print 'feature maps:'

for k, v in gender_net.blobs.items():

print (k, v.data.shape);

feat = gender_net.blobs[k].data[0,0:4]#显示名字为k的网络层,第一张图片所生成的4张feature maps

vis_square(feat, padval=1)

#显示原图片,以及分类预测结果

str_gender=gender_list[prediction_gender[0].argmax()]

print str_gender

plt.imshow(input_image)

plt.title(str_gender)

plt.show()

上面的接口,同时包含了pycaffe加载训练好的模型,进行预测及其特征可视化的调用方法。

*******作者:hjimce 时间:2015.10.6 联系QQ:1393852684 原创文章,转载请保留原文地址、作者等信息

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?